Tecnología Visual

|

lunes, mayo 6, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Científicos alemanes han creado unos guantes que cambian de color al entrar en contacto con químicos tóxicos invisibles. Científicos alemanes han creado unos guantes que cambian de color al entrar en contacto con químicos tóxicos invisibles.Se tratan de unos guantes que buscan alertar simple y directamente a trabajadores, obreros, y científicos ante fugas o presencia de químicos tóxicos que puedan ocasionarles daños a humanos. Son constantes las intoxicaciones o envenenamientos accidentales que se producen en fábricas, construcciones y laboratorios, debido a que las personas están expuestas a fugas de químicos que ocurren en sus entornos. Los guantes contienen un químico especial que se torna azul para emitir la alerta. Funciona mediante la compresión de sensores que detectan monóxido de carbono, sulfuro de hidrógeno, entre muchos otros químicos. Lo más difícil fue hacer que estos sensores no perdieran capacidad al ser lavados. Los científicos ahora buscarán crear coberturas o calcomanías con este mismo sistema, que se adhieran a tanques y tuberías de gases para que igualmente sirvan de alerta, pues muchos de los químicos tóxicos, además de ser invisibles no presentar olor. fuente autor: idrialis castillo |

|

|

|

|

|

|

|

NOTA: Este es un artículo invitado en eliax.com

¿Se imaginan la posibilidad de poder tener una cámara que pueda tener múltiples enfoques a muy distintos rangos de campo de profundidad, junto con la particularidad de que ese enfoque sería simultáneo? ¿Se imaginan la posibilidad de poder tener una cámara que pueda tener múltiples enfoques a muy distintos rangos de campo de profundidad, junto con la particularidad de que ese enfoque sería simultáneo? Científicos de la universidad de Illinois, encabezados por John Rogers, han estado elaborando una cámara inspirada en los ojos de insectos como moscas y abejas, en la que podremos manejar unos 180 microlentes que nos dan un ángulo de visión de 160 grados, lo que sería una gran ayuda en asuntos de seguridad y hasta medicina. Imagínense una endoscopía con este tipo de microcámara, usando la misma tecnología de Lytro, uno podría ver hacia todos lados sin tener que indagar por mucho tiempo al paciente. En cuanto a posibilidades creativas, imaginen un celular con uno de estos lentes compuestos, uno podría captar fotos de diversas formas, que incluyen por ejemplo una versión de la imagen con múltiples puntos de enfoque, o quizás una imagen compuesta con la resolución mejorada (deducida de las resoluciones menores de todos los sensores, similar a esto). Las posibilidades son numerosas. fuente - vía autor: emmanuel bretón |

|

|

|

|

|

sábado, mayo 4, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Heather Dewey-Hagborg es una forense estadounidense, que tiene un hobby algo extraño: Se dedica a recoger basura en la calle que pueda contener ADN humano (gomas de mascar, cabellos, cigarros, etc), para luego extraerlo y crear en impresoras 3D unas máscaras realísticas de los rostros de personas que estos ADN describen. Heather Dewey-Hagborg es una forense estadounidense, que tiene un hobby algo extraño: Se dedica a recoger basura en la calle que pueda contener ADN humano (gomas de mascar, cabellos, cigarros, etc), para luego extraerlo y crear en impresoras 3D unas máscaras realísticas de los rostros de personas que estos ADN describen.Vean su galería aquí fuente Observaciones de José Elías Si se preguntan ¿cómo puede esta mujer hacer esto? Recuerden que nuestro ADN nos describe de forma bastante fiel, especificando detalles como el color de nuestra piel, el tipo de cabello y color de este, el color de nuestros ojos, el tamaño y forma de nuestras narices y orejas, nuestra descendencia étnica, el tamaño de varios músculos en la cara, nuestra configuración craneal, etc, así que lo que ella hace es interpretar esos factores genéticos y traducirlos a caras (o en otras palabras, haciendo manualmente lo que la naturaleza hace naturalmente por su cuenta mientras evoluciona un óvulo a una persona). Noten que las caras no serán fiel al 100% a las personas de cuyo ADN ella obtiene las muestras, pero podemos decir que es una representación aproximada, lo que de paso ayuda al campo de la investigación forense a la hora de resolver crímenes y otros temas que conlleven a identificar personas por su ADN. autor: idrialis castillo |

|

|

|

|

|

|

|

NOTA: Este es un artículo invitado en eliax.com

Google se ha lanzado de nuevo a la batalla contra el molestoso malware con su nuevo servicio llamado 'CAMP'. Google se ha lanzado de nuevo a la batalla contra el molestoso malware con su nuevo servicio llamado 'CAMP'.Para los que no sepan, malware es cualquier tipo de programa descargado por internet que se disfraza como (o dentro de) otro programa con el fin de hacer cosas ilícitas, como son (1) robar nuestras claves, (2) espiarnos, (3) introducir anuncios sin nuestro consentimiento, (4) utilizar nuestras computadoras y celulares como soldados de ataque para cometer otras fechorías, etc. CAMP (Campamento, en inglés) es el acrónimo de "Content Agnostic Malware Protection" o "Protección Agnóstica de Contenido Malware" que, según los datos dichos en un simposio de seguridad y redes (en donde se presentó por primera vez recientemente), pueden evitar hasta el 99% de los casos presentados (que en este caso consistió en descargar programas de fuentes desconocidas). Aún no hay fecha oficial para la salida de este servicio, pero se sabe que estará disponible pronto, y la idea es que sea parte de la distribución normal del navegador Google Chrome y otros navegadores. La idea detrás de CAMP es sencillamente que exista un protocolo entre el servidor del archivo a descargar, y el navegador web, para verificar que lo que se descargará es auténtico y que no ha sido modificado por terceros, y que proviene de una fuente confiable. Esto será un alivio para todas aquellas personas que aún no entienden bien el funcionamiento del malware y suelen estar constantemente afectados por este mal. descripción oficial del proyecto (PDF, en inglés) autor: emmanuel bretón |

|

|

|

|

|

miércoles, mayo 1, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

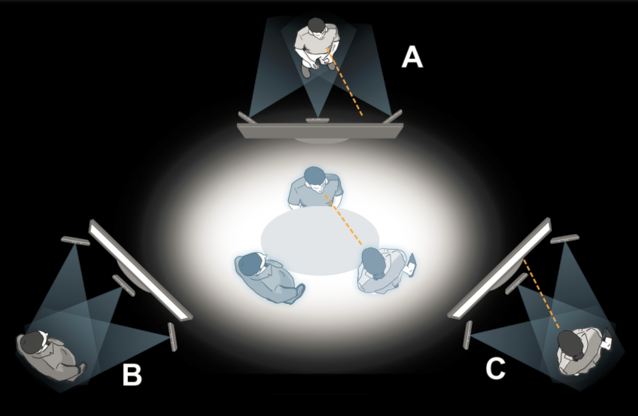

Microsoft está desarrollando un sistema de telepresencia 3D para integrar con Skype, que permitirá hacer que las teleconferencias de reuniones laborales, se acojan a un ambiente de realidad virtual, ofreciendo una experiencia de video y sonido de alta calidad. Microsoft está desarrollando un sistema de telepresencia 3D para integrar con Skype, que permitirá hacer que las teleconferencias de reuniones laborales, se acojan a un ambiente de realidad virtual, ofreciendo una experiencia de video y sonido de alta calidad. Un sistema de telepresencia es uno en el cual se usan proyecciones u hologramas para proyectar en un asiento a una persona que se encuentra en otro lugar remoto de similar estructura, a fin de dar la ilusión que desde el punto de vista de cada participante, todos aparenten estar en el mismo lugar físico. Esto no es algo nuevo, y de hecho muchas empresas (como CISCO) han invertido mucho dinero en sus propios salones de telepresencias para sus reuniones de negocios, y hasta los rentan a terceros a precios muy caros. Sin embargo, el hecho de que Microsoft esté trabajando de manera particular en esto y que tenga como objetivo integrarlo a Skype, dará apertura a la independencia comunicativa entre las empresas y quizás permita masificar esta tecnología al público en general. fuente autor: idrialis castillo |

|

|

|

|

|

|

|

NOTA: Este es un artículo invitado en eliax.com

Al parecer el dispositivo de realidad virtual Oculus Rift está en la mira de los psiquiatras y neurólogos, ya que muchos de ellos aseguran que no solo será el Santo Grial de los videojuegos y mundos virtuales, sino que también será el futuro para revolucionar las terapias de salud mental.

De hecho, el doctor Alberto Rizzo, científico investigador del Instituto para Tecnologías Creativas de la Universidad de California, ha estado utilizando el dispositivo con fines diferentes al entretenimiento, para así ir desarrollando todo un sistema que permita a los pacientes adentrarse en una realidad virtual creada especialmente para tratamientos de estrés post traumático. Y estos no son los primeros intentos del Dr. Rizzo, pues anteriormente él había creado un software de realidad virtual único en su tipo para tratar traumas de veteranos de guerras, por lo que quiere aprovechar el dispositivo Oculus Rift para recrear los ambientes que causan desórdenes mentales post traumáticos a todo tipo de pacientes y así poder darles tratamiento “in sito”, es decir, en el mismo escenario que ocasiona el problema. La forma de la terapia dependerá del tipo de trauma que las personas tengan. Lo cierto es que la Realidad Virtual no es como se tiende a creer, que solo son para videojuegos, va más allá, y es una plataforma multifuncional que abarca desde mundos virtuales, hasta dispositivos para entrenamientos, turismo, herramientas para tratamientos mentales y mucho más. fuente Video a continuación (enlace YouTube)... autor: idrialis castillo |

|

|

|

|

|

|

|

Científicos de IBM acaban de crear una película titulada "A Boy And His Atom" ("Un chico y su átomo"), cuyo nombre es muy apto, ya que esta es la película más pequeña del mundo. Literalmente.

La película fue creada a nivel atómico (por lo que cada punto que ven representa un átomo), y se creó con la técnica de stop-motion, en donde se tomaron 242 fotografías de los átomos en distintas configuraciones, para después ensamblar las fotos de forma secuencial en una película. Wow... Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, abril 30, 2013

|

|

Hoy quiero dejarlos con una de las demostraciones técnicas más asombrosas que hayan visto, originando en algo que ya habíamos visto antes (ver por ejemplo esto acá mismo en eliax), pero adaptado ahora al mundo de los videojeugos.

La tecnología fue creada en parte por Microsoft Research (el brazo de Investigación y Desarrollo de Microsoft), y los rumores apuntan a que será una opción que vendrá en la próxima iteración del Xbox a anunciarse el próximo mes. La idea detrás de IllumiRoom es bastante sencilla, y se trata de proyectar una imagen (con un proyector de video tradicional) encima y afuera de la TV, cubriendo gran parte de la pared en donde sea que tengas la TV para jugar con tu Xbox. Esto, a simple vista, aparenta que no aportaría mucho, particularmente dado el tema de que no todo el mundo tiene una pared plana detrás o alrededor de su TV, pero es ahí en donde entra el otro ingrediente secreto: El Xbox Kinect... Sucede que el Kinect es un dispositivo que nativamente puede medir profundidad. Es decir, este puede "saber" la profundidad de los objetos que se ponen delante de este, por lo que si tienes una pared con estantes de libros, mesas, lámparas, etc, el Kinect puede informarle con mucha precisión al Xbox en donde están esos objetos. Esa información de profundidad después puede ser procesada por el Xbox, para en tiempo real poder distorsionar el video que envía al proyector, con el fin de que cuando la imagen del proyector llegue a la pared, a la mesa, a los estantes y las lámparas, aparente "derecho" otra vez, casi totalmente plano (aunque obviamente el efecto debe ser más convincente para los que se sienten jugando justo en frente de la TV). Esto, como verán, hace toda una diferencia, pues aparenta casi que todos los objetos alrededor de tu TV se tornen semi-invisibles, y se forme una "pared plana virtual" sobre la cual el Xbox puede proyectar todo tipo de imágenes, y lograr efectos que parecerían mágicos. Uno de esos efectos es hacer creer que estás distorsionando los objetos alrededor de la TV con una onda, algo que entenderán mejor al ver el video que les dejo acá abajo, el cual es importantísimo aclarar no fue retocado ni editado para agregar efectos especiales. Todo lo que verán en el video fue grabado y visto tal cual como lo verán en el video. Ahora a cruzar los dedos y esperar que esta tecnología realmente llegue al próximo Xbox, pues la verdad que las posibilidades para esto son inmensas... Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

lunes, abril 29, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Cuando hablamos de "Fractales" por lo general pensamos en imágenes generadas por computadora en donde una parte de la imagen se repite varias veces más dentro de sí misma. Pero lo que quizás algunos no sepan es que los fractales ocurren constantemente en todo lugar en la naturaleza, y hoy los envío a apreciar a algunos ejemplos de ellos. Cuando hablamos de "Fractales" por lo general pensamos en imágenes generadas por computadora en donde una parte de la imagen se repite varias veces más dentro de sí misma. Pero lo que quizás algunos no sepan es que los fractales ocurren constantemente en todo lugar en la naturaleza, y hoy los envío a apreciar a algunos ejemplos de ellos.En la fuente podrán ver ejemplos que van desde las formas y líneas de nuestros ojos, hasta la corteza de una coliflor Rumanescu (como en la imagen). enlace a las imágenes autor: emmanuel bretón |

|

|

|

|

|

|

|

NOTA: Este es un artículo invitado en eliax.com

Linden Lab, la empresa creadora de Second Life, el mundo virtual independiente de mayor uso en el mundo, ha dejado ver planes futuros en los que probablemente agreguen realidad virtual a su metaverso, utilizando la tecnología Oculus Rift (los fabricantes de dispositivos que agregan realidad virtual a video juegos). Linden Lab, la empresa creadora de Second Life, el mundo virtual independiente de mayor uso en el mundo, ha dejado ver planes futuros en los que probablemente agreguen realidad virtual a su metaverso, utilizando la tecnología Oculus Rift (los fabricantes de dispositivos que agregan realidad virtual a video juegos). Second Life, como mundo virtual y como software no ha evolucionado mucho que digamos en años recientes, pues solo es posible utilizarlo desde una computadora instalando un programa especializado, no cuenta con versión web (aunque se ha probado algunas 3 veces en sus 10 años), y tampoco tiene aplicaciones que permitan usarlo tal cual desde un smartphone o tableta, por lo que ya muchos consideran que usar Oculus Rift sería el “killer app” (la aplicación que haría que todos quieran darle uso) para Second Life. Pero eso dependerá mayormente de que Linden Lab se decida, y de ser así, de todas maneras tendríamos que esperar al 2014 o al 2015 para usar el Metaverso Linden con un Oculus Rift, aunque sí se han confirmado las pruebas, tanto por parte de los desarrolladores de Second Life como por parte de los de Oculus Rift. Hay quienes dudan que Linden Labs se lance a esto de la realidad virtual, pues a pesar de las crisis por las cuales atraviesan las industrias de los mundos de tecnología virtual, Second Life se mantiene con una economía estable y creciente (lo que no deja de sorprender a quienes no usan este mundo), y algunos entienden que no necesitan “reinventarse” de esa manera. Como usuaria de Second Life, sí entiendo que un dispositivo de realidad virtual ayudaría a que nos integráramos al metaverso, y que la experiencia en primera persona que ya tienen los usuarios, pase a tener sensaciones más reales y una participación directa de nuestro cuerpo físico en ese mundo virtual. Sin embargo, como negociante e inversionista, no creo que este dispositivo vaya a significar alguna diferencia en la economía interna ni creo que el grueso de los usuarios morirían por esto. fuente Observación de José Elías Independientemente de si el Oculus Rift es adaptado y adoptado o no en Second Life, que no quepa duda que la realidad virtual es el futuro de estos mundos virtuales, pues sencillamente es la manera más lógica de uno interactuar naturalmente en ellos. A mi personalmente me gustaría ver este experimento a flote lo antes posible, pues sea exitoso o no, cuando menos proveería de datos de uso bastante valuables a sus diseñadores para posteriores iteraciones de esta tecnología. autor: idrialis castillo |

|

|

|

|

|

viernes, abril 26, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Un grupo de estudiantes mexicanos han realizado una interesante propuesta de tener una animación alternativa del dibujo iluminado que indica a los transeuntes que pueden caminar con seguridad al cruzar una calle. Un grupo de estudiantes mexicanos han realizado una interesante propuesta de tener una animación alternativa del dibujo iluminado que indica a los transeuntes que pueden caminar con seguridad al cruzar una calle. Este es un proyecto de un estudiante de la UNAM (Universidad Nacional Autónoma de México) llamado Adrián Santuario, quien ha modificado algunos semáforos del campus como proyecto a participar en un certamen. El resultado puede verse más a bajo en un vídeo tomado desde el mismo campus. El proceso del proyecto está publicado en un blog donde el autor ha puesto el paso a paso de todo lo que ha hecho. Aunque el concurso fue en 2010, no deja de ser interesante hoy día, y considero este trabajo un mensaje positivo que se le transmite a la gente en medio de una ajetreada vida de estrés y trabajo. enlace oficial del proyecto enlace a su página en Facebook Video a continuación (enlace YouTube)... autor: emmanuel bretón |

|

|

|

|

|

|

|

He aquí un video grabado con un tipo de lentes especiales llamados Tilt-Shift, en donde los componentes del lente no son paralelos al sensor de la cámara, lo que produce un particular efecto de profundidad de campo haciendo que cosas lejanas y cercanas se vean muy borrosas, y que el enfoque sea en un área muy particular de la imagen.

Esto crea la ilusión de que estamos viendo objetos muy pequeños que aparentan juguetes, pero aunque no lo crean, todos los objetos (desde automóviles hasta barcos y edificios) que verán en el video, son de tamaño real. Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

miércoles, abril 24, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Hoy les presento un proyecto llamado "24 x 360" en donde nos muestran asombrosas imágenes que combinan la técnica de "Lightpainting" ("pintando con luz"), con la técnica de "bullet time" (el efecto visto en la película The Matrix en donde la cámara aparentaba que congelaba el tiempo). Hoy les presento un proyecto llamado "24 x 360" en donde nos muestran asombrosas imágenes que combinan la técnica de "Lightpainting" ("pintando con luz"), con la técnica de "bullet time" (el efecto visto en la película The Matrix en donde la cámara aparentaba que congelaba el tiempo).Lo que verán en la fuente son animaciones a 360 grados, que han creado utilizando 24 cámaras simultáneas (como puede verse en esta imagen en donde muestran la configuración de planta), cuyas imágenes son unidas mediante software y así crear una vista a 360 grados las imágenes presentadas. Las imágenes fueron hechas por Patrick Rochon, de Timecode Lab, y Eric Paré, artistas que además de tener un gran equipo de soporte, tienen una vasta experiencia en módulos 360 que han llevado a ferias y eventos en muchas partes del mundo. Noten que cada cierto tiempo salgo con mis amigos a realizar Lightpaintings de noche, y la técnica a usar es la siguiente: Con la cámara apoyada a un trípode, abrimos el obturador de nuestra cámara (algunos la configuran por unos 15 o más segundos, otros usan control remoto que les permite tenerlo abierto el tiempo que sea) y a continuación, alguien con una linterna empieza a hacer trazos en el aire apuntando siempre a las cámaras; los resultados suelen ser como este (o miren estos realizados por José Elías en la azotea de mi casa). En cuanto al proyecto 24x360, espero algún día inventar algo así... enlace a las animaciones (noten que cada imagen les lleva a la animación de 360 grados) autor: emmanuel bretón |

|

|

|

|

|

|

|

NOTA: Este es un artículo invitado en eliax.com

Científicos de la universidad de Stanford, en California, han desarrollado una técnica llamada "Clarity" (Claridad) que permite literalmente poder ver el cerebro como si fuera transparente, logrando así un avance sin precedentes que puede ayudar al estudio de enfermedades cerebrales. Y la misma técnica puede aplicarse a otros órganos.

En el vídeo explican como sustituyen las membranas lípidas (de grasa) en el cerebro utilizando una sustancia llamada Hidrogel, logrando que sus paredes biológicas sean transparentes, así pudiéndose apreciar su estructura y composición interna, sin necesidad de recurrir al método actual de seccionar (cortar) la corteza y perder su estructura original. Con esto podremos en un tiempo obtener resultados de estudios realizados a enfermedades como el parkinson o el autismo, pudiendo tal vez dar con una cura en un futuro. Estaremos muy atentos aquí en eliax a los avances que este esperanzador descubrimiento promete traernos. Video a continuación (enlace YouTube)... autor: emmanuel bretón |

|

|

|

|

|

martes, abril 23, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Cuando compramos un dispositivo con pantalla grande (sea una TV o pantalla para nuestra computadora/ordenador) no tenemos en cuenta cuáles son las diferencias dentro de cada tipo de las hoy populares y disponibles en el mercado, así que a veces compramos algo esperando un resultado que no obtenemos sólo por que no sabíamos, así que hoy los dejo con algunas aclaraciones de algunas de ellas. Cuando compramos un dispositivo con pantalla grande (sea una TV o pantalla para nuestra computadora/ordenador) no tenemos en cuenta cuáles son las diferencias dentro de cada tipo de las hoy populares y disponibles en el mercado, así que a veces compramos algo esperando un resultado que no obtenemos sólo por que no sabíamos, así que hoy los dejo con algunas aclaraciones de algunas de ellas.Primero, los tipos de pantallas más populares son los LCD, Plasma, LED y OLED. Cada uno posee características muy similares, pero en detalle son diferentes, por lo que cuando buscamos una, por ejemplo, para vídeo juegos, debemos tener en cuenta incluso el lugar donde vamos a poner la pantalla, pues si es un poco oscuro o no ya esto influye en el resultado que podríamos estar esperando. Leer el resto de este artículo... autor: emmanuel bretón |

|

|

|

|

|

lunes, abril 22, 2013

|

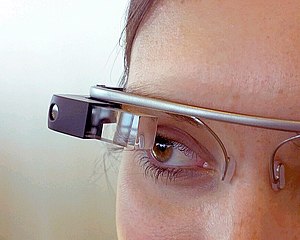

Como muchos lectores de eliax saben, soy uno de los que espera con ansias la Era de las Gafas Inteligentes (hoy día ejemplificado por el Google Glass), o Lentes de Contactos Biónicos (lo que vendrá después, como el IrixPhone), y he expresado en varios artículos (como esta Reflexión, o esta otra, o esta otra, o esta otra) el tremendo potencial que tiene esta tecnología. Sin embargo, tampoco me ciego al hecho de que existen serias barreras para que esta tecnología se masifique, y de eso quiero hablar hoy... Como muchos lectores de eliax saben, soy uno de los que espera con ansias la Era de las Gafas Inteligentes (hoy día ejemplificado por el Google Glass), o Lentes de Contactos Biónicos (lo que vendrá después, como el IrixPhone), y he expresado en varios artículos (como esta Reflexión, o esta otra, o esta otra, o esta otra) el tremendo potencial que tiene esta tecnología. Sin embargo, tampoco me ciego al hecho de que existen serias barreras para que esta tecnología se masifique, y de eso quiero hablar hoy...En mi opinión, la barrera más grande que tienen las gafas inteligentes es el interfaz de usuario para manipular la información que estas presentan. Otras barreras como el costo, tamaño, duración de la batería, resolución de la pantalla, visualización estereoscópica, y recepción de sonido, se resolverán al corto plazo, pero el tema del interfaz será el verdadero dolor de cabeza. Hoy día, la gran mayoría de analistas asumen que todo esto se resolverá con el tema de reconocimiento de voz, pero veo un serio problema con eso... Leer el resto de este artículo... autor: josé elías |

|

|

|

|

"Excelente articulo. Y por desgracia esta en una zona gris que requiere de mucha educación, cultura y entendimiento para poder discernirlo...Y como casi todo en la vida la verdad es mucho mas grande y amplia de lo que aparenta."

en camino a la singularidad...

©2005-2024 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax