Realidad Virtual

|

jueves, diciembre 19, 2013

|

|

Hace unos 41 años, Ed Catmull, con su amigo Frd Parke (ambos en ese entonces en la Universidad de UTAH en EEUU), crearon historia al crear la primera película renderizada completamente en 3D.

Hablamos de 1972, cuando todavía computadoras como la IBM PC, Apple II o Commodore 64 no habían sido ni siquiera soñadas, y en donde el término "Computadora Personal" aun no se había inventado, y lo que lograron estos dos es verdaderamente asombroso para la época (aunque noten esta otra noticia acá mismo en eliax, sobre la demostración técnica más asombrosa de todos los tiempos). Como apreciarán en el video, la primera animación que hicieron estos dos fue una versión digital de la mano izquierda de Ed Catmull, quien vale la pena mencionar, eventualmente fundaría PIXAR (que sería propiedad de Steve Jobs, y luego vendida a Disney), y hoy día es el Presidente de Disney, y de Disney Animation Studios. Esto de paso debe darnos una idea de lo asombrosamente rápido que evoluciona la tecnología, pues si a estos dos les hubiesen preguntado que si en el 2013 tendríamos dispositivos que caben en nuestras manos y que renderizarían en tiempo real escenarios casi fotorealistas, no lo hubiesen creído... ¡Gracias al lector Carlos David Correa por el video! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

sábado, noviembre 23, 2013

|

¿Recuerdan el Sensorix que imaginé el año pasado acá en eliax? Pues una pieza más del rompecabezas acaba de caer en su lugar, ya podemos hacer parte de sus capacidades hoy día con las gafas de las cuales les hablo hoy, las gafas Evena Eyes-On. ¿Recuerdan el Sensorix que imaginé el año pasado acá en eliax? Pues una pieza más del rompecabezas acaba de caer en su lugar, ya podemos hacer parte de sus capacidades hoy día con las gafas de las cuales les hablo hoy, las gafas Evena Eyes-On.Estas son unas gafas que permiten que enfermeras visualicen, en tiempo real, las arterias y venas de un paciente como si estas estuviesen encima de la piel, en vez de debajo de la piel, lo que hace ahora el buscar el punto de inserción de una jeringuilla algo totalmente trivial. Según la empresa, estudios revelan que es necesario "punchar" al paciente más de una vez en el 40% de los casos, algo que al menos yo puedo atestiguar al llevar a mis bebitos al doctor, y si ese problema se puede resolver con gafas como esta, tendrán no solo uno, sino que muchos clientes satisfechos. Las gafas funcionan con unas cámaras hiper-sensibles que pueden literalmente atravesar la piel y ver las arterias y venas, y en tiempo real un software analiza esas imágenes, resalta solo las arterias y venas (y no otras partes de la piel) y superimpone la imagen en tiempo real sobre la imagen de la piel de la persona, en esencia proveyendo de una forma de "visión de Rayos X" a quienes utilizan estas gafas. No dejen de ver el video que les muestra bastante bien el funcionando en vivo de las gafas. página oficial del producto Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, noviembre 19, 2013

|

Hoy les muestro una tecnología que es muy importante que entiendan que no funciona como mostrado en el video, que fue realizado sin duda alguna con fines mercadológicos y que no representa el producto real, sin embargo, continúen leyendo pues esto de todas formas es asombroso y sí les proveeré de un enlace que sí les muestras videos reales de uso. Hoy les muestro una tecnología que es muy importante que entiendan que no funciona como mostrado en el video, que fue realizado sin duda alguna con fines mercadológicos y que no representa el producto real, sin embargo, continúen leyendo pues esto de todas formas es asombroso y sí les proveeré de un enlace que sí les muestras videos reales de uso.Se trata de una tecnología de holografía médica llamada "RealView" ("Vista Real") por la empresa de mismo nombre, que tiene como fin el permitirle ver al médico en tiempo real una representación "holográfica" de los órganos internos del paciente (o de partes específicas del paciente), lo que como se pueden imaginar será una tecnología extremadamente útil para médicos. La idea es que con un escáner de alta resolución y tiempo real se pueda capturar el interior del cuerpo en 3D, y después utilizar esos datos 3D para desplegarlos también en tiempo real en un formato "holográfico". El video que acompaña este artículo acá abajo les da una idea del concepto detrás de la tecnología, pero es importante entender que ese video que ven no fue grabado de una sesión real, sino que fue creado con efectos especiales en post-producción. O en otras palabras, una cámara no puede grabar lo que ven en el video, y el doctor en ese video no está ni viendo ni interactuando con lo que el departamento de mercado nos quiere presentar. Lo que sí hace este sistema sin embargo (y esto lo deduje ya que he visto y trabajado con sistemas de este tipo de espejos en el pasado) es que el dispositivo curvo que vean detrás crea una imagen que da la ilusión de uno ver una imagen 3D flotando frente a uno, pero esa imagen solo se puede ver en el campo de visión de ese espejo curvo detrás. Así mismo la imagen desplegada no es realmente "3D" en el sentido de ser volumétrica, sino que es realmente una capa 2D que aparenta flotar en un espacio 3D, pero que al permitir rotar el objeto y manipularlo (una vez más, no con las manos, sino con un instrumento aparte) este da una ilusión bastante convincente de ser "en 3D". La mejor manera de imaginar esto en la vida real es imaginando lo siguiente: Imaginen que toman un iPad, y le quitan todo su marco y dejan solo la pantalla. Ahora hagan la pantalla transparente (de modo que uno pueda ver a través de ella), y ahora imaginen que en la pantalla 2D del iPad sale un corazón. Ese corazón es un corazón 3D pero dibujado en una pantalla 2D (de forma exacta como un juego de carros de carrera 3D lo vemos realmente en un televisor 2D). Ahora imaginen que ese iPad "flota" frente a ti y un espejo, y finalmente imagina que tienes un instrumento que te permite rotar y agrandar el corazón en la pantalla del iPad. Ese es más o menos el efecto final, con la diferencia de que no existe una pantalla de iPad transparente (ni ninguna otra pantalla), ya que la imagen se dibuja en una pantalla acostada detrás del espejo curveado, y es la curvatura del espejo lo que hace creer que lo que refleja el espejo "flota" ante nuestros ojos. Aun así, esto es espectacular, y abajo en los enlaces les dejo un segundo enlace en donde pueden ver videos de uso real del sistema. Finalmente, noten que esta tecnología es un primer paso hacia algo aun más avanzado que denomino el Sensorix, como imaginé en esta Reflexión acá mismo en eliax. ¡Gracias al lector Raimundo Hernandez Senegal por compartir el video en el grupo oficial de eliax en Facebook! página oficial de RealView casos de uso real de RealView Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

|

Según reportes (por confirmar), Apple acaba de comprar la empresa PrimeSense por US$345 Millones de dólares. Según reportes (por confirmar), Apple acaba de comprar la empresa PrimeSense por US$345 Millones de dólares.Si el nombre PrimeSense les suena familiar, es porque esta es la misma empresa que desarrolló la tecnología original del Kinect para el Xbox 360 de Microsoft, un área en donde PrimeSense no ha dejado de investigar y desarrollar, recientemente logrando miniaturizar su tecnología a tamaños amigables a tabletas o incluso celulares. Con esta empresa, Apple tiene acceso a tecnología que le permite interactuar con dispositivos electrónicos con simples gestos "en el aire", lo que complementaría bastante bien a Siri en futuros proyectos de Apple (como quizás, el rumoreado televisor, o al menos una versión futura de la cajita AppleTV). De paso, esto garantiza que Apple obtenga las patentes de PrimeSense sobre esta tecnología, esencialmente evitando que otros utilicen lo desarrollado por PrimeSense, forzándolos a inventar otros métodos (ojo, que esto no deberá afectar al Kinect de Microsoft, que de seguro ya tenía un buen acuerdo con PrimeSense antes de la empresa ser comprada). Y si quieren tener una buena idea de lo que es capaz esta tecnología, solo vean el video que les dejo más abajo acá mismo en eliax... página oficial de PrimeSense Video a continuación (enlace YouTube)... Actualización del 25 de Noviembre 2013: Apple confirmó la compra el día de hoy, por US$360 Millones de dólares. autor: josé elías |

|

|

|

|

|

sábado, septiembre 14, 2013

|

Hola amig@s lectores, Hola amig@s lectores,Hoy comparto con ustedes algo que escribí en una sola noche hace 20 años en el 1993, en donde decidí plasmar en unas cuantas páginas lo que en ese entonces imaginaba sería el Internet en unos cuantos años, y como verán, no solo se materializaron muchas de las cosas de las que hablé (bajo otros nombres), sino que incluso otras apenas están empezando a verse, y otras están todavía por verse. El documento se titula "On The Internet, Network Computing, and Virtual Environments" ("Sobre el Internet, Computación en la Nube, y Entornos Virtuales"), y ahí verán cosas que escribí hace dos décadas que presagian el Google Chrome OS, los interfaces móviles de hoy día en iPhone/iPad/Android, todo el tema de computación en la nube, y otras cosas que aun no han sucedido. El documento es literalmente un bosquejo personal, escrito literalmente para mi mismo, con notas para ser leídas por mi, recordatorios, etc. La idea es que esto iba a convertirse en un libro (al final decidí escribir otro, que se convirtió en Máquinas en el Paraíso), y por eso el formato tan informal. Noten que está escrito totalmente en inglés (en ese tiempo era mi primer idioma, y el español rara vez lo utilizaba), y que no tengo una versión en español, y que (como noto en el mismo documento) posteriormente en el 1998 lo modifiqué añadiendo ejemplos más actualizados (pero no modificando ni agregando nada nuevo de lo escrito en el 1993). Aparte de mis amigos más cercanos, ustedes son las primeras personas en el mundo que leen este documento (que encontré por casualidad en mi baúl de recuerdos digitales de cuando era un jovencito). Espero lo disfruten. Esto me trae muchísima nostalgia... :) Y si les gustó, quizás quieran leer mis predicciones para los próximos 100 años de la humanidad, y la sección de Reflexiones acá mismo en eliax. enlace al bosquejo del libro (PDF, 262 KB) Nota: Notarán en el texto que existe un "Capitulo 0" (cero) que hace referencia a 1995. Ese capítulo lo agregué en 1995 como una introducción al texto, posterior a la creación del capítulo 1 en 1993. Lo pueden llamar "locura de escritores" (y a eso me refiero a que el documento está "virgen", escrito en una forma no apta para consumo general en esa forma) :) autor: josé elías |

|

|

|

|

|

domingo, septiembre 8, 2013

|

|

El siguiente es un video que ya lleva varios días rondando por Internet (y que ha sido compartido varias veces en el grupo oficial de eliax en Facebook por varios lectores), y que no quería dejar pasar en el blog, pero como dicen, a veces más vale tarde que nunca... ;)

Se trata de un video demostrado por el visionario Elon Musk (el mismo de Tesla Motors y Space X), en donde demuestra un sistema (y como evoluciona) para diseñar partes mecánicas de forma virtual en 3D, y después imprimirlas en 3D, ofreciendo un rendimiento de productividad exponencial por sobre metodologías actuales. Notemos que cada elemento por separado de lo que demuestra Elon en el video no es nada nuevo, pero lo interesante es cuando se mezcla todo, dándonos un vistazo de lo que será el futuro... Y si les gustó este video, recomiendo vean este otro acá mismo en eliax. Noten además que esto es un paso más a esto de lo cual les hablé el año pasado... Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

sábado, junio 8, 2013

|

Un grupo de científicos acaba de dar un tremendo paso en el desarrollo de lentes de contacto con pantallas integradas al crear el primer dispositivo de este tipo con un lente flexible. Un grupo de científicos acaba de dar un tremendo paso en el desarrollo de lentes de contacto con pantallas integradas al crear el primer dispositivo de este tipo con un lente flexible.Hasta ahora, los lentes de contacto biónicos habían sido fabricados con lentes rígidos (duros) y no flexibles como los tradicionales lentes de contacto que millones de personas utilizan a diario, pero ahora con este adelanto se abren las puertas para la investigación en una nueva generación que sin duda serán mucho más cómodos para nuestros ojos. Por ahora lo que se ha desarrollado es un prototipo probado en ojos de conejos, y según las pruebas que duraban hasta 5 horas, durante todo ese tiempo los ojos de los conejos no mostraron señales de fatiga u otros efectos secundarios. En cuanto a cómo lograron esta hazaña, lo hicieron creando un "sandwich" en donde el "pan" consiste de dos capas de grafeno (el milagroso material que al igual que el láser parece tener usos virtualmente infinitos), y dentro de esas capas colocaron una capa de conductores transparentes conectados a un pixel LED. En este primer prototipo la pantalla tiene literalmente un solo pixel, pero la idea era probar que la técnica funcionara, por lo que el próximo paso es crear ahora un nuevo prototipo ya poblado con suficientes pixeles como para tener la resolución suficiente para formar imágenes complejas. Y si se preguntan para qué serviría esto en un futuro, pues para reemplazar todo tipo de pantalla exterior a nosotros, en esencia haciendo de nuestros ojos la pantalla. Esto por ejemplo reemplazaría las pantallas de celulares, y en un futuro quizás hasta las pantallas de tabletas y televisores, así como serían una gran paso hacia un mundo de Realidad Virtual a un nivel hasta hora imposible de obtener. Así que ya lo saben, hemos dado otro gran paso hacia el IrixPhone... fuente autor: josé elías |

|

|

|

|

|

martes, mayo 28, 2013

|

|

Hoy les presento una tecnología llamada Euclideon, una tecnología de renderización de datos masivos que sencillamente aparenta salir casi de la ciencia ficción...

En este caso en específico, el video que les muestro es sobre una aplicación específica de la tecnología al área geo-espacial (es decir, la visualización de datos geográficos), con un sistema al cual llaman Euclideon Geoverse. Pero, ¿qué es Euclideon? Pues es una nueva manera de renderizar gráficos, que en vez de depender de lineas y polígonos geométricos, depende de puntos, pixeles o voxels. ¿Pero qué significa eso? Pues les explico a continuación... Cuando se renderiza (dibuja en pantalla) un mundo virtual (como en los videojuegos que vemos mundos bastante realistas en 3D), es necesario mantener en memoria la geometría del mundo que se está visualizando, y después calcular metódicamente con una serie de algoritmos que "se ve en pantalla" y que no, incluyendo si hay reflexiones (como en agua), sombras, etc. Eso es un proceso bastante intensivo que dependiendo del tamaño del modelo y de como se renderice (sea por un método llamado "scanlines" o "raytraced") puede hacer que cualquier máquina se arrodille ante su operador y pida perdón. En esencia, mientras más grande y detallado es un mundo 3D para renderizar, más intensivo es el proceso de llevarlo a la pantalla, lo que se traduce o a una actualización gráfica bastante lenta (el video no se ve fluido) o a que se tome muchísimo tiempo en tan solo cargar los datos. Y cuando hablamos de modelos que incluyen ciudades enteras con todo el lujo de detalle, incluso las más potentes tarjetas de video sucumben ante la carga y la única solución es o (1) perder detalle de imagen, o (2) renderizar en granjas de varias tarjetas gráficas trabajando en paralelo, o (3) renderizar fuera de tiempo real para posteriormente ver el video. Pues la tecnología Euclideon resuelve todos esos problemas de una forma bastante genial: En vez de interpretar un mundo hecho de polígonos, lo que hace es que desconstruye el mundo virtual y lo convierte al equivalente de "atomos" (similar a la vida real). O en otras palabras, en vez de una caja virtual estar compuesta por 6 lados cuadrados, Euclideon descompone la caja y la reinterpreta como una caja compuesta por miles de pequeños puntos uno al lado de otro (lo que significa que para Euclideon funcionar, necesita hacer un trabajo de conversión de una sola vez en los archivos 3D). Después de eso, el algoritmo de Euclideon lo que hace es que se pregunta "¿Para este pixel/punto en específico de la pantalla, cuál es el átomo que corresponde en el modelo virtual?", y la respuesta a esa pregunta es precisamente lo que la empresa que ideo este método ha inventado, y es un algoritmo de búsqueda extremadamente rápida dentro de su sistema de archivo propietario. Euclideon es tan eficiente y rápido, que incluso funciona directamente sin tener que cargar el modelo a la memoria de la máquina, sino que es solo necesario acceder al archivo en el disco duro o red (incluyendo el Internet) para obtener los "átomos" del modelo y desplegarlos en tiempo real en pantalla mientras uno manipula el modelo interactivamente, lo que es algo verdaderamente asombroso. Noten sin embargo que aunque la empresa no lo menciona, después de yo entender como funciona esto, tengo el presentimiento de que esto solo funciona para modelos de iluminación "fija", ya que todos los átomos del modelo son precalculados, lo que significa que con esta tecnología (al menos que yo esté equivocado) no se pueden hacer efectos visuales en tiempo real como los que vemos en video-juegos en donde es posible ver el agua moviéndose y la reflexión de objetos en esa agua. Esto es más una herramienta para explorar mundos expansivos estáticos en tiempo real. Aun así, lo que lograron es verdaderamente alucinante y tiene grandes implicaciones prácticas para la visualización de grandes cantidades de datos. página oficial de Euclideon Geoverse Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

miércoles, mayo 1, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

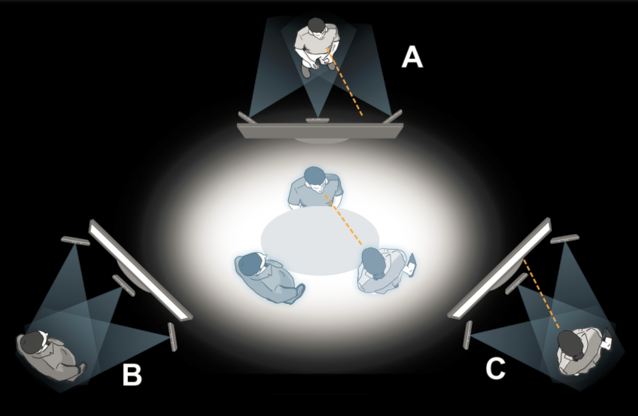

Microsoft está desarrollando un sistema de telepresencia 3D para integrar con Skype, que permitirá hacer que las teleconferencias de reuniones laborales, se acojan a un ambiente de realidad virtual, ofreciendo una experiencia de video y sonido de alta calidad. Microsoft está desarrollando un sistema de telepresencia 3D para integrar con Skype, que permitirá hacer que las teleconferencias de reuniones laborales, se acojan a un ambiente de realidad virtual, ofreciendo una experiencia de video y sonido de alta calidad. Un sistema de telepresencia es uno en el cual se usan proyecciones u hologramas para proyectar en un asiento a una persona que se encuentra en otro lugar remoto de similar estructura, a fin de dar la ilusión que desde el punto de vista de cada participante, todos aparenten estar en el mismo lugar físico. Esto no es algo nuevo, y de hecho muchas empresas (como CISCO) han invertido mucho dinero en sus propios salones de telepresencias para sus reuniones de negocios, y hasta los rentan a terceros a precios muy caros. Sin embargo, el hecho de que Microsoft esté trabajando de manera particular en esto y que tenga como objetivo integrarlo a Skype, dará apertura a la independencia comunicativa entre las empresas y quizás permita masificar esta tecnología al público en general. fuente autor: idrialis castillo |

|

|

|

|

|

|

|

NOTA: Este es un artículo invitado en eliax.com

Al parecer el dispositivo de realidad virtual Oculus Rift está en la mira de los psiquiatras y neurólogos, ya que muchos de ellos aseguran que no solo será el Santo Grial de los videojuegos y mundos virtuales, sino que también será el futuro para revolucionar las terapias de salud mental.

De hecho, el doctor Alberto Rizzo, científico investigador del Instituto para Tecnologías Creativas de la Universidad de California, ha estado utilizando el dispositivo con fines diferentes al entretenimiento, para así ir desarrollando todo un sistema que permita a los pacientes adentrarse en una realidad virtual creada especialmente para tratamientos de estrés post traumático. Y estos no son los primeros intentos del Dr. Rizzo, pues anteriormente él había creado un software de realidad virtual único en su tipo para tratar traumas de veteranos de guerras, por lo que quiere aprovechar el dispositivo Oculus Rift para recrear los ambientes que causan desórdenes mentales post traumáticos a todo tipo de pacientes y así poder darles tratamiento “in sito”, es decir, en el mismo escenario que ocasiona el problema. La forma de la terapia dependerá del tipo de trauma que las personas tengan. Lo cierto es que la Realidad Virtual no es como se tiende a creer, que solo son para videojuegos, va más allá, y es una plataforma multifuncional que abarca desde mundos virtuales, hasta dispositivos para entrenamientos, turismo, herramientas para tratamientos mentales y mucho más. fuente Video a continuación (enlace YouTube)... autor: idrialis castillo |

|

|

|

|

|

lunes, abril 29, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Linden Lab, la empresa creadora de Second Life, el mundo virtual independiente de mayor uso en el mundo, ha dejado ver planes futuros en los que probablemente agreguen realidad virtual a su metaverso, utilizando la tecnología Oculus Rift (los fabricantes de dispositivos que agregan realidad virtual a video juegos). Linden Lab, la empresa creadora de Second Life, el mundo virtual independiente de mayor uso en el mundo, ha dejado ver planes futuros en los que probablemente agreguen realidad virtual a su metaverso, utilizando la tecnología Oculus Rift (los fabricantes de dispositivos que agregan realidad virtual a video juegos). Second Life, como mundo virtual y como software no ha evolucionado mucho que digamos en años recientes, pues solo es posible utilizarlo desde una computadora instalando un programa especializado, no cuenta con versión web (aunque se ha probado algunas 3 veces en sus 10 años), y tampoco tiene aplicaciones que permitan usarlo tal cual desde un smartphone o tableta, por lo que ya muchos consideran que usar Oculus Rift sería el “killer app” (la aplicación que haría que todos quieran darle uso) para Second Life. Pero eso dependerá mayormente de que Linden Lab se decida, y de ser así, de todas maneras tendríamos que esperar al 2014 o al 2015 para usar el Metaverso Linden con un Oculus Rift, aunque sí se han confirmado las pruebas, tanto por parte de los desarrolladores de Second Life como por parte de los de Oculus Rift. Hay quienes dudan que Linden Labs se lance a esto de la realidad virtual, pues a pesar de las crisis por las cuales atraviesan las industrias de los mundos de tecnología virtual, Second Life se mantiene con una economía estable y creciente (lo que no deja de sorprender a quienes no usan este mundo), y algunos entienden que no necesitan “reinventarse” de esa manera. Como usuaria de Second Life, sí entiendo que un dispositivo de realidad virtual ayudaría a que nos integráramos al metaverso, y que la experiencia en primera persona que ya tienen los usuarios, pase a tener sensaciones más reales y una participación directa de nuestro cuerpo físico en ese mundo virtual. Sin embargo, como negociante e inversionista, no creo que este dispositivo vaya a significar alguna diferencia en la economía interna ni creo que el grueso de los usuarios morirían por esto. fuente Observación de José Elías Independientemente de si el Oculus Rift es adaptado y adoptado o no en Second Life, que no quepa duda que la realidad virtual es el futuro de estos mundos virtuales, pues sencillamente es la manera más lógica de uno interactuar naturalmente en ellos. A mi personalmente me gustaría ver este experimento a flote lo antes posible, pues sea exitoso o no, cuando menos proveería de datos de uso bastante valuables a sus diseñadores para posteriores iteraciones de esta tecnología. autor: idrialis castillo |

|

|

|

|

|

lunes, abril 22, 2013

|

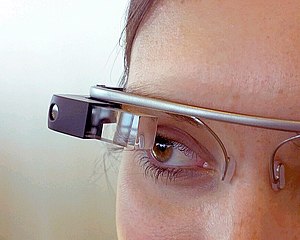

Como muchos lectores de eliax saben, soy uno de los que espera con ansias la Era de las Gafas Inteligentes (hoy día ejemplificado por el Google Glass), o Lentes de Contactos Biónicos (lo que vendrá después, como el IrixPhone), y he expresado en varios artículos (como esta Reflexión, o esta otra, o esta otra, o esta otra) el tremendo potencial que tiene esta tecnología. Sin embargo, tampoco me ciego al hecho de que existen serias barreras para que esta tecnología se masifique, y de eso quiero hablar hoy... Como muchos lectores de eliax saben, soy uno de los que espera con ansias la Era de las Gafas Inteligentes (hoy día ejemplificado por el Google Glass), o Lentes de Contactos Biónicos (lo que vendrá después, como el IrixPhone), y he expresado en varios artículos (como esta Reflexión, o esta otra, o esta otra, o esta otra) el tremendo potencial que tiene esta tecnología. Sin embargo, tampoco me ciego al hecho de que existen serias barreras para que esta tecnología se masifique, y de eso quiero hablar hoy...En mi opinión, la barrera más grande que tienen las gafas inteligentes es el interfaz de usuario para manipular la información que estas presentan. Otras barreras como el costo, tamaño, duración de la batería, resolución de la pantalla, visualización estereoscópica, y recepción de sonido, se resolverán al corto plazo, pero el tema del interfaz será el verdadero dolor de cabeza. Hoy día, la gran mayoría de analistas asumen que todo esto se resolverá con el tema de reconocimiento de voz, pero veo un serio problema con eso... Leer el resto de este artículo... autor: josé elías |

|

|

|

|

|

sábado, abril 20, 2013

|

El año pasado escribí un editorial titulado "Hora de hacer la Realidad Virtual, real...", y por lo que veo, alguien escuchó... El año pasado escribí un editorial titulado "Hora de hacer la Realidad Virtual, real...", y por lo que veo, alguien escuchó...El video que les presento a continuación es el resultado de combinar las gafas de Realidad Virtual del Oculus Rift, con un nuevo accesorio llamado el Omni de la empresa Virtuix (una empresa que se especializa en el mercado de la Realidad Virtual), y como podrán ver, el resultado es fenomenal. En esencia, el Omni es una caminadora estacionaria pero que permite que camines en cualquier dirección, los 360 grados a tu alrededor, mientras te mantiene en el mismo lugar (el video hará evidente lo que estoy diciendo), y que al combinar con el Oculus Rift nos ofrece una de las mejores experiencias de Realidad Virtual que un consumidor promedio podría obtener hoy día. Noten que este concepto ha existido por años en laboratorios y parques de atracciones especializados (yo los he probado casi todos, pues incluso en mi universidad teníamos un departamento de Realidad Virtual), pero esta es la primera vez que (1) el hardware es lo suficientemente potente, (2) el hardware es lo suficiente barato, y (3) tenemos software que toma ventaja de ese hardware. Noten que así como se financió el Oculus Rift en Kickstarter, que así mismo planea la empresa Virtuix financiar el Omni próximamente (posiblemente en Mayo 2013). Solo imaginen ahora combinando el poder de la próxima generación del PlayStation o Xbox con esto y ya entenderán por qué muchos de nosotros tendremos que ir al baño a hacer la número uno después de ver este video... página oficial de Virtuix página oficial del Oculus Rift Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, marzo 26, 2013

|

Hoy los dejo con el asombroso resultado de una colaboración entre el Cambridge Research Lab de Toshiba y la University of Cambridge, en donde han perfeccionado un software de cara sintética que imita al ser humano de una forma verdaderamente asombrosa... Hoy los dejo con el asombroso resultado de una colaboración entre el Cambridge Research Lab de Toshiba y la University of Cambridge, en donde han perfeccionado un software de cara sintética que imita al ser humano de una forma verdaderamente asombrosa...A este software que verán en el video (en donde también escucharán a los diseñadores explicar lo que verán) lo han llamado Zoe, y lo crearon de una forma bastante especial: En vez de crear "a mano" animaciones faciles, estos científicos en esencia le mostraron a un software de inteligencia artificial miles de videos y voces de la actriz británica Zoe Lister, para que el software aprendiera los más mínimos detalles asociados con músculos faciales en combinación con sonidos fonéticos. El resultado como verán es impresionante. Noten que tanto la renderización como la voz digital que verán es hecho en tiempo real, y no es descabellado imaginarnos un futuro cercano en donde todos tengamos un asistente artificial similar a este video. Esta es una pieza más del rompecabezas para un futuro similar a este. fuente original Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, febrero 12, 2013

|

Hace un tiempo atrás en una de mis Reflexiones les describí un dispositivo del futuro que acuñé el Sensorix, un dispositivo de avanzada que para mucho no era más que ciencia ficción. Hace un tiempo atrás en una de mis Reflexiones les describí un dispositivo del futuro que acuñé el Sensorix, un dispositivo de avanzada que para mucho no era más que ciencia ficción.Pues bienvenidos a la ciencia realidad... Hoy los muestro un video de una tecnología de la empresa Christie (que se especializa en instrumentos médicos) que hace ya hoy día una de las funcionalidades del Sensorix: La capacidad de ver debajo de la piel humana en tiempo real. El dispositivo de Christie se llama el VeinViewer ("Visor de Venas"), y se trata de un dispositivo que combina una cámara infrarroja (para ver las venas a través de la piel) con un micro-proyector. La cámara capta la imagen de las venas, mientras el micro-proyector procesa el video en tiempo real y re-envía la imagen de las venas proyectadas de vuelta sobre la piel de la persona. En esencia, el VeinViewer "dibuja" sobre la piel del paciente las venas que están debajo de la piel, como si de un tatuaje interactivo se tratara. Ahora, solo imaginen que en vez de un microproyector, utilizamos unas gafas inteligentes que proyectan la imagen sobre nuestras retinas en nuestros ojos y ya se imaginarán un poco mi idea del Sensorix... página oficial del producto Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

domingo, enero 6, 2013

|

Primero fue Google con sus gafas inteligentes a las que bautizó como Google Glass, y poco después Apple empezó a llenar patentes de sistemas similares al Google Glass, y ahora le ha tocado el turno a Microsoft de también llenar sus propias patentes… Primero fue Google con sus gafas inteligentes a las que bautizó como Google Glass, y poco después Apple empezó a llenar patentes de sistemas similares al Google Glass, y ahora le ha tocado el turno a Microsoft de también llenar sus propias patentes…En el caso de Microsoft y una nueva patente en específico, detallan un sistema bajo el cual será posible utilizar unas gafas inteligentes para sobre-imponer información de Realidad Aumentada sobre eventos en vivo (citan específicamente a eventos deportivos). Así que por ejemplo si estás en un estadio de baseball, podrías ver flotando sobre el cuerpo del lanzador un cuadro con todo su historial estadístico, o quizás la velocidad de la bola que acaba de lanzar. Similarmente, si estás en un juego de fútbol podrías ver las estadísticas del portero con solo mirar hacia este, e incluso quizás podrías ver la dirección más probable en que este saltará basado en datos anteriores. Sin embargo, lo importante de todo esto es que todos los grandes de la industria ya están pensando sobre lo que podría ser la próxima ola de innovación más allá de celulares inteligentes y tabletas, y aunque nadie sabe si las personas se interesarán en tener este tipo de gafas todo el día, yo pienso que tarde o temprano esa será la tendencia, y así como hubo en tiempo en donde muchos no se imaginaban andar con un celular todo el tiempo con nosotros, así mismo llegará el momento en donde no nos podremos imaginar haber vivido sin gafas o lentes de contacto biónicos para dotarnos de información constante sobre todo el mundo que nos rodea… autor: josé elías |

|

|

|

|

"No cabe duda que estamos viviendo ya el pleno camino a la Singularidad Tecnológica."

en camino a la singularidad...

©2005-2025 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax