Tecnología Visual

|

lunes, agosto 5, 2013

|

|

Una de las cosas más importantes y útiles en cualquier evento deportivo (sea en vivo en un estadio, o remotamente por TV/Internet), es la capacidad de uno poder ver una repetición de algo ocurrido, sea un gol, un home-run, o un touch-down.

Y ahora, una empresa japonesa planea llevar el tema de las repeticiones a todo un nuevo nivel, permitiendo ver con lujo de detalles una repetición a 360 grados, a todo alrededor de la acción, no muy distinto al efecto "bullet time" que vimos en la película The Matrix. Para lograr el efecto sin embargo, se utiliza un equipo de cámaras mucho más sofisticadas que las cámaras fijas utilizadas en Matrix. En este caso, se colocan varias cámaras a todo el alrededor del estadio, y en conjunto a ellas se coloca una "cámara maestra" operada por un especialista. Ese especialista en esencia mueve su cámara maestra a cualquier punto de interés en el medio de la acción, y mientras mueve esa cámara todas las otras cámaras alrededor del estadio se mueven sincronizadamente siguiendo el mismo objetivo y grabando video constantemente. Después, en cualquier momento un director del evento puede pedir una repetición de 360 grados, y en ese momento, en tiempo real, un software y hardware especializado toma todas las imágenes de todas las cámaras, combina todas las imágenes, las estabiliza para que compaginen unas con otras, e incluso recrea cuadros faltantes entre una cámara y otra de forma virtual, para tener entonces un ensamblaje de imágenes que abarcan los 360 grados alrededor de la acción (digamos, del pie de un jugador pateando un gol ganador). En ese momento, el director puede girar una palanca en cualquier dirección, para mostrar congelado en el tiempo o en movimiento, la acción desde cualquier ángulo imaginable alrededor de la acción. Y si esto aun no lo entienden, no dejen de ver el video a continuación que les muestra visualmente cómo funciona todo esto. fuente Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

|

|

Hoy los dejo con un video que les aseguro los impresionará, y que posiblemente no verían al menos que alguien insista en que lo vean.

Es un muy breve video que explica una técnica desarrollada en los laboratorios de investigación y desarrollo de Disney, que permite calcular por medio de un software especializado el conjunto de engranajes necesarios para recrear cualquier movimiento repetitivo (como el caminar de un tigre, o el baile de una persona, o el batir de alas de un ave). Esto es algo que sencillamente hay que ver para entender, pues palabras no le hacen justicia a lo ingenioso de este software. Estoy seguro que si Leonardo DaVinci estuviese vivo hubiera sido él quien hubiese inventado esto con la tecnología disponible hoy día. Ya me imagino algunos "animatronics" de Disney utilizando esta tecnología en sus parques de atracciones temáticos, como Jurassic Park. Así mismo me puedo imaginar una linea de juguetes que utilice estos principios para crear movimientos altamente fluidos a base de engranajes de cuerda. ¡Gracias al lector Danny Esteban Garzon por compartir el video en el grupo oficial de eliax en Facebook! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

jueves, agosto 1, 2013

|

Intel quiere entrar al negocio de la TV (fuente), y planea hacerlo con un tremendo diferenciador, para el cual compuso un equipo de 350 personas y tratar de revolucionar la forma en que consumimos TV. Intel quiere entrar al negocio de la TV (fuente), y planea hacerlo con un tremendo diferenciador, para el cual compuso un equipo de 350 personas y tratar de revolucionar la forma en que consumimos TV.¿Cómo? Con la nube de Internet. El plan de Intel es bastante sencillo: Imaginen que Intel tiene un conjunto de servidores de video alojados en algún lugar de Internet, que están constantemente (las 24 horas, los 365 días del año) grabando todos los canales de TV (de TV abierta, local, cable, Internacional, satelital, etc), y hacerlos disponibles para ti en cualquier momento, desde cualquier dispositivo, sin tu siquiera tener que poseer una caja especial conectada a tu TV (al menos que quieras ver el programa directo en la TV por supuesto). La idea es grabar 3 días continuos de programación, de modo que en cualquier momento posterior a la emisión de un programa, tengas hasta 3 días para verlo en cualquier horario que quieras, muy similar a los DVR (Digital Video Recorder) que vienen ya preinstalados en muchas cajas de cable. Después, cuando quieras ver cualquier programa emitido durante los pasados 3 días, podrás acceder a este desde una aplicación móvil en tu celular, tableta, o incluso PC, para disfrutarla en cualquier momento y desde cualquier lugar (Intel aun no ha dado detalles de restricciones por países y temas que siempre surgen en este tipo de tecnologías para dañar una buena idea). Y si quieres disfrutar el programa en una TV, podrás enviarla por distintos medios, desde tu PC conectada a esta, hasta por AirPlay con iOS, o en un futuro desde distintos dispositivos y televisores compatibles. Por el momento la empresa está probando esto con 2,500 de sus empleados, pero no sabemos todavía la fecha para cuando planea lanzar el servicio. Opinión eliax Sobre la superficie, la idea me encanta, pero es en la práctica en donde creo esta idea de Intel posiblemente caiga bajo su propio peso, por los siguientes motivos: 1. Verdaderamente dudo que Intel pueda hacer todo esto sin entrar en batallas legales con los creadores de contenido. 2. Debido al punto anterior, Intel tendrá que negociar con todo el mundo, y el resultado será el mismo de siempre: Una protección casi irracional de los proveedores de contenido que pondrán todo tipo de trabas para seguir con sus monopolios legales de contenido. 3. Y debido al punto anterior, es bastante posible que Intel no pueda ofrecer todo tipo de programación, en todos los mercados, y que tenga que hacer grandes sacrificios de contenido en distintas áreas geográficas (el gran problema que tienen hoy Google, Apple, Netflix, Amazon y toda empresa que quiera cambiar los actuales modelos de la TV tradicional). 4. El tema de grabar solo 3 días me lo encuentro muy restrictivo, incluso 7 días sería muy poco para muchas personas. 5. Me gusta mucho más un modelo similar al de Google/YouTube, Apple, Netflix y Amazon, basado en contenido independiente de horarios, en donde uno simplemente elija lo que quiera ver y listo, en cualquier momento futuro independientemente de si salió al aire solo hace 3 días o 3 años. 6. Lamentablemente, aunque Intel es un nombre reconocido por su asociación en PCs tradicionales, no tiene el peso que tienen empresas como Google o Apple en el espacio de consumo multimedia, por lo que su propuesta es una cuesta arriba. En resumen, una buena idea en teoría, pero colmada de "contras" en la práctica que creo harán que no sea tan exitosa como Intel piensa que será... Actualización Sep. 27 2013: Parece que tuve la razón, pues Intel anunció que no puede con el servicio de OnCue por sí sola, particularmente sin la colaboración de los que generan programación. fuente autor: josé elías |

|

|

|

|

|

jueves, julio 25, 2013

|

Google anunció esta semana un micro dispositivo del tamaño de una memoria USB que se conecta a tu televisor, y lo ha llamado el Chromecast, y a diferencia de muchos otros dispositivos similares, este me ha llamado mucho la atención... Google anunció esta semana un micro dispositivo del tamaño de una memoria USB que se conecta a tu televisor, y lo ha llamado el Chromecast, y a diferencia de muchos otros dispositivos similares, este me ha llamado mucho la atención...Pero, ¿qué es exactamente el Chromecast? Pues es un pequeño dispositivo que por un lado de conecta a tu TV por medio de un conector HDMI estándar, y por el otro se conecta a tu red WiFi, y es controlado directamente desde el navegador Google Chrome y otras aplicaciones compatibles. En esencia, el Chromecast funciona como un receptor de audio y video desde tus dispositivos móviles (sea iPhone, iPad, o Android), o PC (directo desde el navegador Google Chrome). La idea es que si por ejemplo estás viendo un video en YouTube, o escuchando una canción desde Google Music, o quizás viendo una película desde Netflix, que puedas "enviar" el video, la canción o la película directamente a tu TV de una forma fácil y simple, bastante similar a la tecnología AirPlay de Apple. Sin embargo, por lo que tengo entendido (pues por el momento hay poca documentación al respecto), ChromeCast funciona de manera diferente a AirPlay... En AirPlay, la idea es que un dispositivo local envíe audio y video directamente a la TV (u otro dispositivo), pero en ChromeCast el dispositivo que quiere enviar el video a la TV en realidad no envía el video directamente al Chromecast conectado a tu TV, sino que simplemente le indica desde donde obtener el video en Internet, y posterior a eso el video va directo desde el Internet al Chromecast, mientras que el dispositivo móvil y/o Chrome funcionan simplemente como un control remoto del video (o audio). Esto a propósito, para el que no lo haya notado, es en esencia el mismo mecanismo que Google ha estado probando desde hace ya bastante tiempo que permite controlar a YouTube en una TV desde un dispositivo externo, solo que ahora con este aparatito cualquier TV recibe desde cualquier dispositivo móvil o PC, lo que está genial. Noten que una limitación (que debo investigar si estoy correcto con esto, de lo contrario actualizo el artículo acá mismo en eliax), es que aparenta que esta tecnología de Google no te permitirá enviar cualquier video que tengas almacenado localmente en tu dispositivo móvil o PC a tu TV, pero por el precio no podemos quejarnos... Y el precio... A un precio de solo US$35 dólares esto cae directamente en territorio de "compra impulsiva" (yo ya ordené el mío por Amazon), y dado que lleva el nombre de "Google" y "Chrome" atado al producto, algo me dice que estos aparatitos no solo se venderán como pan caliente, sino que incluso podrían afectar el mercado de streaming de audio y video por Internet, el cual por el momento es dominado por dispositivos como el PlayStation 3, el AppleTV, y Roku. Noten además que Google ya acaba de hacer disponible un SDK (kit de desarrollo para desarrolladores) para que agreguen la tecnología de Chromecast a sus aplicaciones (y según Google, es bastante sencillo hacerlo). Finalmente, como bono adicional, Google incluye 3 meses gratis de Netflix con cada Chromecast vendido, lo que no está nada mal... anuncio oficial de Google sobre Google Cast SDK oficial de Chromecast (beta) página oficial de Chromecast en Google Play Chromecast en la tienda Amazon Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, julio 23, 2013

|

Disney acaba de refinar una técnica (de la cual ya les había hablado en el 2006 acá mismo en eliax) que permite tomar como entrada de datos una serie de fotos de alta resolución del mismo objeto, y produce una imagen 3D de alta calidad de forma automática. Disney acaba de refinar una técnica (de la cual ya les había hablado en el 2006 acá mismo en eliax) que permite tomar como entrada de datos una serie de fotos de alta resolución del mismo objeto, y produce una imagen 3D de alta calidad de forma automática.Como podrán imaginar, esto tiene mucha utilidad en varios campos, que van dede arquitectura (por ejemplo, para crear automáticamente una maqueta basado en un proyecto real), hasta cine (para capturar en 3D a objetos sin tener que escanearlos en 3D con hardware especializado), así como en video-juegos, instalaciones de arte, etc... Sin embargo, en vez de explicarles el concepto, simplemente sorpréndanse con el video que les dejo acá abajo. fuente oficial Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

viernes, julio 5, 2013

|

Hoy los dejo con un excelentísimo diagrama interactivo que les muestra el árbol evolutivo de todas las religiones del mundo, o en otras palabras, podrán apreciar en una linea del tiempo de cuáles religiones provienen cuáles otras religiones. Hoy los dejo con un excelentísimo diagrama interactivo que les muestra el árbol evolutivo de todas las religiones del mundo, o en otras palabras, podrán apreciar en una linea del tiempo de cuáles religiones provienen cuáles otras religiones.Como podrán apreciar en el diagrama interactivo, existen muchísimas más religiones y vertientes religiosas que las que uno se imagina, e irónicamente estas son un excelentísimo ejemplo de la Evolución en acción, pues nos muestra claramente como estas se adaptan a los tiempos según el medio ambiente en donde se desarrollan. Noten que lamentablemente la página con la gráfica interactiva requiere de un navegador Web con la extensión de Adobe Flash, por lo que no funciona en la mayoría de tabletas y celulares, pero les aseguro que vale la pena buscar una PC con un navegador tradicional tan solo para ver la imagen. Quedarán tan asombrados como yo... ¡Gracias Jose German Rodriguez por compartir en enlace en el grupo oficial de eliax en Facebook! enlace a la gráfica interactiva Actualización: Acá un par de enlaces relacionados e interesantes también: Este y este. autor: josé elías |

|

|

|

|

|

miércoles, julio 3, 2013

|

Daniel Smalley, un estudiante de post-grado del MIT (Instituto de Tecnología de Massachussetts) acaba de dar un gran avance en la realización de televisores holográficos... Daniel Smalley, un estudiante de post-grado del MIT (Instituto de Tecnología de Massachussetts) acaba de dar un gran avance en la realización de televisores holográficos...Recordemos que el propósito de la TV Holográfica (llamémoslo "HTV") es la de producir imágenes que aparentan sólidas y totalmente tridimensionales, flotando ante nuestros ojos, sin necesidad de gafas o de trucos especializados (como el sistema de rejillas utilizado por el Nintendo 3DS). En otras palabras, hablamos de una experiencia similar a la vida real, frente de nosotros. Sin embargo, el problema de generar hologramas en movimiento, y a todo color, ha sido un tremendamente grande problema de ingeniería, y a la fecha solo habíamos podido mover hologramas a unos muy pocos cuadros por segundo, con extremadamente baja resolución, con colores limitados, y a unos precios exhorbitantes. Pero con el nuevo avance permite no solo video a 30 cuadros por segundo, sino además a todo color, con resolución similar a TV estándar (no HD, pero solo por el momento), y a un costo similar a cualquier tecnología del mercado. Incluso, el componente especializado más caro del sistema, es un chip propietario desarrollado por Daniel dentro del mismo MIT a un costo de apenas US$10 dólares. Todo lo demás cuesta similar a cualquier TV de hoy día. Noten sin embargo que aun quedan unas cuantas barreras por resolver, y que esto no significa que detengan sus compras de TVs por el momento, ya que esta tecnología no se perfeccionará hasta quizás finales de la década para que sea práctica. Algunas de esas barreras son la resolución, consistencia de colores, cómo codificar el gran flujo de datos para crear un holograma de forma eficiente, cómo crear cámaras para capturar contenido de video holográfico de forma práctica, etc. Sin embargo, por otro lado, una ventaja tanjente de este sistema es la forma en que manipula la luz para generar una imagen, que es totalmente diferente a como la manejan los televisores convencionales, y que tiene el potencial de revolucionar la generación de imágenes en televisores normales de la actualidad (desde HDTV hasta 3DTV). Sucede que hoy día la manera en como se generan imágenes en televisores (y todo tipo de monitores y pantallas, incluyendo celulares y tabletas), es filtrando la luz por filtros. Esencialmente se genera luz pura de color blanco, y se divide la luz por tres filtros, uno rojo, otro azul, y otro verde, y después al variar la intensidad de esos tres colores se producen distintos colores (por ejemplo, subiendo la intensidad total del verde y el rojo, y apagando la intensidad del azul totalmente produce amarillo). El problema con este método es que los filtros destruyen hasta el 66% de la luz para poder filtrar los colores, y de paso hacen que los pixeles ocupen al menos 3 veces más espacio de lo que ocuparía un verdadero "pixel multicolor". Pero con la nueva técnica, se generan colores a nivel de las ondas mismas de luz electromagnética (gracias a unos nano-surcos que guían las ondas de luz), saliendo de esos nano-surcos un color puro determinado. O en otras palabras, de cada nano-surco (que es menor que un pixel compuesto convencional) sale cualquier color que uno lo desee sin necesidad de filtros, y en un espacio menor, y a costo menor. Esto implica pantallas de mucho mayor resolución, en un mucho menor tamaño, con mucho menos consumo energético, y con mucho mayor brillo y nitidez en los colores. El futuro, literalmente se pinta interesante... Nota: Esta noticia se apoya en esta otra de hace un par de años acá mismo en eliax. documento científico oficial fuente autor: josé elías |

|

|

|

|

|

lunes, junio 24, 2013

|

|

Recientemente se hizo muy popular en Internet (particularmente en redes sociales) el video de un equipo formado por un padre y un hijo en donde demostraron un sistema que puede esconder objetos (en esencia, hacerlos invisibles) en el espectro de luz visual que vemos los humanos, utilizando simples trucos ópticos.

Y hoy les comparto tanto el video original como un video que les muestra cual es el truco detrás de la técnica. Pero antes de continuar, noten que el gran problema con la técnica inventada es que tiene un ángulo muy pequeño desde donde funciona el efecto (es decir, debes estar casi al frente del truco para que haga efecto, y lo más lejos posible, de lo contrario se pierde la ilusión), sin embargo, la forma en que lo lograron es tan útil para algunas aplicaciones (los magos por ejemplo de seguro que ya están experimentando con esto), que en el documento científico que explica cómo esto funciona ya mencionan que esto tiene aplicaciones como para por ejemplo esconder satélites en órbita de ojos terrestres (o en otras palabras, para fines de espionaje), y también me puedo imaginar esto como un uso creativo en algún tipo de publicidad en ambientes abiertos. Video original demostrando el efecto a continuación (enlace YouTube)... Y en el siguiente video pueden ver cómo funciona la técnica, en donde explican que el truco está sencillamente en una configuración de espejos en ángulos de 45 grados, que esencialmente redireccionan la luz desde detrás de ti hacia adelante de ti (el video lo explica bastante bien el concepto). Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

|

|

Hola amig@s lectores,

Estas son algunas noticias recientes que pasaron y que no publiqué en eliax directamente (algunas las compartí por Twitter o Facebook), pero que no quería dejar para la audiencia principal del blog, así que aquí vamos... 1. Oxígeno y Marte  Según un estudio, hace aproximadamente 4 mil millones de años, Marte tenía una atmósfera rica en oxígeno, lo que ha hecho que nos concentremos aun más en buscar rastros presentes o pasados de vida en ese planeta hermano de nosotros. fuente Según un estudio, hace aproximadamente 4 mil millones de años, Marte tenía una atmósfera rica en oxígeno, lo que ha hecho que nos concentremos aun más en buscar rastros presentes o pasados de vida en ese planeta hermano de nosotros. fuente2. Estadísticas de WhatsApp  WhatsApp, como muchos ya sabrán, es la aplicación líder en el mundo en mensajería multi-plataforma (es decir, que funciona entre celulares iPhone, Android, Windows Phone, Blackberry, etc), y hasta recientemente la empresa nunca había ofrecido datos estadísticos oficiales sobre sus operaciones. Pero ahora la empresa ha dejado saber que tiene actualmente más de 250 millones de usuarios activos mensualmente en su plataforma. WhatsApp, como muchos ya sabrán, es la aplicación líder en el mundo en mensajería multi-plataforma (es decir, que funciona entre celulares iPhone, Android, Windows Phone, Blackberry, etc), y hasta recientemente la empresa nunca había ofrecido datos estadísticos oficiales sobre sus operaciones. Pero ahora la empresa ha dejado saber que tiene actualmente más de 250 millones de usuarios activos mensualmente en su plataforma.Para que tengan una idea, eso es más que Twitter (que tiene poco más de 200 millones de usuarios) y cerca de Skype que tiene unos 280 millones. Así mismo la empresa reportó que rompió un récord en mensajería al manejar durante un solo período de 24 horas (es decir, en un solo día) la alucinante cantidad de 27 mil millones de mensajes enviados. Y a propósito, WhatsApp ya maneja más mensajes constantemente que todas las operadoras de telefonía móvil de los EEUU combinadas. fuente 3. Gafas anti-reconocimiento facial Hoy día con tanta tecnología de reconocimiento facila, tanto por mano del gobierno como por empresas privadas (ver por ejemplo este sistema que puede escanear 36 millones de caras por segundo), no es ser paranóico que uno quiera proteger un poco su privacidad, y aunque unos investigadores han demostrado un prototipo de unas gafas que evitan que tu cara sea reconocida. Las gafas funcionan con un conjunto de 11 LEDs de luz casi infrarroja, cuya luz no puede ser vista a simple vista, pero que es vista por cámaras que utilizan reconocimiento de caras, a las cuales le resulta imposible detectar tus atributos faciales, ya que estas luces cambian el patrón de claro y oscuro de tus ojos y nariz, que son un par de los aspectos más importantes que estos sistemas de reconocimientos faciales utilizan. Los dejo con un video que les muestra el sistema en funcionamiento... Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

domingo, junio 23, 2013

|

|

Hoy les presento un video de una asombrosa tecnología siendo desarrollada en Japón que permite hacer algo que si tan solo se los describo, no le hará justicia al efecto final que logra, por lo que recomiendo vean el video.

Lo que la tecnología hace es permitir que cualquier tipo de cámara pueda dar seguimiento a super alta velocidad a cualquier objeto, y en esencia "enganchar" la vista al objeto todo el tiempo. Esto por ejemplo sería extremadamente útil y valioso en eventos deportivos televisados, en donde sería posible ver la pelota o bola en deportes como Fútbol, Baseball o Basketball, mientras esta es manipulada por los pies, manos u otras partes del cuerpo. El sistema funciona de forma bastante simple: Se coloca frente al lente de la cámara un sistema que contiene tan solo dos espejos, uno para moverse verticalmente y otro para moverse horizontalmente, y al combinar las posiciones de los dos es posible redireccionar la imagen que entra al lente desde cualquier ángulo posible. El otro componente del sistema es un "seguidor" de objetos, que cada milésima parte de un segundo procesa la imagen para ver en dónde se encuentra el objeto y ajustar los espejos para que la imagen que entra al lente siempre esté centralizada. Otro uso que tiene esta tecnología es la de permitir que proyectores de video desplieguen imágenes sobre objetos que se mueven a alta velocidad, lo que sería útil en aplicaciones de Realidad Aumentada. Pero como dije al principio, esto es algo que hay que ver para apreciar, y ya me puedo imaginar una escena en alguna película utilizando este nuevo efecto... Según los investigadores que están desarrollando este invento, la tecnología estará disponible en el mercado dentro de un par de años. ¡Gracias al lector Jason Gonzalez por compartir el video en el grupo oficial de eliax en Facebook! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

viernes, junio 21, 2013

|

Hoy los dejo con un super útil dispositivo que ya está a la venta, que permite que personas con serios problemas de visión puedan maniobrar mucho mejor en el mundo que los rodea. Hoy los dejo con un super útil dispositivo que ya está a la venta, que permite que personas con serios problemas de visión puedan maniobrar mucho mejor en el mundo que los rodea.El dispositivo, llamado el OrCam, es una pequeña cámara que se engancha sobre un par de gafas, que en esencia mira todo lo que tu verías con tus ojos, y te "lee" lo que ve con una voz sintética. Como verán en el ejemplo, el OrCam puede avisarte cuando una luz de semáforo cambia de rojo a verde, o el menú en un restaurante, o un artículo en un periódico, revista o (o hasta eliax), y hasta tiene la capacidad de memorizar productos y personas para que la próxima vez que las vea te diga su nombre. El producto ya está a la venta a un precio de introducción de US$2,500 dólares, lo que es una ganga para este tipo de tecnología. Por ahora para los que desarrollaron esta tecnología les tengo dos recomendaciones: 1. Pueden abaratar aun más el costo si en vez de un hardware especializado, utilizando un celular inteligente (sea iPhone o Android). 2. La voz sintética hay que mejorarla, pues ya existen en el mercado muchísimas opciones que suenan casi tan natural como una persona, y si implementan el punto 1 anterior, pueden quizás utilizar las facilidades de Apple y/o Google para sintetizar una voz mucho más realista. Pero aun así, este producto estoy seguro que significará un cambio del cielo a la tierra para muchas personas por lo que ofrece. No dejen de ver el video a continuación para más detalles. ¡Gracias al lector Pepe Pérez por el enlace! página oficial del OrCam Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

jueves, junio 6, 2013

|

Investigadores de la Universidad de Washington en los EEUU acaban de desarrollar una verdaderamente asombrosa tecnología que pronto nos permitirá manipular todo tipo de objetos a nuestro alrededor con gestos físicos, pero sin tener que contar con un sensor como el Kinect del Xbox o cámaras como la EyeToy del PlayStation 3. Investigadores de la Universidad de Washington en los EEUU acaban de desarrollar una verdaderamente asombrosa tecnología que pronto nos permitirá manipular todo tipo de objetos a nuestro alrededor con gestos físicos, pero sin tener que contar con un sensor como el Kinect del Xbox o cámaras como la EyeToy del PlayStation 3.¿Y cómo logran entonces detectar nuestros movimientos? Pues asombrosamente simplemente analizando las señales de WiFi que traspasan nuestro cuerpo constantemente... El sistema funciona detectando las mínimas variaciones que ocurren en las señales de WiFi cada vez que estas traspasan nuestro cuerpo, para detectar dos cosas: (1) Nuestra localización y (2) lo que estamos haciendo con nuestro cuerpo. La primera parte, el detectar en dónde estamos (por ejemplo, si estamos en la cocina, la sala, el baño o la habitación) es relativamente fácil en el sentido que con solo detectar el tiempo de respuesta de las señales hasta la base WiFi de nuestro hogar es suficiente para determinar esa información. Pero para la segunda parte es en donde se torna interesante... Debido a la gran complejidad de las señales generadas cada vez que uno camina o mueves los brazos en un lugar en donde existe WiFi, lo que estos científicos hicieron fue esencialmente no crear un algoritmo super-complejo que detectara esos patrones, sino que utilizar Inteligencia Artificial (con algoritmos que detectan y aprenden patrones por sí mismos) para que el software automáticamente se entrenada y aprendiera qué tipo de señales corresponde a qué tipo de movimientos corporales. Al combinar esos dos tipos de datos, los creadores de esta tecnología han logrado obtener un asombroso 94% de exactitud en detectar en dónde estás en tu casa, y qué gestos estás haciendo. y cuando vean el video entenderán mejor las posibilidades que esto nos traerá en un futuro relativamente cercano, particularmente cuando lo integremos con algo similar a esta otra tecnología de la cual les hablé previamente en eliax... página oficial del proyecto Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, junio 4, 2013

|

He aquí algo que requirió no solo de mucha imaginación, sino además de mucho talento para lograrlo... He aquí algo que requirió no solo de mucha imaginación, sino además de mucho talento para lograrlo...Se trata de un programador que creó un algoritmo que le permite "dibujar" prácticamente cualquier cosa con las piezas del popular juego Tetris. Algunos dirían que esto es imposible ya que para algunos dibujos se necesitarían piezas de Tetris de un solo cuadro (o "pixel" en este caso), cuando todas las piezas de Tetris tienen cuando menos 4 cuadros, pero lo ingenioso del algoritmo es que toma en consideración el hecho de que mientras juegas a Tetris es posible "limpiar" lineas que vas formando, dejando atrás cuadros en grupos no solo de 4, sino que de 3, 2 o incluso una sola pieza. El video abajo les hará evidente lo genial de todo esto, y verán como es posible dibujar prácticamente cualquier cosa, por más complejo que sea... página oficial del proyecto (detallando el algoritmo) Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

viernes, mayo 31, 2013

|

Lo siento mis amigos lectores, pero no he podido dejar de utilizar la frase "GRAN HITO" tres veces en la misma semana (¡y dos veces en un mismo día!), pero es que sencillamente estos avances se lo ameritan... Lo siento mis amigos lectores, pero no he podido dejar de utilizar la frase "GRAN HITO" tres veces en la misma semana (¡y dos veces en un mismo día!), pero es que sencillamente estos avances se lo ameritan...Hoy les hablo de un revolucionario nuevo tipo de sensor de imagen desarrollado en Singapur que en vez de utilizar técnicas de CCD o CMOS (las dos formas básicas de capturar fotos y video en formato digital hoy día), utiliza el milagroso material grafeno del cual le he hablado por años en eliax. Según los inventores de este nuevo tipo de sensor, este captura luz 1,000 (mil) veces más eficientemente que cualquier sensor de la actualidad. O en otras palabras, esto no solo permitirá literalmente ver de noche, y no solo hará a todos los sensores de la actualidad obsoletos, sino que además nos permitirá reproducir imágenes de la vida real con una fidelidad literalmente inimaginable hasta hoy. Como si fuera poco, este nuevo tipo de sensor consume 10 veces menos energía (lo que significa que las cámara y celulares que le den uso durarán mucho más), y de paso cuando salgan al mercado costarán al menos 5 veces menos que los modelos actuales. Si esto no es un excelente ejemplo de los tiempos exponenciales en que vivimos, no se que otro ejemplo sería mejor... Noten que esto será además de particular importancia en celulares inteligentes, los cuales sufren de una muy mala calidad de imagen cuando se trata de imágenes en ambientes con muy poca luz. Con esto, un celular podrá obtener imágenes en ambientes casi oscuros con mejor calidad que incluso los sensores más caros y sofisticados de hoy día en cámara que cuestan miles de dólares. Inicialmente la idea es lanzar este sensor en aplicaciones de seguridad, en sensores para telescopios y aplicaciones similares, y en satélites (sin duda, con aplicaciones de espionaje). Sin embargo, no duden que esto posiblemente será parte estándar de todas las cámaras antes del final de la década... Por el momento, ya que se demostró el funcionamiento de este sensor en un ambiente de laboratorio, el próximo paso es adaptarlo a ambientes de fabricación industrial para poder producirlo en grandes cantidades y bajo costo. Finalmente, noten que si combinamos este desarrollo, con este otro que crea lentes perfectos del ancho de una hoja de papel, que nos acercamos a un futuro en donde tendremos cámaras del tamaño y fino de tarjetas de crédito que capturarán mejores fotos y videos que incluso las mejores cámaras profesionales e industriales de hoy día... fuente autor: josé elías |

|

|

|

|

|

|

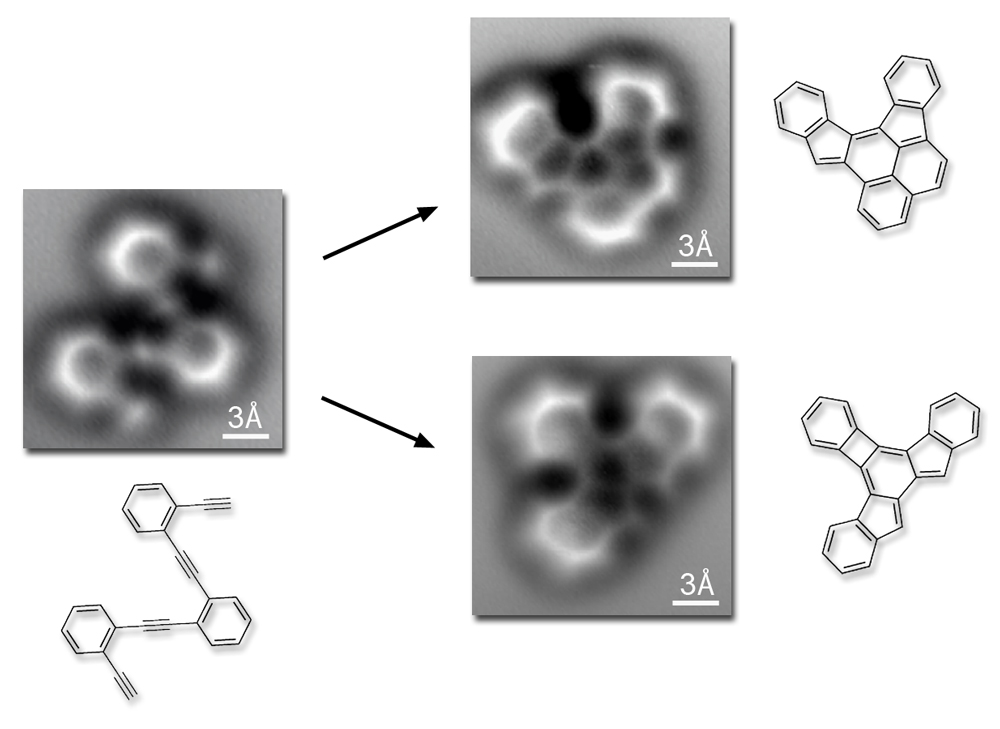

Hace menos de una semana que les reporté sobre la asombrosa noticia que por primera vez se pudo capturar el orbital de un electrón en torno al núcleo de un átomo, y hoy tenemos otro gran hito de proporciones similares: Por primera vez se ha logrado visualizar directamente una reacción química de inicio a fin. Hace menos de una semana que les reporté sobre la asombrosa noticia que por primera vez se pudo capturar el orbital de un electrón en torno al núcleo de un átomo, y hoy tenemos otro gran hito de proporciones similares: Por primera vez se ha logrado visualizar directamente una reacción química de inicio a fin.El desarrollo, logrado en el Lawrence Berkeley National Laboratory del Departamento de Energía de los EEUU (en un laboratorio en la Universidad de Berkeley), es un tremendo hito que tendrá grandes repercusiones no solo en términos educativos (docencia), sino que prácticos, pues por primera vez ya podemos observar directamente lo que hasta el momento era solo deducido matemática y lógicamente. La técnica utilizada para crear estas imágenes se llama "non-contact Atomic Force Microscopy" (nc-AFM), y funciona utilizando la aguja más fina del mundo, con un solo átomo en su punta, el cual vibra en relación (o como respuesta) a las fuerzas que "siente" debajo de este, y esas vibraciones se pueden traducir a puntos "fuertes" o "débiles" que cuando se componen todos producen las imágenes que ven en el artículo. Asombrosamente, esta nueva forma de ver los átomos es tan precisa que incluso se pueden ver no solo conexiones singulares entre un átomo y otro, sino que incluso dobles y triples. No lo duden, este es otro adelanto que nos permitirá crear desde mejores materiales hasta mejores medicinas a ritmos antes impensables en los próximos años... ¡Gracias al lector Iván R. Jiménez por compartir la noticia en el grupo oficial de eliax en Facebook! fuente autor: josé elías |

|

|

|

|

|

martes, mayo 28, 2013

|

|

Hoy les presento una tecnología llamada Euclideon, una tecnología de renderización de datos masivos que sencillamente aparenta salir casi de la ciencia ficción...

En este caso en específico, el video que les muestro es sobre una aplicación específica de la tecnología al área geo-espacial (es decir, la visualización de datos geográficos), con un sistema al cual llaman Euclideon Geoverse. Pero, ¿qué es Euclideon? Pues es una nueva manera de renderizar gráficos, que en vez de depender de lineas y polígonos geométricos, depende de puntos, pixeles o voxels. ¿Pero qué significa eso? Pues les explico a continuación... Cuando se renderiza (dibuja en pantalla) un mundo virtual (como en los videojuegos que vemos mundos bastante realistas en 3D), es necesario mantener en memoria la geometría del mundo que se está visualizando, y después calcular metódicamente con una serie de algoritmos que "se ve en pantalla" y que no, incluyendo si hay reflexiones (como en agua), sombras, etc. Eso es un proceso bastante intensivo que dependiendo del tamaño del modelo y de como se renderice (sea por un método llamado "scanlines" o "raytraced") puede hacer que cualquier máquina se arrodille ante su operador y pida perdón. En esencia, mientras más grande y detallado es un mundo 3D para renderizar, más intensivo es el proceso de llevarlo a la pantalla, lo que se traduce o a una actualización gráfica bastante lenta (el video no se ve fluido) o a que se tome muchísimo tiempo en tan solo cargar los datos. Y cuando hablamos de modelos que incluyen ciudades enteras con todo el lujo de detalle, incluso las más potentes tarjetas de video sucumben ante la carga y la única solución es o (1) perder detalle de imagen, o (2) renderizar en granjas de varias tarjetas gráficas trabajando en paralelo, o (3) renderizar fuera de tiempo real para posteriormente ver el video. Pues la tecnología Euclideon resuelve todos esos problemas de una forma bastante genial: En vez de interpretar un mundo hecho de polígonos, lo que hace es que desconstruye el mundo virtual y lo convierte al equivalente de "atomos" (similar a la vida real). O en otras palabras, en vez de una caja virtual estar compuesta por 6 lados cuadrados, Euclideon descompone la caja y la reinterpreta como una caja compuesta por miles de pequeños puntos uno al lado de otro (lo que significa que para Euclideon funcionar, necesita hacer un trabajo de conversión de una sola vez en los archivos 3D). Después de eso, el algoritmo de Euclideon lo que hace es que se pregunta "¿Para este pixel/punto en específico de la pantalla, cuál es el átomo que corresponde en el modelo virtual?", y la respuesta a esa pregunta es precisamente lo que la empresa que ideo este método ha inventado, y es un algoritmo de búsqueda extremadamente rápida dentro de su sistema de archivo propietario. Euclideon es tan eficiente y rápido, que incluso funciona directamente sin tener que cargar el modelo a la memoria de la máquina, sino que es solo necesario acceder al archivo en el disco duro o red (incluyendo el Internet) para obtener los "átomos" del modelo y desplegarlos en tiempo real en pantalla mientras uno manipula el modelo interactivamente, lo que es algo verdaderamente asombroso. Noten sin embargo que aunque la empresa no lo menciona, después de yo entender como funciona esto, tengo el presentimiento de que esto solo funciona para modelos de iluminación "fija", ya que todos los átomos del modelo son precalculados, lo que significa que con esta tecnología (al menos que yo esté equivocado) no se pueden hacer efectos visuales en tiempo real como los que vemos en video-juegos en donde es posible ver el agua moviéndose y la reflexión de objetos en esa agua. Esto es más una herramienta para explorar mundos expansivos estáticos en tiempo real. Aun así, lo que lograron es verdaderamente alucinante y tiene grandes implicaciones prácticas para la visualización de grandes cantidades de datos. página oficial de Euclideon Geoverse Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

"Estos tiempos son los mejores de la humanidad, ojalá y tengamos la oportunidad de saber sobre vida en otro planeta y aun mejor que esta sea inteligente y podamos comprender más sobre lo que realmente es la vida."

en camino a la singularidad...

©2005-2026 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax