Hardware

|

viernes, agosto 2, 2013

|

Hoy día, la gran mayoría de todos los circuitos electrónicos que utilizamos en nuestras vidas (desde celulares hasta hornos de microonda) dependen de un componente básico llamado el transistor. Hoy día, la gran mayoría de todos los circuitos electrónicos que utilizamos en nuestras vidas (desde celulares hasta hornos de microonda) dependen de un componente básico llamado el transistor.Es con transistores que se crean todos los elementos lógicos que dotan de inteligencia a nuestras máquinas, y ahora un equipo de investigadores del Departamento de Energía (DOE, por sus siglas en inglés) de los EEUU acaba de descubrir un material que permite hacer transistores "miles de veces" más rápidos que los transistores en uso en la actualidad... Sucede que los transistores actuales están fabricados de silicio, pero lo que estos investigadores descubrieron es que si los fabricaban con magnetita pueden crear transistores que cambian de estado muchísimo más rápidamente. ¿Y de qué tan rápido estamos hablando? Pues según las mediciones, estos transistores de magnetita pueden cambiar de estado en apenas 1 billonésima (una parte en un millón de millones) de un segundo. ¿Y qué significa esto? Pues que cuando esto sea factible para fabricación en masa, que tendremos equipos del tamaño de un celular con más potencia que algunas de las supercomputadoras más potentes del mundo que ocupan gabinetes enteros hoy día... fuente autor: josé elías |

|

|

|

|

|

lunes, julio 29, 2013

|

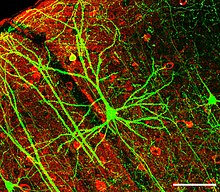

Científicos de la Universidad de Zurich acaban de demostrar el funcionamiento de un "Chip Neuromórfico" que podría apuntar hacia una posible manera de acelerar el advenimiento de las primeras máquinas con verdadera Inteligencia Artificial similar a los seres humanos. Científicos de la Universidad de Zurich acaban de demostrar el funcionamiento de un "Chip Neuromórfico" que podría apuntar hacia una posible manera de acelerar el advenimiento de las primeras máquinas con verdadera Inteligencia Artificial similar a los seres humanos.Lo que estos científicos lograron fue implementar en un chip un conjunto de sinapsis y neuronas artificiales pero en un tamaño, velocidad de procesamiento y consumo energético similar a la de un cerebro biológico real. Notemos que hoy día por lo general los sistemas llamados "Redes Neuronales" que imitan parte del cerebro humano, lo hacen de una forma ineficiente en comparación al cerebro humano, en una o más áreas. O son muy lentos (no funcionan en tiempo real), o muy grandes (ocupan literalmente grandes máquinas, gabinetes o hasta salones enteros), o consumen grandes cantidades de energía, pero lo que estos científicos han logrado es un prototipo de algo que es sumamente pequeño, que consume muy poca energía, y que funciona en tiempo real. Según los científicos, ya han puesto el sistema a prueba con tareas sencillas que requieren incluso el concepto de una memoria a corto plazo para finalizar la tarea, con resultados positivos, formándose incluso automáticamente en el sistema conexiones bastante similares a las de los cerebros de grandes mamíferos como los seres humanos. Entre las posibles aplicaciones citadas que podrían salir de esta investigación al corto y/o mediano plazo se incluyen sistemas sensoriales que imiten al sistema de procesamiento de sonido e imágenes del cerebro, para incluir esa funcionalidad dentro de dispositivos electrónicos y permitirles tomar decisiones (como por ejemplo, en asistentes virtuales digitales en celulares inteligentes, o en robots, o en autos que se manejen solos, o quizás en gafas y brazaletes inteligentes del futuro no lejano). Pero obviamente, lo importante de esto es que hemos dado un paso más hacia la construcción de cerebros biónicos que algún día podrían dar a luz a verdaderas inteligencias artificiales, o cerebros sintéticos que sirvan para alojar una copia de nuestros cerebros biológicos, con miras a vivir literalmente para siempre... Como podrán apreciar, ya no estamos tan lejos de este escenario que les comenté hace algunos años acá mismo en eliax. fuente oficial documento científico oficial autor: josé elías |

|

|

|

|

|

jueves, julio 25, 2013

|

Google anunció esta semana un micro dispositivo del tamaño de una memoria USB que se conecta a tu televisor, y lo ha llamado el Chromecast, y a diferencia de muchos otros dispositivos similares, este me ha llamado mucho la atención... Google anunció esta semana un micro dispositivo del tamaño de una memoria USB que se conecta a tu televisor, y lo ha llamado el Chromecast, y a diferencia de muchos otros dispositivos similares, este me ha llamado mucho la atención...Pero, ¿qué es exactamente el Chromecast? Pues es un pequeño dispositivo que por un lado de conecta a tu TV por medio de un conector HDMI estándar, y por el otro se conecta a tu red WiFi, y es controlado directamente desde el navegador Google Chrome y otras aplicaciones compatibles. En esencia, el Chromecast funciona como un receptor de audio y video desde tus dispositivos móviles (sea iPhone, iPad, o Android), o PC (directo desde el navegador Google Chrome). La idea es que si por ejemplo estás viendo un video en YouTube, o escuchando una canción desde Google Music, o quizás viendo una película desde Netflix, que puedas "enviar" el video, la canción o la película directamente a tu TV de una forma fácil y simple, bastante similar a la tecnología AirPlay de Apple. Sin embargo, por lo que tengo entendido (pues por el momento hay poca documentación al respecto), ChromeCast funciona de manera diferente a AirPlay... En AirPlay, la idea es que un dispositivo local envíe audio y video directamente a la TV (u otro dispositivo), pero en ChromeCast el dispositivo que quiere enviar el video a la TV en realidad no envía el video directamente al Chromecast conectado a tu TV, sino que simplemente le indica desde donde obtener el video en Internet, y posterior a eso el video va directo desde el Internet al Chromecast, mientras que el dispositivo móvil y/o Chrome funcionan simplemente como un control remoto del video (o audio). Esto a propósito, para el que no lo haya notado, es en esencia el mismo mecanismo que Google ha estado probando desde hace ya bastante tiempo que permite controlar a YouTube en una TV desde un dispositivo externo, solo que ahora con este aparatito cualquier TV recibe desde cualquier dispositivo móvil o PC, lo que está genial. Noten que una limitación (que debo investigar si estoy correcto con esto, de lo contrario actualizo el artículo acá mismo en eliax), es que aparenta que esta tecnología de Google no te permitirá enviar cualquier video que tengas almacenado localmente en tu dispositivo móvil o PC a tu TV, pero por el precio no podemos quejarnos... Y el precio... A un precio de solo US$35 dólares esto cae directamente en territorio de "compra impulsiva" (yo ya ordené el mío por Amazon), y dado que lleva el nombre de "Google" y "Chrome" atado al producto, algo me dice que estos aparatitos no solo se venderán como pan caliente, sino que incluso podrían afectar el mercado de streaming de audio y video por Internet, el cual por el momento es dominado por dispositivos como el PlayStation 3, el AppleTV, y Roku. Noten además que Google ya acaba de hacer disponible un SDK (kit de desarrollo para desarrolladores) para que agreguen la tecnología de Chromecast a sus aplicaciones (y según Google, es bastante sencillo hacerlo). Finalmente, como bono adicional, Google incluye 3 meses gratis de Netflix con cada Chromecast vendido, lo que no está nada mal... anuncio oficial de Google sobre Google Cast SDK oficial de Chromecast (beta) página oficial de Chromecast en Google Play Chromecast en la tienda Amazon Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

|

sábado, julio 20, 2013

|

¿Tienes un poco de tiempo libre, pasión por un proyecto super interesante, y a la misma vez quieres aprender sobre algo que te podría ser bastante útil en el campo laboral en el futuro? ¿Qué tal si aprendes a construir un teléfono celular real y funcionar casi desde cero, empezando desde sus componentes básicos? ¿Tienes un poco de tiempo libre, pasión por un proyecto super interesante, y a la misma vez quieres aprender sobre algo que te podría ser bastante útil en el campo laboral en el futuro? ¿Qué tal si aprendes a construir un teléfono celular real y funcionar casi desde cero, empezando desde sus componentes básicos?Pues si respondiste positivamente a esas preguntas, he aquí un proyecto con el cual puedes construir tu propio celular GSM (es decir, de los que utilizan chips SIM en redes EDGE/2G/3G) desde cero con la tecnología Arduino. ¡Gracias al lector Andrés Felipe Bedoya Bayer por compartir el enlace en el grupo oficial de eliax en Facebook! enlace a la guía autor: josé elías |

|

|

|

|

|

lunes, julio 15, 2013

|

En un mundo que rápidamente adopta celulares inteligentes y tabletas, es difícil encontrar alguna noticia notoria sobre PCs, pero esta creo vale la pena hacerla notar, por varias razones que les detallo más adelante... En un mundo que rápidamente adopta celulares inteligentes y tabletas, es difícil encontrar alguna noticia notoria sobre PCs, pero esta creo vale la pena hacerla notar, por varias razones que les detallo más adelante...Se trata de una nueva PC llamada a Utilite de CompuLab, que viene con el sistema operativo Ubuntu Linux y está basada en un chip de 1, 2 o 4 núcleos tipo ARM, iniciando a un precio de tan solo US$99 dólares. Las especificaciones técnicas de esta PC son estas: ✓ Procesador Freescale i.MX6 de 1, 2 o 4 núcleos Cortex-A9 MPCore, a velocidad de hasta 1.2GHz ✓ Sistema operativo Ubuntu o Android ✓ Hasta 4GB de memoria DDR3-1066 ✓ Almacenamiento mSATA SSD, hasta 512GB ✓ Soporta tarjetas Micro-SD SDXC, de hasta 128GB ✓ Suporta gráficos con OpenGL ES 1.1 y 2.0, OpenVG 1.1 y OpenCL EP ✓ Suporta decodificación de video multi-stream 1080p H.264, VC1, RV10, DivX HW ✓ Salida HDMI 1.4 y DVI-D con resoluciones de hasta 1920 x 1200 @ 60Hz ✓ 2 conectores de red de Gigabit Ethernet ✓ WiFi tipo 802.11b/g/n ✓ Bluetooth 3.0 ✓ S/PDIF 5.1 (eléctrico con conector de 3.5mm) ✓ Entra y salida de sonido estereo ✓ 4 puertos USB 2.0 ✓ Capacidad de USB OTG ("On-The-Go") con conector micro-USB ✓ 2 puertos seriales RS232 (conector ultra mini serial) ✓ Dimensiones de 135mm x 100mm x 21mm (5.3″ x 3.9″ x 0.8″) ✓ Voltaje no regulado de entrada de 10 a 16 volteos ✓ Consume entre 3W y 8W (dependiendo de configuración y carga) Así que como pueden ver, es un equipo bastante completo, que como dije al inicio veo varias razones para darle uso. La primera y más obvia es como una PC de bajo costo, quizás para entornos empresariales que solo necesiten de un navegador web para hacer sus funciones, y el ocasional uso de documentos de Office (como con OpenOffice o LibreOffice), o para niños en casa, o quizás para entornos educativos en donde el costo (como usualmente lo es) sea un tema importante. El otro uso que se me ocurre es para servir de base como una Multimedia PC para los que les interesa construir sus propias soluciones. Pero el otro uso que veo es en entornos industriales/comerciales, como una PC de muy pequeño tamaño y bajo consumo energético que podemos conectar a un televisor o pantalla LCD/LED para pasar contenido de presentaciones o videos a bajo costo, o para mostrar por ejemplo el menú en un restaurante. Para este fin esta máquina podría ser ideal, debido a su potencia y bajo costo. página oficial del producto fuente autor: josé elías |

|

|

|

|

|

martes, junio 18, 2013

|

Este artículo está inspirado por un lado por una pregunta del lector Jhoan Diaz ayer en el grupo oficial de eliax en Facebook, y por otro por una gran coincidencia: Apenas horas de ese intercambio de comentarios en el grupo, supe de algo relacionado con videojuegos en iOS 7 que tiene mucho que ver con este tema... Este artículo está inspirado por un lado por una pregunta del lector Jhoan Diaz ayer en el grupo oficial de eliax en Facebook, y por otro por una gran coincidencia: Apenas horas de ese intercambio de comentarios en el grupo, supe de algo relacionado con videojuegos en iOS 7 que tiene mucho que ver con este tema...Sucede que Apple ha sigilosamente incluído en la documentación de su nuevo sistema operativo móvil iOS 7 no solo todo un nuevo grupo de librerías de programación (API) para desarrolladores de videojuegos, sino además que por primera vez (y esto es lo interesante) define específicamente cómo deben ser los controles físicos que manejarán los videojuegos en iOS de ahora en adelante. ¿Controles físicos? Si. Hablamos no solo de controlar el juego con el interfaz multi-táctil de las pantallas del iPhone o iPad, sino que literalmente controles físicos como los utilizados por Nintendo, Sony y Microsoft en sus consolas. En la documentación (que pueden leer aquí si tienen una cuenta de desarrollador de software con Apple), Apple define dos tipos distintos de controles. En el primer tipo, el control es parte del dispositivo, o más bien dicho, el dispositivo (sea un iPhone, iPad o iPod Touch) se incrusta dentro del control, en esencia convirtiendo a estos dispositivos en competidores directos a consolas como el Nintendo 3DS o el Sony Vita. Bajo este modelo, Apple especifica que deben haber botones estilo "cruz" en el lado izquierdo, y en el derecho 4 botones en configuración "A B X Y", así como dos botones encima al estilo "L1 y R1", más un botón especial para el menú principal (o inicio o pausa en el juego). En el segundo tipo, al que Apple llama el "control extendido", el control es independiente del dispositivo (por lo que asumamos que se conecta vía Bluetooth), y se parece a cualquier control moderno, pero con dos botones adicionales encima (es decir, ahora con "L1 L2 R1 R2", y con dos palancas analógicas para los pulgares en cada lado, así como 4 LEDs que indican cuál de 4 posibles jugadores eres tu con ese control. Noten que el primer control también puede tener "L1 L2 R1 R2" y palancas analógicas, pero por el momento no está 100% definido la configuración inicial de los controles. Así mismo, Apple también especifica que todo juego debe poderse jugar con o sin esos controles, de modo que cualquiera que no tenga acceso a esos controles aun pueda jugar los juegos, aunque no sea en su forma óptima. Lo interesante de ese segundo tipo de control es que si lo pensamos bien no solo es ideal para algo como el iPad, sino además para el Apple TV, el cual les recuerdo, funciona con una versión ligeramente modificado de iOS, y no es descabellado para nada pensar que por fin veremos una tienda de aplicaciones y juegos para el Apple TV (como llevo desde los inicios del AppleTV pronosticando que veríamos), en donde una de las estrellas de este nuevo modelo sería la capacidad de jugar juegos optimizados para el Apple TV con estos controles (o imaginen juegos que combinan los controles con el Apple TV, más iPhones y/o iPads también con sus controles)... Ojo, que dudo que Apple mercadearía el Apple TV como una consola de videojuegos, sino que mencionaría los videojuegos como una extensión natural a las funcionalidades nativas del Apple TV, cosa que creo popularizaría el Apple TV aun más de los 13 millones de unidades que Apple dice haber vendido hasta el momento (la mitad tan solo el año pasado, según Apple). Noten que esta es una de esas ventajas que tiene Apple al controlar todo su ecosistema, en donde puede imponer un estándar de controles de videojuegos, y de la noche a la mañana todo el mundo tiene acceso a estos controles, tanto de parte de Apple como de terceros como Logitech y otros que sin duda no tardarán un segundo en tener controles listo el mismo día que Apple anuncie tal cosa. Es bueno mencionar que a la fecha, tanto en iOS como en Android ya se han creado literalmente decenas de controles de videojeugos, pero todos o son puros "hacks" que requieren de que liberes ilegalmente tu dispositivo, o son controles que solo funcionan con determinados juegos de determinadas empresas, y por tanto pocos lo compran ya que solo sirven para casos muy específicos. Otra gran ventaja que tiene Apple es que a diferencia de plataformas como Roku, esta ya tiene un tremendo catálogo de juegos que sin duda serán adaptados de la noche a la mañana para tomar ventaja de estos controles y del Apple TV (pero les recuerdo, todo esto es especulación, Apple no ha anunciado nada al respecto). Y si se preguntan si esto tendrá éxito, les recuerdo que iOS (y a menor media, junto a Android) ya genera más ingresos tanto en ventas brutas y ganancias, como en unidades vendidas, por sus videojuegos de su tienda de aplicaciones, que Sony y Nintendo combinados, por lo que esta medida de Apple lo que haría sería extender aun más el control que ya posee sobre el mercado de videojuegos móviles, para extenderlo al sofá de nuestros hogares, compitiendo en un nicho (juegos casuales, familiares, y que no sean de demasiada potencia gráfica) contra consolas hogareñas de Nintendo. Sony y Microsoft. Noten además que a diferencia de consolas como la Xbox One o PlayStation 4, que fueron diseñadas para permanecer estáticas en el tiempo con respecto a sus especificaciones técnicas, que le tomará a Apple apenas entre 4 a 6 años tener iPhones, iPads y Apple TVs con potencia relativamente comparable a esas consolas (tiempo que podría acortarse enormemente si Apple adopta una tecnología de computación híbrida con iCloud similar a lo que planea hacer Microsoft con su Xbox One). Y si esto tiene éxito, quien sabe si Google se anime y nos lance algún dispositivo Nexus (similar al fallecido Nexus Q) junto a especificaciones similares de controles. Finalmente, una cosa que me hubiese gustado es que Apple incluyera especificaciones para acelerómetros y otros conceptos similares al WiiMote y Kinect en su especificación de controles, pero me imagino que eso ya será para una futura generación. Por ahora, si yo fuera Sony, Nintendo o Microsoft, ya estaría un poco preocupado con esta posible iniciativa de Apple (que les repito otra vez más, es solo especulación por el momento)... Nota 1: Este es un buen momento para re-leer este editorial que escribí hace 4 años, prediciendo los sucesos de hoy día. Nota 2: Mientras escribía esto me enteré que tanto Logitech como Moga estarán ofreciendo los primeros controles para iOS 7 (fuente de esa noticia y de las imágenes que acompañan este articulo) autor: josé elías |

|

|

|

|

|

miércoles, junio 12, 2013

|

Aunque ya hemos visto procesadores de 5GHz previamente, particularmente con técnicas de overclocking (en donde se acelera el CPU artificialmente y se enfría con algo como nitrógeno líquido), AMD por primera vez planea sacar un procesador comercialmente disponible para consumidores que funciona a 5GHz. Aunque ya hemos visto procesadores de 5GHz previamente, particularmente con técnicas de overclocking (en donde se acelera el CPU artificialmente y se enfría con algo como nitrógeno líquido), AMD por primera vez planea sacar un procesador comercialmente disponible para consumidores que funciona a 5GHz.Noten que en realidad el procesador funciona a 4.2GHz inicialmente, pero viene con un modo "turbo" que le sube la velocidad a 5GHz. Así que hablamos de un procesador que funciona a hasta 5,000MHz, y para que tengan una idea hace dos décadas una Commodore 64 que yo tenía funcionaba a exactamente 1Mhz, y lo asombroso es que este procesador no solo funciona con una frecuencia de reloj 5,000 veces más rápido que esa C64, sino además que este procesador es muchísimo más compacto haciéndolo muchísimo más rápido aun, así como tiene una arquitectura muchísimo más eficiente en términos de rendimiento, y como si fuera poco tiene 8 núcleos que funcionan en paralelo para hacerlo más rápido aun en tareas de todo tipo. En esencia, hablamos de un procesador que en términos prácticos es posible que sea cientos de miles a millones de veces más potente que la PC de mi infancia. Y esto es un excelente ejemplo del poder exponencial de la tecnología, pues esta no se mueve linealmente (de ser así, un procesador hoy día sería apenas 10 o 20 veces más rápido que el de una C64), sino que se mueve a pasos agigantados cada vez, razón por la cual podemos esperar dentro de pocos años cosas que hasta hoy aparentan de ciencia ficción en términos de poder computacional... En cuanto a este procesador en específico, quizás lo único "malo" que podemos citarle es el hecho de que para llegar a esos 5GHz consume 220 Watts de energía (desde 125W a 4.2GHz). Y si son técnicos, el modelo de CPU de AMD que implementa el reloj a 5GHz es el FX-9590. fuente autor: josé elías |

|

|

|

|

|

viernes, mayo 24, 2013

|

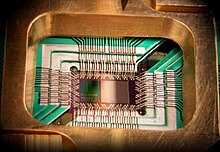

¿Recuerdan hace 4 años cuando les hablé del Buscador Cuántico de Google? ¿O hace un año de la inversión de la CIA, la NSA y Jeff Bezos (fundador y CEO de Amazon) en una empresa de computación cuántica? ¿Recuerdan hace 4 años cuando les hablé del Buscador Cuántico de Google? ¿O hace un año de la inversión de la CIA, la NSA y Jeff Bezos (fundador y CEO de Amazon) en una empresa de computación cuántica?Pues en ambos casos hablábamos de la misma empresa, D-Wave, una empresa que se ha especializado en la creación de computadoras cuánticas, y hoy tenemos palabra que la NASA y Google se han unido junto con el ARC (Ames Research Center) para investigar algoritmos de Inteligencia Artificial Cuántica, específicamente algoritmos de Machine Learning (Aprendizaje por Máquinas). La idea de esta sociedad es la de ver la practicalidad de crear algoritmos que permitan que las máquinas aprendan por sí mismas, pero con computación cuántica en vez de computación binaria como lo hemos hecho por décadas. Esto es importante ya que la computación cuántica promete computación muchísimo más rápida que la computación tradicional (hablamos en algunos casos, de millones de veces más rápido), lo que como se podrán imaginar sería cuando menos útil para Google, cuyo imperio de publicidad depende literalmente de algoritmos que aprenden sobre los hábitos de los usuarios de Internet. Esto por otro lado podría significa en un futuro una nueva generación de Inteligencias Artificiales (IA) que pensarían (al menos inicialmente en un contexto específico) a velocidades que harían que los humanos aparentemos tortugas... En este caso específico, los investigadores utilizarán una máquina que hace computaciones con 512 qbits (a diferencia de 512 bits clásicos), lo que la hace la computadora cuántica más potente del mundo. fuente oficial página oficial de D-Wave Systems autor: josé elías |

|

|

|

|

|

jueves, mayo 23, 2013

|

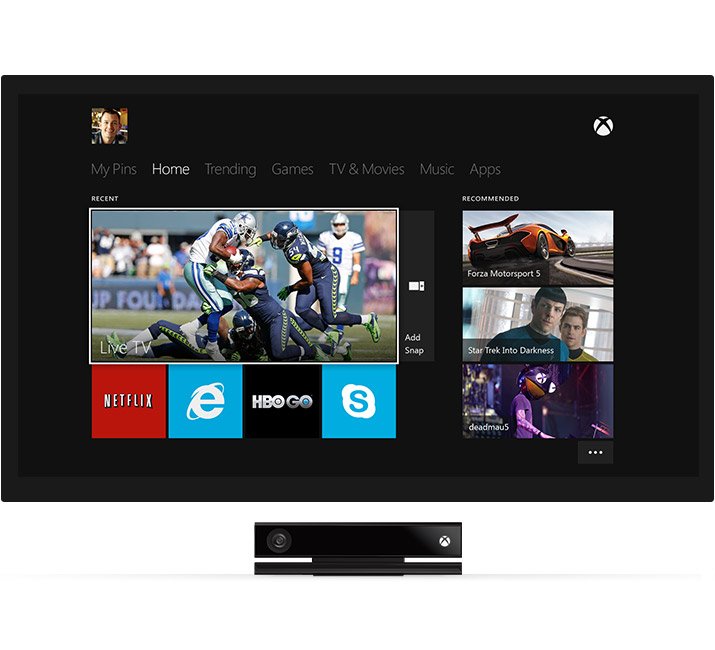

En el anuncio de anteayer del nuevo Xbox One de Microsoft (lean mis impresiones preliminares), algo extraño que fue anunciado es que el Xbox One tiene no uno, o dos, sino que tres sistemas operativos, lo que sin duda dejó a unos cuantos rascándose la cabeza tratando de entender el por qué, o cómo es eso posible. En el anuncio de anteayer del nuevo Xbox One de Microsoft (lean mis impresiones preliminares), algo extraño que fue anunciado es que el Xbox One tiene no uno, o dos, sino que tres sistemas operativos, lo que sin duda dejó a unos cuantos rascándose la cabeza tratando de entender el por qué, o cómo es eso posible.Así que hoy les explico todo el tema, y como verán no solo es todo bastante sencillo de entender, sino que incluso existe una muy buena razón con asociados beneficios... Pero antes de continuar, la pregunta es ¿por qué 3 sistemas operativos y no solo uno? Y la respuesta tiene que ver con lograr uno de los objetivos del Xbox One: El permitir hacer más de una cosa a la vez mientras juegas, lo que por ejemplo se traduce en que mientras juegas un juego una aplicación alterna pueda estar conectándote con otro jugador en videoconferencia con Skype, o si estás viendo TV el poder interactuar con un mini-juego relacionado al programa que estás viendo. Pero una vez más, ¿no es eso precisamente lo que se puede hacer hoy día con cualquier sistema operativo como Windows, Mac OS X, o incluso Android? Pues sí y no... Sucede que un problema natural de cualquier sistema operativo tradicional es que no es predecible el tiempo que cada aplicación puede tener alojada para sí. Así que por ejemplo, si tienes varias ventanas con varios documentos de Microsoft Office, y varias ventanas navegando el Internet con Google Chrome, y además tienes abierto a Photoshop más un par de otros programas, llega un momento en donde todos los programas empiezan a ponerse lentos, incluyendo los programas de fondo y el programa que activamente estés utilizando en ese momento. En una PC eso es aceptable (o cuando menos, lo que uno lamentablemente espera suceda), pero en una consola de videojuegos no sería algo bueno que si estás en medio de una batalla en Call of Duty el juego completo se caiga de rodillas y se ponga extremadamente lento simplemente porque en el fondo tienes una aplicación de Skype o el navegador web abierto con alguna página pesada. La solución tradicional a este tipo de problemas es lo que se llama un RTOS (Real-Time Operating System), que son sistemas operativos especializados (usualmente utilizados en aplicaciones industriales, incluyendo espaciales) en donde es posible predecir exactamente cuantos "ciclos" una aplicación necesitará para completar una operación específica. Sin embargo, un RTOS impone muchas restricciones que en sistemas operativos tradicionales de escritorio no son ideales, pues queremos que en ciertas circunstancias algunas aplicaciones se tornen un tanto más lentas que otras. Así que Microsoft ideó una solución, que en realidad no es nueva, y tiene que ver con un tipo de sistema operativo bastante especializado llamado técnicamente un "HyperVisor". Un HyperVisor es esencialmente un sistema operativo de muy bajo nivel que arranca antes que cualquier otro sistema operativo, y que se encarga de "virtualizar" los recursos físicos de la máquina para otros sistemas operativos. Noten que para aprender más del tema hace 4 años escribí un artículo acá mismo en eliax titulado "Pregunta a eliax: ¿Qué es un HyperVisor Tipo 1?" que recomiendo lean si son curiosos con estos temas. Y pues sucede que Microsoft ya tiene un producto llamado Microsoft Hyper-V que provee esa funcionalidad para entornos empresariales, y que ha simplificado, adaptado y optimizado para el ambiente del Xbox One. La idea del HyperVisor (que sería el primero de los tres sistemas operativos) en el Xbox One es dividir los recursos del hardware entre los otros dos sistemas operativos, y servir como mediador entre ellos. El primero de esos sistemas operativos es un sistema operativo de bajo nivel especialmente diseñado para videojuegos, y que el Hypervisor asume (aunque no lo sea realmente) es un RTOS, ofreciéndole prioridad del hardware en casi todos los sentidos, manteniendo así los videojuegos funcionando siempre a toda velocidad (al menos en teoría). Este segundo sistema operativo para videojuegos es esencialmente una actualización del sistema operativo del Xbox 360. El tercer sistema operativo es una versión de Windows basado en el kernel (núcleo) de Windows NT como utilizado en Windows 8, y este es el sistema operativo de menor prioridad (cuando se juega un videojuego) y que está encargado de arrancar aplicaciones genéricas, como Skype, Netflix, Internet Explorer, el manejo del Kinect 2, etc. En teoría será bastante fácil portar aplicaciones de Windows para que ejecuten en el Xbox One, no solo por tener un conjunto de librerías de software en común, sino además a que la arquitectura del Xbox One es basada en los chips x86 que son parte hoy día del 100% de todas las PCs con Windows en el mundo (a diferencia de la arquitectura PowerPC utilizada en el Xbox 360). Noten que cada uno de los dos sistemas operativos encima del Hypervisor creen que son el único sistema operativo ejecutando sobre el hardware del Xbox One, a grado tal que cada uno tiene su propia pantalla virtual (para los técnicos, su propio frame buffer), y es la labor del Hypervisor el de desplegar en la pantalla física el contenido de una o ambas de esas pantallas virtuales (como por ejemplo, en el modo "Snap-on" del Xbox One en donde puedes jugar un juego y hasta ver una película a la misma vez en la misma pantalla física). El Hypervisor está encargado también de asignar recursos de computación dinámicamente a cada sistema operativo, incluyendo acceso al CPU (procesador principal y sus 8 núcleos), GPU (encargado principalmente de gráficos con sus 768 hilos de ejecución en paralelo), y el cache y memoria principal (que es compartida entre los sistemas operativos para hacer el intercambio de información entre ambos lo más eficiente posible). Noten además que internamente, en términos de almacenamiento de estos sistemas operativos, que el primero (Hypervisor) ocupa una partición "privada" y totalmente invisible a los otros dos sistemas operativos, mientras que la partición de videojuegos utiliza una partición "exclusiva" (es decir, para su propio uso), y la partición de Windows utiliza una partición "compartida" (para uso propio y/o de los videojuegos). En resumen, esta es una arquitectura bastante interesante de Microsoft para garantizar la mayor velocidad posible en videojuegos, mientras también permite el uso de aplicaciones genéricas que funciona en paralelo o por sí solas, lo que en esencia ofrecerá (al menos teóricamente) una experiencia bastante fluída para los usuarios del Xbox One. autor: josé elías |

|

|

|

|

|

miércoles, mayo 1, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Intel ha estado enviando invitaciones anunciando la nueva generación de sus populares procesadores para PCs, laptops y servidores. Intel ha estado enviando invitaciones anunciando la nueva generación de sus populares procesadores para PCs, laptops y servidores.Esta nueva generación se dice que tendrá un nuevo diseño, gastará menos recursos y será mucho más eficiente. Según rumores (y datos filtrados) los precios de los nuevos procesadores oscilarían entre los US$150 y US$400 dólares, con velocidades de entre 4.0 y 4.6GHz. Recuerdo cuando mi computadora tenía 100MHz y era "lo último" en procesadores, y apenas podría correr forzadamente a windows 2000. El anuncio oficial se espera el 3 de junio, y ojalá hayan reconsiderado las cosas pensando en las configuraciones que los usuarios usan en la actualidad. Intel ya han perdido mucho terreno y deben de ponerse las pilas si no quieren quedar como han quedado muchas otras empresas. fuente Observaciones de José Elías Intel, incluso con sus resultados fiscales, lo cierto es que se encuentra posiblemente en el inicio de sus peores momentos, debido principalmente al rápido crecimiento del sector móvil, y en particular a la rápida adopción de tabletas por parte de consumidores. Como noté hace 3 años en este artículo, la arquitectura ARM se ha convertido hoy día en la mayor amenaza al negocio de Intel en procesadores, específicamente por el motivo de que sobre el 99.99% de todos los equipos móviles que se venden en el mercado (incluyendo celulares y tabletas de Apple, Google, Samsung, Microsoft, Blackerry, HTC, Sony, LG, etc) utilizan procesadores tipo ARM. Así que el mercado tradicional de la PC está empezando poco a poco a convertirse en un nicho principalmente para profesionales, aunque incluso ese renglón creo será satisfecho en gran medida por una próxima generación de dispositivos móviles que tendrán suficiente poder como para ejecutar cómodamente aplicaciones tradicionales de escritorio. O cuando menos, ocurrirá esto otro que vaticiné hace un par de años... autor: emmanuel bretón |

|

|

|

|

|

martes, abril 16, 2013

|

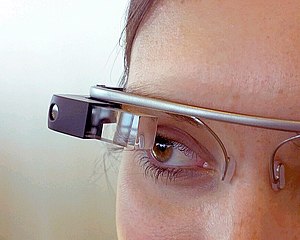

Google acaba de revelar las especificaciones técnicas de sus gafas inteligentes a las que llama Google Glass, y sin duda que serán de interés para los que seguimos a estas gafas de cerca desde su primera aparición... Google acaba de revelar las especificaciones técnicas de sus gafas inteligentes a las que llama Google Glass, y sin duda que serán de interés para los que seguimos a estas gafas de cerca desde su primera aparición...Según Google, estas son las especificaciones: - Proyector de video ocular que da la impresión de uno ver una pantalla de 25" a una distancia de 2.44 metros (8 pies). - Gafas totalmente ajustables en tamaño, que sirven a caras/cabezas de cualquier tamaño. - Cámara capaza de captar fotos de 5 Megapixeles, y video en resolución 720p (1280 x 720 pixeles). - Sonido con tecnología que transmite el sonido directamente por vibraciones de hueso de tu cráneo hasta el oído (Bone Conduction Transducer). Esto es similar a algunos audífonos hoy día en el mercado. - WiFi - 802.11b/g y Bluetooth. - 16GB de almacenamiento, de los cuales 12GB están disponibles al usuario y son sincronizados a la nube de Google. - La batería supuestamente dura "un día entero con uso típico", pero especifican que el grabar videos y hacer video-conferencias reduce el tiempo típico de uso. - En cuanto a funcionalidades de GPS (posicionamiento geográfico) y SMS (mini-mensajes), se necesita conectar el Glass a un celular Android versión 4.0.3 o superior. Noten que por el momento Google no planea hacer a Glass disponible al público en general, sino que solamente a desarrolladores de aplicaciones a un precio de US$1,500 dólares por unidad (obviamente, de Google sacar esto al mercado, el precio sería considerablemente menor, estimo que alrededor de US$500). En cuanto a mi opinión al Glass, es una idea que sabemos tarde o temprano despegará, pero aun estamos buscando lo que en inglés llaman un "Killer App" (una aplicación que verdaderamente demuestre la utilidad del Glass, y la cual no se podría utilizar de otra manera efectivamente sin las gafas), razón por la cual Google ha hecho disponible estas gafas a desarrolladores externos con la esperanza de que estos desarrollen tal aplicación. Sin embargo, la idea es que con estas gafas en un futuro podamos prescindir de los celulares inteligentes de hoy día, y hacer todo y más de lo que hacen estos celulares, pudiendo nosotros ver información "flotando" sobre nuestro campo visual, y elegir opciones con solo hacer gestos (o quizás, con solo pensar en hacer cosas, en un futuro no lejano). Aunque una cosa que me gustaría modificar del Glass es que tuviera doble pantallas, para así poder crear un efecto estereoscópico (3D) y ofrecer información en un formato más interesante (como por ejemplo, señalizaciones sobre personas y objetos en el mundo real con Realidad Aumentada). Y a propósito, si quieren ver hacia donde vamos con esto, no dejen de leer este artículo, este otro, y este otro acá mismo en eliax... fuente oficial de las especificaciones autor: josé elías |

|

|

|

|

|

lunes, abril 15, 2013

|

|

NOTA: Este es un artículo invitado en eliax.com

Una máquina para analizar muestras de sangre y determinar una que otra enfermedad, puede llegar a costar hasta 30 mil dólares, parte del lado “barato” de la salud en cualquier país del mundo. Una máquina para analizar muestras de sangre y determinar una que otra enfermedad, puede llegar a costar hasta 30 mil dólares, parte del lado “barato” de la salud en cualquier país del mundo.Sin embargo, este lado de la industria médica ha obtenido una gran sorpresa: un lector regular de DVD (también llamado un DVD-ROM) ha sido transformado para analizar pruebas de VIH (y otras enfermedades) y arrojar resultados rápidamente. El costo por la optimización: US$200 dólares. Y no es tan solo el aparato y el que pueda analizar las enfermedades lo que ha causado conmoción, sino la precisión de los resultados, los cuales son comparables en exactitud con las máquinas que se encuentran actualmente en el mercado. También resulta que la transformación del DVD-ROM es bien simple, y está reducida a tres pasos: Leer el resto de este artículo... autor: idrialis castillo |

|

|

|

|

|

miércoles, abril 3, 2013

|

Hoy día la arquitectura de procesadores que domina el espacio de consumidores es sin lugar a dudas la arquitectura ARM (a expensa de Intel, como noté hace tres años atrás en eliax, y colateralmente de Microsoft), una arquitectura utilizada por esencialmente todos los jugadores del espacio móvil, desde Apple hasta Google, y desde Amazon hasta Microsoft (y pasando por Samsung, HTC, LG, Blackberry, Sony, etc). Hoy día la arquitectura de procesadores que domina el espacio de consumidores es sin lugar a dudas la arquitectura ARM (a expensa de Intel, como noté hace tres años atrás en eliax, y colateralmente de Microsoft), una arquitectura utilizada por esencialmente todos los jugadores del espacio móvil, desde Apple hasta Google, y desde Amazon hasta Microsoft (y pasando por Samsung, HTC, LG, Blackberry, Sony, etc).En esencia, todo celular y tableta que utilice Android, iOS, Windows Phone o Blackberry utiliza los distintos diseños de chips de la arquitectura ARM. Y ahora tenemos noticia de que la próxima generación de ARM está lista, y esta versión será un tremendo salto por sobre todos los diseños existentes (aunque tendremos que ver qué tienen bajo la manga Samsung y Apple para sus próximas generaciones). La próxima generación ha sido acuñada como ARM Cortex-A57, y posee unas cualidades extremadamente importantes: 1. Utiliza el nuevo proceso de la empresa fabricadora de chips TSMC para producir el chip con trazos de 20nm en un proceso de 16nm (leer sobre los "nm" acá en eliax y sobre su importancia), lo que tendrá como efecto que sea más barato fabricar estos chips. 2. Con la misma batería, puede producir hasta 3 veces más el poder de procesamiento crudo que los chips ARM actuales. Esto se traducirá no solo en mejores videojuegos, sino además en interfaces mucho más fluídos. 3. Con la misma velocidad de chips ARM actuales, el Cortex-A57 puede durar hasta 5 veces más con la misma batería (y los beneficios de esto son inmediatamente obvios). Todo esto se traducirá a equipos más potentes, más veloces y más baratos para el próximo año (o incluso para finales de este año si no se encuentran problemas mayores de fabricación este año)... nota de prensa oficial fuente secundaria autor: josé elías |

|

|

|

|

|

miércoles, enero 23, 2013

|

En lo que es una muy clara señal de los tiempos, Intel (la empresa más grande del mundo fabricando microprocesadores y chips para PCs), acaba de anunciar que empezando desde hoy y terminando dentro de 3 años, dejará de fabricar motherboards para PCs. En lo que es una muy clara señal de los tiempos, Intel (la empresa más grande del mundo fabricando microprocesadores y chips para PCs), acaba de anunciar que empezando desde hoy y terminando dentro de 3 años, dejará de fabricar motherboards para PCs.Para los menos técnicos, un motherboard o "placa madre" es la pieza principal (y de mayor tamaño) en una PC o laptop, y es la pieza sobre la cual se coloca el procesador principal, la memoria, y los chips de gráficos, sonido, redes, y conectores de puertos. La salida de este mercado por parte de Intel es una clara señal de que la empresa admite que las ventas de las PCs tradicionales ya están decadencia, siendo substituídas en masa por dispositivos móviles como tabletas y celulares inteligentes. Así mismo, será un reto para Intel competir en el nuevo mundo móvil, un mundo hoy dominado por el rival ARM y otros como Samsung y Apple. fuente autor: josé elías |

|

|

|

|

|

jueves, enero 10, 2013

|

Quizás la razón principal por la cual la arquitectura ARM se impuso por sobre la x86 de Intel en dispositivos móviles fue el tema de la eficiencia energética en relación al rendimiento del procesador. Quizás la razón principal por la cual la arquitectura ARM se impuso por sobre la x86 de Intel en dispositivos móviles fue el tema de la eficiencia energética en relación al rendimiento del procesador.Para que tengan una idea, si incluyéramos un chip Intel Core i7 en un iPhone (algo ridículo hacer, pero la ilustración es para ilustrar un punto), es posible que la batería no dure ni 20 minutos funcionando, debido al tremendo consumo energético de tales procesadores. Sin embargo, se ha hecho evidente recientemente que debido a la gran competencia entre fabricantes de celulares, que el rendimiento (y no solo la batería) ha tomado una gran importancia a la hora de muchos consumidores elegir un equipo, por lo que empresas como ARM se encontraban en un gran dilema sobre cómo mejor incrementar el poder del procesador, mientras mantenían simultáneamente un relativo bajo consumo energético. Y la solución es la pregunta a la cual respondo hoy: ¿Qué es la arquitectura big.LITTLE de ARM? Como se podrán ya imaginar, es una técnica para obtener lo mejor de ambos mundos (bajo consumo energético más alto rendimiento), ¿pero cómo funciona? Pues en realidad es un mecanismo bastante sencillo: La idea (en su forma básica) es poner el doble de núcleos en un mismo chip, siendo la mitad de esos núcleos de alto poder, y la otra de bajo poder. La idea es, que cada núcleo de alto poder haga “pareja” con uno de bajo poder, entre los dos formando un “núcleo virtual”. Notemos que la idea no es que ambos núcleos funcionen a la misma vez, sino que para ejecutar programas que requieran bajos recursos (como es por ejemplo estar en la pantalla de inicio de tu celular) se utilicen los núcleos de bajo poder, pero cuando necesites un alto rendimiento (por ejemplo, para jugar un videojuego) el sistema automáticamente cambie a los núcleos de alto poder. Con esto se logra que el móvil (sea un celular o tableta) consuma lo más mínimo posible en las cosas cotidianas, pero a la misma vez responda rápido cuando sea necesario. Y notemos que esto sucede de forma dinámica, incluso en medio de un mismo programa. Así que por ejemplo, si estás navegando el internet, mientras se cargan y renderizan (dibujan) las páginas, es posible que estés utilizando los núcleos de alto poder, pero en el momento que se carga todo y estás simplemente leyendo la página web, que el sistema cambie a modo de bajo poder. Sin embargo, algo me dice que esto será abusado por los departamentos de mercadeo de algunas empresas. Samsung por ejemplo ya ha anunciado que el próximo año debutará procesadores ARM “de 8 núcleos”, pero falta ver si lo llamarán realmente lo que son: 4 núcleos en configuración de “4 x 2” (4 núcleos replicados entre dos veces, una en modalidad de alto poder, y otra en baja), ya que los 8 núcleos no podrán funcionar simultáneamente con este mecanismo de big.LITTLE. Noten que existen otras opciones para lograr lo mismo. Una de ellas es la de bajar dinámicamente el voltaje de operación del procesador de forma dinámica, de modo que en este esquema se necesitarían solo 4 núcleos, los cuales o “corren rápidos” o “corren lentos” (o incluso en velocidades variables) según la carga de trabajo requerida (en la arquitectura big.LITTLE, los núcleos funcionan todos a velocidades fijas). Esta estrategia de “velocidad variable” es la adoptada por Apple en su procesador A6 (también basado en el juego de instrucciones ARM), y es bastante posible que sea la estrategia que adopten hacia el futuro, debido a que una de las empresas que compró hace unos tres años atrás (PA Semi) era experta en esa modalidad, que aunque más complicada de implementar, resulta en procesadores de más bajo costo de fabricación (ya que ocupan menos espacio en el mismo chip). Actualización: Tal cual mencioné en el artículo, Samsung acaba de anunciar en el evento CES 2013 un procesador al que llama el "EXYNOS 5 OCTA" con "8 núcleos", cuando en realidad son 4 núcleos de bajo poder combinados con 4 de alto poder como expliqué en el artículo, y no 8 núcleos trabajando simultáneamente. El Departamento de Mercadeo trabajando... autor: josé elías |

|

|

|

|

|

martes, enero 8, 2013

|

Hoy día los celulares y las tabletas son la tendencia en computación personal, pero aun así, muchos de nosotros aun dependemos de PCs de escritorio, laptops, netbooks y ultrabooks tradicionales para nuestros quehaceres domésticos y empresariales, y una de las quejas más persistentes que notamos siempre es de lo lentos que estos se tornan con el pasar del tiempo. Hoy día los celulares y las tabletas son la tendencia en computación personal, pero aun así, muchos de nosotros aun dependemos de PCs de escritorio, laptops, netbooks y ultrabooks tradicionales para nuestros quehaceres domésticos y empresariales, y una de las quejas más persistentes que notamos siempre es de lo lentos que estos se tornan con el pasar del tiempo.Esa lentitud se debe a distintos factores, que van desde fragmentación del disco (cuando los datos de un archivo en específico son distribuídos por todos los lados del disco, haciendo que la “aguja” que lee los datos tenga que dar muchos saltos sobre la superficie hasta leer todo el archivo) hasta el hecho de que programas nuevos por lo general asumen hardware más potente. Por lo general, la solución que muchos ofrecen a este problema es “comprar una máquina nueva”, o en el mejor de los casos “cambia el CPU (Procesador) de tu máquina”. Sin embargo, en la vasta mayoría de los casos, eso no es necesario, y existe una mejor alternativa que puede hacer que tu máquina se sienta entre 2 y 10 veces más rápida… La alternativa es agregar memoria RAM y reemplazar el disco duro tradicional de tu máquina por un disco SSD (Almacenamiento en Estado Sólido). Un SSD en esencia reemplaza el disco de tu máquina por memoria super rápida similar a la utilizada en memorias USB o tarjetas SD para cámaras fotográficas. Para que tengan una idea, un SSD (dependiendo del modelo que compres) será entre 4 y 20 veces más rápido que tu disco duro, y eso es algo que verdaderamente impactará la forma en que trabajas. La otra sugerencia que les hago es aumentar la cantidad de memoria RAM en sus sistemas. Si tienen 1GB de memoria, es casi seguro que están al borde del abismo y que tu PC se pasa mucho tiempo “pensando”. hoy día la memoria RAM es una de las cosas más baratas en adquirir para una máquina, y hay pocas excusas para no ponerle 4GB de memoria que es lo recomendado para trabajar en los sistemas operativos tradicionales de hoy día (como Windows, Mac OS X o Linux). El tema de la memoria RAM es importante porque cuando esta se agota, lo que el sistema operativo hace es proceder a copiar constantemente datos entre tu memoria RAM (de los datos menos frecuentados) hasta el disco duro, y viceversa, en esencia convirtiendo tu disco duro en memoria RAM. Pero dado que un disco duro es miles de veces más lento que RAM, eso crea otro punto de congestionamiento interno. Es bueno también aclarar explícitamente que hoy día la mayoría de los CPUs de nuestras máquinas ya son bastante potentes, pero se pasan gran parte de su tiempo haciendo literalmente nada, esperando a que los datos que el usuario está manipulando se copien desde el disco duro hasta la memoria, para después manipularlos, por lo que el cuello de botella hoy día está no tanto en el CPU, sino más bien en el disco duro y la memoria. Pero, ¿por qué no vienen todas las PCs de hoy día con un SSD? Pues por cuestiones de costo… Un SSD hoy día cuesta varias veces más por la misma cantidad de almacenamiento que un disco tradicional. Sin embargo, este año por primera ves el costo de los SSDs bajó por debajo del dólar por GB (es decir, que comprar un SSD de 256GB hoy día cuesta menos de US$256 dólares). Como referencia, yo recientemente compré un SSD de 512GB por US$398 dólares, pero los precios continuarán bajando incesantemente a través del futuro previsible. Sin embargo, si el precio es un factor en sus decisiones de comprar un SSD, todavía hay esperanza, pues en realidad hay 3 niveles de uso que le pueden dar a un SSD, y en todos los casos notarán una velocidad notoria en sus sistemas (aunque recuerden, asegúrense de tener suficiente memoria RAM, al menos 2GB, y preferiblemente entre 4GB y 8GB). Noten que hoy día 4GB de RAM cuesta unos US$20 dólares, y 8GB unos US$35 dólares (en Amazon de EEUU al menos). Los tres niveles son estos: 1. Solución más barata de SSD: Acelerar solo el sistema operativo. En este caso, puedes comprar un SSD bastante pequeño de 32GB, en donde instalarás solo al sistema operativo. Esto garantizará que al menos el sistema operativo responderá rápidamente. Lo otro que harías sería tomar el disco duro viejo y utilizarlo para alojar tus aplicaciones y documentos. Como punto de referencia: Si utilizas Windows, y desde que enciendes tu PC hasta que entras a Windows transcurren 2 minutos, ahora posiblemente transcurran solo 30 segundos o menos. Un SSD de 32GB te costará unos US$50 dólares. 2. Solución intermedia de SSD: Acelerar el sistema operativo y el acceso a tus aplicaciones. En este caso, puedes comprar un SSD de 64GB a 128GB, que te dará amplio espacio para también poder instalar todo tipo de aplicaciones que tengas (e incluso te sobrará espacio para tus documentos y algunas canciones y películas). En cuanto al disco duro viejo, ahí almacenarás tus documentos. Esto hará que no solo el sistema operativo responda rápidamente, sino además el arrancar las aplicaciones. un SSD de 64GB cuesta entre US$65 y US$75 hoy día, mientras que uno de 128GB anda por alrededor de los US$100. 3. Solución óptima de SSD: Acelerar el acceso a todo. En este caso, todo dependerá de cuánto espacio necesitas en el patrón de uso que le des a tu PC. Pero por lo general un SSD de 256GB a 512GB será suficiente. Esto hará que el acceso al sistema operativo, tus aplicaciones, y todas tus películas y otros archivos sea sumamente rápido. Hablamos de que gastarías entre US$185 a US$395 dólares aproximadamente. Aparte de esa mini-guía, también les tengo otros consejos: 1. Si solo tienes 1GB de RAM, lo primero que deberías aumentar es la memoria RAM, pues es lo más barato y lo que te permitirá trabajar lo más cómodamente posible, en particular cuando tengas varias aplicaciones abiertas simultáneamente. 2. Si eres de los que abre 4 o 5 aplicaciones simultáneamente todo el tiempo (como tu navegador web, programas de Office, Photoshop, Bloque de Notas, etc), te recomiendo no menos de 4GB de RAM, y preferiblemente 8GB. 3. Si eres un usuario que utiliza programas que demandan mucho, como Photoshop, o programas de edición de video, Autocad, etc, lo mínimo recomendado es 8GB, y si puedes pagar por 16GB (unos US$85 dólares) no dejes de hacerlo. 4. Para saber qué tamaño de SSD necesitas, una manera simple de averiguarlo es averiguando cuánto espacio estás utilizando actualmente en tu disco duro. En Windows por lo general lo puedes averiguar haciendo clic derecho con tu ratón sobre el disco “C:” y eligiendo la opción “Propiedades”, mientras que en Mac puedes lanzar Disk Utility y hacer clic en “Macintosh HD”. Después que sepas cuanto espacio utilizas, elige un monto de espacio un poco más grande para tu SSD. Así que si por ejemplo utilizas 85GB de espacio, es recomendado que compres al menos un SSD de 128GB. Noten que en el peor de los casos, si compran 4GB de memoria y un SSD de 64GB, que hablamos de invertir menos de US$85 dólares, por algo que muy posiblemente al menos duplica o cuatriplique la velocidad de tu equipo, por lo que vale la pena explorar estas opciones. Finalmente, recuerden que si no son usuarios técnicos que recomiendo hagan que un experto les instale la memoria y el SSD, de tal manera que no pierdan sus datos en el proceso de transición. autor: josé elías |

|

|

|

|

en camino a la singularidad...

©2005-2026 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax