Tecnología Visual

|

miércoles, septiembre 4, 2024

|

Hola amig@s lectores, Hola amig@s lectores, Si les dijera que este artículo completo fue escrito por una Inteligencia Artificial (IA), ¿me lo crearían? Hace apenas dos años atrás quizás no, pero con la llegada de una nueva generación de IAs del tipo LLM (Large Language Model) como ChatGPT es posible que muchos de ustedes no sepan qué responderme. Y eso, es un problema. Aunque por un lado estamos adentrándonos en uno de los más emocionantes (sino, el más emocionante) momentos de la humanidad, a la misma vez esto trae consigo un nuevo tipo de problemas, problemas que aunque no son totalmente nuevos (me refiero a la capacidad de hacer creer que algo ficticio es real) sí podemos decir que amplifica de forma exponencial esos problemas anteriores. Como ejemplo, el año pasado se hizo viral una imagen del Papa Francisco aparentemente modelando un abrigo de nieve en una pasarela, y poco después se hizo viral otra imagen de Elon Musk aparentemente enamorado de una mujer cibernética, y recientemente hemos visto personas como Donald Trump utilizar tecnología deep fake e imágenes de famosos creadas enteramente por software para hacer aparentar que esas personalidades apoyan su segunda candidatura presidencial en los EEUU. Pero eso apenas es el comienzo… Nos estamos adentrando a un mundo en donde no vamos poder estar seguros de nada de lo que leemos, vemos o escuchamos, y esto tendrá graves repercusiones sociales de forma masiva, al menos que tomemos medidas al respecto (medidas que sugiero más adelante en este mismo artículo). Imaginen por ejemplo si llega un reclamo a una empresa de seguros, con no solo evidencia de audio de una llamada telefónica pidiendo auxilio, sino además fotografías desde múltiples ángulos del accidente reportado, y hasta video de una cámara de seguridad cercana a los hechos. Hasta hace par de años esta evidencia se hubiese considerado prueba contundente de que el supuesto accidente reclamado realmente sucedió, y la empresa aseguradora hubiese sido obligada a pagar potencialmente millones en daños. Pero, hoy día, ¿cómo podemos estar seguros de que esa llamada telefónica, esas fotos y ese video no fueron generados por las más recientes versiones de programas como Midjourney o Sora de OpenAI? Similarmente, si recibes una llamada de emergencia de un familiar cercano, y la voz es idéntica a esa persona, e incluye incluso el tipo de lenguaje que utilizaría, con las mismas expresiones que caracteriza a esa persona, ¿enviarías algo dinero de ayuda a esa persona para sacarla de un apuro? Si la pregunta anterior les intrigó, noten el caso de un ejecutivo de una empresa multinacional con sede en Corea del Sur, a quienes unos hackers estafaron US$25 Millones de dólares al convencer a alguien en la empresa para que transfiriera esa cantidad de dinero. ¿Y cómo lo lograron? Pues convocaron a una víctima en el departamento de finanzas (que teníala capacidad de hacer transferencias bancarias) a una reunión virtual con el supuesto General General de Finanzas y varios otros ejecutivos de alto nivel de la empresa para discutir un asunto urgente, y sucede que todos los “ejecutivos” de la reunión habían sido personificados con tecnología deep fake para crear avatars/clones de ellos que se veían, hablaban y comportaban como los seres humanos que reemplazaban. Es decir, en esa llamada de videoconferencia grupal, la única persona real era la víctima, y todos los demás integrantes que participaron en la videollamada eran clones digitales de sus otros compañeros de trabajo y superiores de la empresa. Estos avances en Inteligencia Artificial Generativa (IA que genera desde cero cualquier tipo de contenido que puedas imaginar) están proveyendo a una nueva generación de criminales digitales un nuevo conjunto de herramientas para engañar, estafar, atacar, sabotear, sobornar y robar a una escala hasta hace poco inimaginable. Estamos literalmente entrando a un umbral en donde se está haciendo extremadamente difícil (por no decir casi imposible) distinguir lo real de lo falso. Y el gran problema que eso trae es que la sociedad humana desde sus orígenes se mantiene estable en base a una sola cosa: La confianza. ¿Y cómo podrá funcionar una sociedad en donde no exista confianza a nivel personal, profesional, institucional o a cualquier otro nivel? Es decir, ¿cómo sabes que la tienda a la cual le estás comprando algo online es real? ¿Cómo sabes que el portal o app de tu banco no es uno falso? ¿Cómo sabes que con quien estés hablando en una videoconferencia es quien dice ser? ¿Cómo sabes que el video que viste de un ser querido supuestamente haciendo una fechoría es real? ¿Cómo sabes que los resultados de tus búsquedas en Internet son reales? ¿Cómo sabes que el video de tu hija haciendo pornografía no es real? ¿Cómo sabes que la empresa con la cual llevas semanas negociando es real? ¿Cómo sabes que las autoridades gubernamentales que te están demandando un pago de impuestos es real? ¿Cómo sabes que un documento científico que estás leyendo es real y cita fuentes reales y contiene datos reales? ¿Cómo sabes que las noticias que estás viendo es real? ¿Cómo sabes que lo que dice el próximo candidato presidencial es reall? Bajo este nuevo esquema social que estamos entrando gracias a la IA Generativa se hará casi imposible operar, creer o maniobrar, y podríamos fácilmente llegar a un estancamiento social de proporciones épicas. Sin embargo, hay soluciones que podemos implementar como sociedad. La primera es una recomendación que hago a nivel familiar y de amigos cercanos, y es la de crear una palabra o frase clave que solo ustedes conozcan, y que nunca hayan comunicado de forma digital en ningún momento, de modo que si algún día reciben una llamada de emergencia o de alguna otra índole dudosa, ustedes puedan preguntar la palabra o frase clave para verificar la identidad de la persona al otro extremo de la comunicación. Así que por ejemplo, si en una reunión familiar nos ponemos de acuerdo de que nuestra palabra de seguridad será “Segismundo”, y posteriormente recibes una llamada de un familiar aludiendo una emergencia y pidiendo una transferencia de dinero, lo primero que le preguntarías es la palabra clave secreta. Si la persona no pueda contestarla (o al menos decirte el lugar y otros datos del día en que acordaron la clave) eso significa entonces que esa persona está posiblemente siendo personificada por un hacker con tecnología deep fake. La segunda sugerencia es una sugerencia tecnológica que debemos exigir se integre a toda tecnología que capture o genere contenido en cualquier formato (sea texto, sonido, imágenes o videos), y tiene que ver en que desde su misma fuente debemos poder codificar una firma digital que podamos verificar contra alguna fuente. Así que por ejemplo, bajo este esquema toda cámara digital, todo celular, todo micrófono y toda IA que genere imágenes, texto, sonido o video debe poder incrustar información que permita comprobar que el cotenido o fue (1) generado por medios “orgánicos” (como por ejemplo, un video que capturaste en un cumpleaños) o (2) por medios sintéticos (como un video de un cumpleaños imaginario generado por una IA), así como proveer información de su fuente (como el autor, fecha de creación, etc). De esta manera, si vemos una noticia o leemos un libro o artículo, o recibimos una llamada de audio o participamos en una videoconferencia, podemos tener algún grado de certeza de que lo que percibimos es real o sintético y de su actual procedencia. Para esto es necesario desarrollar estándares tecnológicos en la industria para que la información capturada (por ejemplo) por una cámara digital esté cifrada desde el momento que es capturada por su sensor de imagen, y para que una firma digital sea parte de la imagen antes de que esta se almacene o esté disponible para distribuirse, y de paso que en cualquier momento se pueda detectar si el contenido fue alterado en lo más mínimo. Una buena noticia es que ya existe una iniciativa de parte de algunos fabricantes de cámaras y líderes de la industria para crear algo similar, e incluso ya existen algunas cámaras profesionales del mercado con tecnología similar a esto, y de paso ya existe investigación para crear sistemas que incluyan watermarks (“sellos de agua” digitales) en habla generada por IA Generativa, e incluso ya existe una propuesta de ley en el estado de California en EEUU para requerir que todo contenido sintético tenga que venir con un watermark, por lo que poco a poco veremos este tipo de tecnología esparcirse a todo sistema que genere contenido de alguna forma. Y esperemos que estas soluciones ocurran más temprano que tarde, ya que de no ser así nos arriesgamos a que la falta de confianza en nuestros sentidos nos lleven a un caos social con resultados posiblemente catastróficos para la humanidad. - p.d.: Para los curiosos sobre la pregunta que puse al inicio del artículo, no, este articulo no fue escrito por una IA. O al menos eso le digo a ustedes… Actualización: El lector Sergio Hernandez hizo una buena observación en los comentarios sobre el tema de firmas digitales, y respondí a su comentario para aclarar que cuando hablamos de una firma de agua digital hablamos de una firma criptográfica basada en el concepto de un Hash (y por extensión en cifrado de datos con llaves públicas y privadas), sin embargo esos son conceptos demasiados técnicos que extenderían demasiado este artículo, lo importante es el concepto de poder verificar la fuente de algo. Actualización 8 de abril 2025: Panasonic se une al Content Authenticity Initiative para poder autenticar que las fotos tomadas con sus cámaras que soportan el estándar no fueron modificadas posteriormente. autor: josé elías |

|

|

|

|

|

lunes, junio 5, 2023

|

Hola amig@s lectores, Hola amig@s lectores,El día que muchos estábamos esperando por fin ha llegado. Apple acaba de anunciar hoy sus rumoreadas (por años) gafas de “realidad extendida”, el “Apple Vision Pro”, y lo que vi hoy me ha dado mucho que pensar, así que abróchense los cinturones para embarcarnos en un análisis eliaxístico sobre este nuevo producto… Nota: para los curiosos que no se puedan aguantar, vayan y visiten primero ahora la página oficial del Vision Pro en el portal de Apple, y después que vean todo ahí regresen acá para mis opiniones, análisis y predicciones. Lo primero que voy a decir en cuanto a primeras impresiones es que hay que aplaudir la maquinaria mercadológica de Apple, es asombroso la forma clara que tienen de anunciar un producto e ir directamente a la psicología humana para hacerte desear vaciar tu cuenta bancaria o ponerte en plan de ahorros para comprar uno lo antes posible. Sin embargo, aun con excelentes primeras impresiones, siempre hay una dosis de realidad con la cual tarde o temprano hay que enfrentarse, y este artículo de hoy es para que aterricemos y pensemos todo en frío. Hoy les hablaré de las tecnologías que nos trae el Vision Pro, y lo que opino sobre lo que nos ofrece y sobre lo que creo le falta, y de lo que Apple puede hacer a futuro para mejorar. Pero iniciemos con los hechos: El Vision Pro realmente es algo extraordinario desde el punto de vista técnico, es el visor de Realidad Virtual y Realidad Aumentada/Extendida más avanzado del mundo, sin duda alguna, y entre sus cualidades se destacan las siguientes: 1. Tiene dos pantallas creadas especialmente para el Vision Pro que en conjunto tienen 23 millones de pixeles, lo que equivale a 11.5 millones de píxeles por ojo. Como referencia, una pantalla 4K tiene unos 8.3 millones de píxeles, por lo que estas micro-pantallas tienen mayor resolución por ojo que la TV 4K que está en tu casa o la casa de tus amigos. Notar además que si utilizas lentes medicados que Apple ofrecerá adaptadores compatibles con tu visión que se conectan de forma magnética al interior del Vision Pro. 2. Tiene 12 cámaras integradas, que se utilizan para varios fines, desde ver tus manos y el medio ambiente hasta permitirte tomar fotos y videos. 3. Contiene 5 juegos de sensores de todo tipo (distancia 3D, lector de ojos, etc), 6 micrófonos, y 2 auriculares especialmente diseñados para que escuches sonido envolvente en 3D. 4. Ofrece una super innovadora pantalla externa que proyecta tus ojos al mundo exterior. Pero no es cualquier pantalla, es una pantalla lenticular que es otra forma de decir que transmite imágenes en 3D para que dependiendo del ángulo que alguien te esté viendo, pueda ver el interior de tus gafas junto a tus ojos en 3D. O en otras palabras, esta funcionalidad da la ilusión de hacer la parte frontal del Vision Pro transparente para que alguien pueda verte directo a los ojos. Esto es bastante innovador. 5. El sistema de renderizado interno en 3D adopta una técnica que se llama en inglés “foveated rendering”, que es algo que ya algunas otras gafas de alta gama han implementado de una forma u otra, que permite que estas rendericen información de alta definición solo en la dirección que tus ojos miran, de modo que el perímetro se pueda renderizar de menor calidad y por tanto requiriendo menos poder de procesamiento, ahorrando energía, y mejorando la fluidez de los gráficos. Y noten que esto es como la combinación del ojo humano y el cerebro perciben el mundo, en donde en el centro del ojo vemos en alta definición y todo color, y en el perímetro vemos con imagen degrada (cosa que no notamos porque el cerebro es un excelente “rellenador” de información). 6. Te reconoce con solo verte en los ojos, con lo que Apple llama “Optic ID”, que similar a las películas de Hollywood lee tu retina (que es única en cada individuo del planeta) para identificarte (incluso si tienes un hermano gemelo idéntico). Esto reemplaza el Face ID y el Touch ID tradicional de otros productos de Apple en el Vision Pro. 7. La interfaz es totalmente natural, utilizando tus ojos (el Vision Pro sabe lo que ves en pantalla), tu voz (opcionalmente dependiendo de lo que estés haciendo) y tus manos (para seleccionar e interactuar con el medio ambiente sin necesidad de controles externos). Según Apple, puso mucho empeño en crear un nuevo “lenguaje de uso” similar a los lenguajes de uso que utilizó al crear la Mac, el iPod, el iPhone, y el iPad, y alega que aplicó a unas 5,000 patentes de tantas innovaciones técnicas que tiene el Vision Pro en su diseño e implementación. 8. De paso viene con dos potentes procesadores, un chip M2 de Apple (el mismo que tiene la nueva MacBook Air de 15” también anunciada hoy), y un chip especialmente dedicado para el Vision Pro llamado el R1 (que asumo significa el “Reality 1”), creado especialmente para manejar el monumental flujo de datos en tiempo real que debe procesar el Vision Pro para todo lo que hace. 9. El Vision Pro también contiene un pequeño dial (similar al del Apple Watch) el cual al girar haces que gradualmente la realidad vaya desvaneciendo y solo veas la realidad virtual generada dentro de las gafas. Pero aparte de eso, el software también hace cosas bastante impresionantes. Por ejemplo, cuando alguien se aproxima a ti, el Vision Pro detecta eso y te superimpone de forma gradual la persona para que la veas y puedas interactuar con ella, mientras que al mismo tiempo el Vision Pro despliega la imagen de tus ojos en formato casi holográfico para que la persona note que la estás viendo y puedan hablar cara a cara (o ojos a ojos) de forma natural. Y es bueno notar que para que todo esto se haga posible que el Vision Pro contiene cámaras externas de super alta calidad para que experimentes el mundo similar a como lo verían tus propios ojos, sin tú tener que desmontarte las gafas. Todo esto viene apoyado por un nuevo sistema operativo al que Apple ha bautizado como “visionOS”, especialmente diseñado para el Vision Pro y de paso compatible (con una recompilación de código) con las millones de Apps de iOS, iPadOS y macOS. Ya por ejemplo Apple anunció que Microsoft tendrá versiones de Office especialmente para el Vision Pro que en esencia te permitirán utilizar este visor como una especie de Mac (algo que predije hace unos días atrás por mis redes sociales), por lo que al inicio aunque quizás no tengamos muchas aplicaciones específicas para el Vision Pro, posiblemente si tendremos muchas aplicaciones clásicas disponibles ante nuestras manos y ojos en el mundo virtual. Es bueno notar que en la presentación pudimos ver algunos ejemplos bastante buenos de uso del Vision Pro, destacándose el uso del Vision Pro para ver juegos deportivos en vivo de forma virtual sin tu tener que estar en el campo de juego (esto se logra con cámaras especiales que se colocan en los eventos deportivos), lo que serviría también para ver conciertos, asistir a conferencias, etc. Disney también traerá muchas experiencias para el Vision Pro, en juegos, películas y otras experiencias dedicadas. Ya imagino poder ver a AVATAR en 3D en esto. Apple también anunció versiones especiales de casi todas sus Apps que estarán disponibles para el Vision Pro, el cual según Tim Cook (el CEO de Apple) esta es la evolución del iPhone, a lo que llaman “Computación Espacial” (“espacial” no como en espacio de cohetes y naves y estrellas, sino como espacio de trabajo volumétrico). Sin embargo para mi dos cosas que van a seducir a los usuarios del Vision Pro (o al menos a aquellos que puedan pagar su precio inicial) son las implementaciones de cámara y FaceTime de Apple. Con la cámara ahora podrás capturar videos en 3D del mundo a tu alrededor, los cuales ahora podrás almacenar como memorias digitales futuras o para compartir con tus familiares y amigos para que estos tengan una experiencia muy similar a la que tuviste tú el día que lo grabaste. Esto tendrá un gran impacto emocional que estoy seguro será replicado por la competencia muy rápidamente. Y con respecto a FaceTime, Apple creó una tecnología que con Inteligencia Artificial y los sensores del Vision Pro pueden generar un avatar ultra-realista y totalmente fotorealista de tí mismo, lo que significa que si haces una video-conferencia con otros usuarios de Vision Pro, todos se verán con sus caras reales en medio de reuniones. Así que imaginen por ejemplo una reunión de negocios en mesa redonda, o un grupo de familiares remotos reunidos todos frente a una fogata, en ambos casos aun tengamos el visor puesto, del otro lado nos percibirán como somos y con todo nuestro rango de expresiones, lo que creará una conexión humana muy diferente a los otros sistemas de chat virtuales existentes en donde otro “muñeco” que más o menos se parece a ti te reemplaza. Esta funcionalidad es otra que creo será también estándar en visores de la competencia eventualmente. Ahora bien, hasta aquí todo bien, yo incluso estaba esperando ya con mi tarjeta de crédito a mano listo para ponerme en la lista de ordenar uno o dos de estos aparatos, sin embargo, hay tres cosas en las que opino Apple falló esta vez y que me detuvieron (en donde la primera de ellas fue realmente la que me detuvo más que todo): Lo primero es el precio de US$3,499 dólares (no es un error tipográfico, sí, tres mil quinientos dólares esencialmente), con salida al mercado a inicios del 2024. Para mi (y algo me dice que para la vasta mayoría de personas fuera de Apple) este precio es demasiado alto, incluso bajo los estándares de Apple. A este precio salvo un nicho de personas (de clase alta, desarrolladores de software, y los más fieles entre los fieles fanáticos de Apple) van a comprar este dispositivo, y aunque estoy seguro que se venderán unos cuantos cientos de miles o bajas millones de unidades, a este precio este no es un producto con el cual una empresa puede revolucionar este mercado. Para mi, un precio que hubiese sido irresistible es US$999 dólares, e incluso hasta US$1,499 hubiera tenido ventas excelentes (y la bendición de mi cuenta familiar), y si consideras que esto podría hacer la labor de una Mac o iPad quizás hasta te puedas convencer a ti mismo de pagar US$1,999, pero US$3,499 es demasiado. Y ese precio me pone a pensar. ¿Por qué tan caro? ¿No sabían los estudios mercadológicos internos de Apple que este precio sería demasiado alto para consumidores? Asumiendo que Apple no esté alucinando, creo que Apple nos ha dejado una pista de por qué ese precio es el que es, en el mismo nombre del dispositivo. El “Pro” en “Apple Vision Pro” me dice que Apple posiblemente considera este primer dispositivo más que todo como una demostración de todo lo posible que pueden lograr, un dispositivo sin igual que aun con ese precio será comprado por un nicho inicial del mercado, en particular el de desarrolladores de software, y más adelante nos presentará (¿quizás el próximo año?) su simplificado “Apple Vision” (sin el “Pro”) a un precio muchísimo más reducido y con ciertos recortes (por ejemplo, sin mostrar tus ojos holográficamente en una pantalla externa), y quizás a mitad de precio. Sin embargo, hasta que no bajen el precio por debajo de la barrera psicológica de los US$999 (o incluso quizás los US$1,499) será difícil que Apple logre vender 20, 10 o incluso 5 millones de estos dispositivos al año. La segunda cosa que me sorprendió es que la batería externa que requiere el Vision Pro solo es suficiente para 2 horas de uso. Como mínimo Apple debió apuntar a 4 horas, incluso si fuese una batería un poco más grande y más costosa (por suerte, estoy seguro que el mercado de terceros proveerá reemplazos a precios razonables y de mayor duración). Y la tercera cosa que veo es que Apple pudo haber hecho una cosa para convencer a muchos de adquirir un Vision Pro incluso a ese precio exorbitante: Compatibilidad directa con aplicaciones de Mac. Esto último para mi hubiese sido clave. Imaginen por ejemplo que trabajan remotamente o incluso en una oficina pequeña, o están de viajes. En vez de cargar una laptop contigo, simplemente llevas un teclado, un ratón y el Vision Pro, y en un abrir y cerrar de ojos (literal) ves frente a ti un monitor virtual del tamaño que desees (literalmente, desde 32” hasta varios metros de ancho) en donde aparece tu Mac virtual y en donde puedes trabajar de una forma super productiva en cualquier lugar. Podrías por ejemplo estar en un asiento de avión y sin embargo percibir que tienes varias pantallas (una por aplicación si así lo deseas) flotando delante de ti, y sin que nadie pueda ver tus pantallas por motivo de privacidad. Eso para mi representa una oportunidad perdida de Apple de haber podido captar una gran cantidad de profesionales (yo hubiese sido uno de ellos). En este aspecto por ahora solo cuesta esperar a que los desarrolladores migren todas sus aplicaciones una a una para que se puedan utilizar adecuadamente en el Vision Pro (algo que creo sucederá tarde o temprano), por lo que en mi caso me veo con un Vision Pro en mis manos dentro de una o dos generaciones más (y mientras tanto existe también la posibilidad de utilizar aplicaciones como Google Docs en el navegador web Safari del Vision Pro). Ahora bien, ¿significa esto que el Vision Pro es un producto adelantado a su tiempo o que Apple va a fracasar con esto? No en lo absoluto. Aun si no se venden suficientes unidades, esto ya de por sí ha marcado el rumbo a seguir en la industria, y en una sola presentación de unos pocos minutos Apple ha dejado claro que ya el dispositivo contra el cual todos los demás serán juzgados es el Vision Pro, lo que al mediano plazo le cae bien a Apple ya que cuando por fin logre bajar los precios para un modelo más amigable a los bolsillos de los consumidores, estos estarán listos para comprar. Esto de paso es un gran paso para la industria de la realidad virtual y aumentada en general, ya que Apple acaba de revelar y demostrar nuevas formas de interactuar que son más humanas, naturales y amigables a los modelos actuales, cosa que sin duda aumentará la curiosidad de los consumidores y la adopción de dispositivos de todas las marcas. Meta (Facebook) debe estar ahora mismo bastante emocionada con lo presentado por Apple, pues aunque incluso su recién-revelado Meta Quest 3 no se acerca a casi nada de lo que hace el Vision Pro, este anuncio de Apple sin duda que creará más hambre a la población de ver de qué se trata todo esto que Apple les está presentando, y el Meta Quest 3 con un costo de apenas $499 ya se ve mucho más atractivo que antes (y quizás lo ponga debajo de mi arbol de navidad este año). El trabajo de Apple ahora es refinar el Vision Pro y ofrecer algo a un precio mucho más razonable antes de que sus innovaciones sean duplicadas efectivamente por la competencia a un costo mucho menor (cosa que no será tarea fácil, puesto que estoy seguro que los costos de las partes del Vision Pro de por sí ya son bien altos, incluso para Apple que por sus altos volúmenes de compra obtiene casi siempre los mejores precios del mercado de sus suplidores). En conclusión, el Apple Vision Pro es un dispositivo tecnológicamente deslumbrante cuyo gran ancla a la hora de venderse es su precio exorbitante. Apple debió sacar también una versión “no Pro” (cosa que creo hará al mediano plazo), pero mientras tanto es una gran demostración tecnológica que resuelve muchos problemas humanos en interfaces para este tipo de entornos, y que por tanto hace un tremendo aporte al futuro de la computación personal y profesional. autor: josé elías |

|

|

|

|

|

jueves, diciembre 23, 2021

|

Hola amig@s lectores, Hola amig@s lectores,Después de más de 14 años informándoles sobre el James Webb Space Telescope (JWST por sus siglas en inglés) en artículos como este del 2007, el tiempo por fin ha llegado, y si todo sale bien el próximo sábado 25 de Diciembre 2021 (entre las 7:20am y 7:55am horario de New York) por fin se lanza al espacio, y hoy quiero escribirles sobre su historia, importancia y futuro. Al final del artículo espero tengan una mejor apreciación sobre este monumental proyecto científico y sobre por qué nunca en la historia de la humanidad la comunidad científica estará tan nerviosa como el momento en que se lance este instrumento al espacio y sus posteriores meses de establecimiento en su hogar final. La historia del JWST La ideal del JWST originó en 1989, y entre ese año y el 1994 la comunidad científica empezó a idear, pre-diseñar y debatir sobre cómo podría construirse semejante instrumento. Es bueno destacar que varias de las tecnologías necesarias para su construcción todavía ni existían ni se habían inventado. Después de esa época (que compagina con el éxito y los problemas del Telescopio Espacial Hubble) se inició una etapa de planeamiento, culminando en que para el 2002 se acuñara el nombre James Webb (eh honor al Director de la NASA que estuvo a cargo de las misiones Apollo que llevaron a la humanidad a la Luna) y se otorgara el contrato de su construcción a la empresa Northrop Grumman, que para los que no la conozcan es uno de los más grandes contratistas militares de EEUU, y esencialmente es una empresa que vive de contratos del gobierno de los EEUU, por lo que pueden estar seguros que en la decisión de elegirlos a ellos existió todo tipo de maniobras políticas tras bastidores, y que de existir una empresa privada como SpaceX en ese entonces que la historia hubiese sido diferente (en términos de costos y tiempos), pero esa es una historia para otro artículo... Mientras tanto lo importante a saber es que en ese momento se le puso un presupuesto al proyecto de Mil Millones de dólares (US$1,000MM), con una fecha de lanzamiento del telescopio para el 2010. En ese entonces también ya se hablaba de que si se disparaban los costos por imprevistos que el costo pudiese aumentar a US$3,500MM. En el 2004 inició la construcción de los masivos espejos hexagonales que serían parte distintiva de su diseño. Estos espejos, chapeados en oro puro (para aumentar su sensibilidad a la luz infrarroja) se diseñaron como un conjunto de 18 piezas hexagonales por distintos motivos. El primero es que se hacía menos complejo y costoso fabricar los enormes espejos por separado, pero la razón principal es que no existe cohete en existencia capaz de subir un espejo tan grande, por lo que se hizo un diseño en donde el espejo en forma de colmena de abeja se dobla en 3 partes para que quepa en el cohete, y después se pueda abrir en el espacio a su tamaño de operación. Es bueno notar que la precisión necesaria para que esos espejos se unan en el espacio debe ser inimaginable precisa, con márgenes de error en las millonésimas de un metro, por lo que toda una nueva tecnología de alineamiento se debió de inventar para hacer eso posible. Por la misma razón, no solo el espejo principal, sino que el telescopio completo, fue diseñado de forma tal que este se doblara como una pieza de origami (literalmente), y de desdoble ya en el espacio. Esto de por sí ya representó una complejidad enorme para el diseño del JWST. Notemos que muchos de estos diseños fueron re-pensados en el 2005 cuando se notó que el grado de complejidad iba a ser mucho superior a lo pensado, y se terminó decidiendo utilizar ese año el diseño actual. Sin embargo los cambios de diseño más el entendimiento de la envergadura del trabajo adelante necesitaron de una revisión del presupuesto y la fecha de finalización, los cuales se corrigieron a US$4,500MM y una nueva fecha de lanzamiento del 2013. El trabajo progresó por unos años, de camino topándose con grandes retos tecnológicos por resolverse, culminando esa etapa en un estudio independiente ordenado por El Congreso (de legisladores) de los EEUU en el 2010, en donde se concluyó que no solo iba a ser imposible finalizar el telescopio a tiempo, sino que su precio iba a aumentar significativamente. Al final del día se estimó una nueva fecha de poner el JWST en el espacio del 2015, y esta vez con un precio de US$6,500MM. Sin embargo poco después se hizo evidente que incluso esos nuevos estimados no eran realistas, y la NASA corrigió la cifra a US$8,800MM con una nueva fecha de lanzamiento del 2018. Después de mucho esfuerzo, el JWST fue finalizado en el 2016, pero al realizarse pruebas extensas se descubrieron todo tipo de anomalías y problemas de diseño e ingeniería, culminando esto en que se retrasara nuevamente el lanzamiento al 2019. En medio de todo esto se descubrieron todo tipo de errores humanos (que según la NASA costaron 18 meses de retraso y US$600 Millones de dólares). Y en medio de todos estos retrasos, pruebas y rediseños de último minuto llegó el Coronavirus y la pandemia del COVID-19, poniéndose una fecha tentativa de lanzamiento para el 30 de Marzo del 2021. Estos nuevos retrasos aumentaron el costo en US$800M más, llevando el costo final de construcción del JWST a US$9,600MM y aportaron un nuevo retraso con la nueva fecha siendo Octubre 2021. Sin embargo, meses antes se descubrieron problemas con el cohete Ariane 5 que lanzaría el JWST, y se retrasó nuevamente el lanzamiento para el día 18 de diciembre 2021. Mientras tanto el JWST fue transportado por el canal de Panamá en secreto (debido a su valiosa carga) a su lugar de lanzamiento y pruebas finales en el complejo ELA-3 de la empresa Arianespace, cerca de Kourou, en Guayana Francesa. Sin embargo el JWST no se lanzaría el día 18, ya que días antes una correa que mantenía asegurado el telescopio en el laboratorio de pruebas se soltó inesperadamente lo que provocó una serie de vibraciones en todo el telescopio, y por tanto se tuvo que pausar para revisar que todo estuviese funcionando bien después de ese incidente. La nueva fecha fue Diciembre 22. Sin embargo el día 22 tampoco se iba a poder lanzar al descubrirse un fallo con uno de los cables del sistema de telecomunicaciones del telescopio. Y entonces se mudó la fecha al día 24. Y el día 24 se pospuso una vez más para el día 25 debido a que no se pronosticaban situaciones atmosféricas favorables para el despegue. Así que si todo sale bien, este sábado 25 de diciembre 2021 despega el JWST (si ocurre otro retraso o eventualidad actualizaré este artículo). Riesgos del JWST Y he aquí en donde entran los nervios. El JWST es un instrumento que ha sido soñado durante más de 3 décadas, y su lanzamiento se ha retraso ya por más de 2 décadas, y el tiempo, dinero, diseño, recursos humanos, carreras, investigación, tecnología, sudor y sueños que ha sido invertido en su construcción no puede subestimarse bajo ninguna posible variable de medida. Y dado su gran costo y complejidad no existe un respaldo. O todo sale bien con su despegue y puesto en funcionamiento o se perdió todo ese trabajo (y sueño); sería uno de los días más tristes de la humanidad. Y noten que a diferencia del Telescopio Espacial Hubble que orbita a apenas 547km sobre la Tierra, el JWST estará a 1.5 millones de km de distancia de nosotros, en un lugar en donde se haría imposible en la práctica ir a repararlo (como fue el caso con el Hubble que sufrió de problemas con su espejo principal así como otros problemas que científicos y astronautas pudieron solucionar). Y es bueno notar que el nivel de complejidad del JWST es muchísimo mayor que el Hubble, por lo que muchas cosas puedan salir mal hasta que este empiece a funcionar en ese punto lejano. Según la NASA, hay una lista de más de 1,000 (mil) cosas que tienen que funcionar a la perfección para que el JWST llegue a su destino y empiece a trabajar. Entre las cosas que pueden salir mal se destacan el lanzamiento mismo, la etapa de "descascaro" en donde el JWST será expuesto al espacio por primera vez, la etapa de descoplamiento de la nave Ariane 5, la etapa de impulso hacia su hogar (el llamado Punto Lagrange L2), le etapa de desplegar sus paneles solares, la etapa de despegarse de la base impulsora, la etapa de desplegar y acoplar los elementos de su espejo, la etapa de desplegar su protector solar (una inmensa tela super avanzada más fina que un cabello humano que le dará sombra ante el Sol, y que permitirá que el JWST funcione a una temperatura de unos 50 grados Kelvin que equivale a unos -223° C o -370° F, y notar que del otro lado de la tela la temperatura será de unos 383 grados Kelvin o unos 110° C o 230° F), sus antenas de comunicación (si no podemos hablar con el JWST no podremos darle instrucciones ni ver las imágenes que genere), etc etc etc. Eso sin mencionar sus sistemas de cómputos, almacenamiento, propulsión, guía astronómica, software, y las decenas de miles de piezas que componen todo eso. O en otras palabras, este despegue y subsecuente llegada a su destino final serán los primeros minutos y subsecuentes meses de mas nervios y ansiedad en toda la historia científica de la Tierra. Literalmente hay miles de cosas que pudiesen fallar, y todas deben funcionar a la perfección, y en el primer intento. No hay respaldos ni segundos intentos. Y por eso parte del costo del JWST, pues tenemos que asegurarnos que todo funcione sin margen de error. Si yo tuviese que decir cuáles son las posibilidades de que algo surja mal con el JWST en su lanzamiento y puesta en marcha, diría (preocupadamente) que no es un porcentaje bajo, rondando quizás en el 3 al 5% que es bastante alto para este tipo de misiones. Y si se preguntan, ¿por qué enviar el JWST tan lejos? Pues como siempre, hay una razón científica para ello. A donde enviaremos el JWST es lo que se llama el Lagrange Point L2, que es un lugar en el espacio en donde la fuerza gravitatoria de la Tierra y la del Sol se cancelan mutuamente, por lo que cualquier objeto en ese lugar podrá permanecer tranquilo sin necesidad (o muy poca necesidad) de utilizar combustible (aun así el JWST lleva un poco de combustible para pequeñas maniobras de calibración y ajustes), y es importante además ese lugar ya que al quedar a 1.5 millones de km de la Tierra (y la Luna) no tendrá interferencia de nuestras señales u objetos cercanos de gran tamaño, lo que es esencial para el tipo de astronomía que estará haciendo. ¿Cuándo empezaría a funcionar el JWST? Antes de que el JWST envíe su primera imagen, varias cosas deben suceder. Lo primero es que debe lanzarse y llegar a su destino final en el punto L2, sin embargo ese no es un viaje corto. Le tardará al JWST aproximadamente un mes de viaje llegar a su destino, y varias semanas para estar totalmente desplegado físicamente en su forma final. Después se iniciarán toda una serie de pruebas de todo tipo que incluyen pruebas mecánicas, de consistencia, de vibraciones, de telecomunicaciones, computación, almacenamiento, orientación, data, algoritmos, y sobre todo de sus instrumentos científicos. Esta es una etapa crucial y extensa, que contando todo desde el día de su lanzamiento tomará unos 6 meses. Y solo después de este tiempo y que se haya verificado que todo esté funcionando correctamente se le dará la instrucción del JWST de capturar su primera imagen oficial. El día que esa imagen llegue a la Tierra será un gran día para celebrar en la ciencia y para toda la humanidad. ¿Qué va a estudiar el JWST? Si todo sale bien, la misión principal inicial del JWST será nada más ni nada menos que observar directamente a nuestro universo en el pasado cuando este tenía apenas entre 100 y 250 millones de años (recordemos que el Big Bang se estima ocurrió hace unos 13800 millones de años), por lo que estaríamos observando nuestro universo cuando este era literalmente un bebé. Eso significa que veremos las primeras estrellas mientras se formaban y también veríamos las primeras galaxias y posibles agujeros negros. Esto nos dará información invaluable para confirmar varias teorías científicas y de paso sin duda contribuirá a una nueva serie de descubrimientos, algunos de los cuales cuya naturaleza aun quizás no podemos ni imaginar. En paralelo a esa misión principal, los instrumentos del JWST también nos darán invaluables nuevos datos sobre exoplanetas (planetas en otros sistemas solares), la evolución de las galaxias, información adicional sobre objetos exóticos como agujeros negros, estrellas de neutrones y cuásares, y quizás nos de pistas para resolver temas pendientes como el concepto de la Energía Oscura que aparenta ser responsable de la expansión del universo, así como la posibilidad de averiguar qué es la tal llamada Materia Oscura. Y (literalmente) miles de temas más en su lista. Como nota final noten un par de curiosidades sobre la capacidad del JWST (que compartí con ustedes en mis redes sociales recientemente): El espejo del JWST puede distinguir los detalles de una moneda colocada a 40km de distancia, así como puede ver estrellas 10 mil millones de veces más tenues que verlas a simple vista. - Para ver el lanzamiento en vivo sintonicen en NASA TV en este enlace en YouTube. - Los dejo ahora con un video oficial que les ilustra cuál será la travesía del JWST desde el momento del despegue a su inicio de funcionamiento. El video es en inglés pero la parte visual les dará una buena idea de todo lo que ocurrirá sin necesidad de palabras. Que lo disfruten. - Actualización 1: Si desean ver una versión doblada al español del video anterior, la pueden ver acá, cortesía de mi amigo Manuel Grullón (@manuelg296) quien una vez fue Presidente de Astrodom (la Sociedad Astronómica Dominicana) y es el actual Coordinador Nacional de divulgación astronómica para República Dominicana ante la UAI (Unión Astronómica Internacional) Actualización 2: ¡El lanzamiento fue todo un éxito! Ahora a seguir con las próximas etapas arriesgadas de la misión que incluye un mes de viaje hasta su destino final y todos los pasos enumerados en el artículo. Hoy fue un gran día para la humanidad. Actualización 3: ¡Hoy 8 de enero 2022 el JWST finalizó su etapa de ensamblaje final! Los próximos pasos son empezar a alinear los bloques del espejo principal para formar un solo espejo compuesto perfecto y empezar a calibrar y probar todos los instrumentos a bordo. Todo este proceso tomará unos 5 meses más, pero ya lo más peligroso de la misión ha pasado lo que es un minumental alivio. Actualización 4: Esta semana que inicia Marzo la NASA anunció que se acaba de finalizar exitosamente la alineación tanto de los espejos como de la cámara principal, y además anunció que las primeras imágenes de pruebas de calibración superan las expectativas. Todavía se estima que para Julio de este año 2022 entrará en operación oficialmente. Actualización 5: El 11 y 12 de Julio la NASA hizo públicas las primeras imágenes del JWST, y he acá una de las más preciosas de ellas.

autor: josé elías |

|

|

|

|

|

martes, diciembre 21, 2021

|

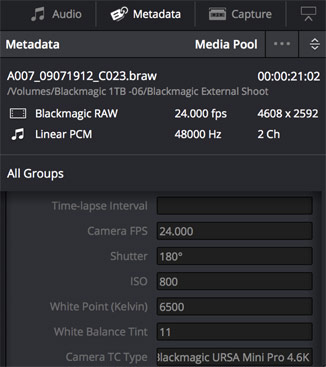

Hola amig@s lectores, Hola amig@s lectores,Antes de finalizar el año quiero hacer una breve reseña de las cosas tecnológicas más relevantes de este año 2021, desde sorpresas hasta cosas que cambiarán nuestras vidas en el futuro. Así que sin mucho más que decir, y sin ningún orden en particular, he aquí mi lista: 1. Iniciativa del Año: El Metaverso, por Meta (previamente llamada Facebook) El Metaverso no ha sido inventado por nadie en particular, pero Mark Zuckerberg se apropió del término y hasta renombró a su empresa Meta para demostrar lo serio que está con este tema. Y aunque falta ver si Meta será el principal o uno de los principales jugadores en todo esto del Metaverso (piensen de ello como el inicio a un mundo similar al de Matrix), lo cierto es que hay que darles crédito por no solo popularizar el término en la cultura popular, sino por animar al resto de a industria a tomar el concepto totalmente en serio. 2. Tendencia del año: NFT Si hay algo que junto con el Metaverso será parte fundamental de nuestro futuro tecnológico, es el concepto de los NFT (o Tókens No-Fungibles), que son el equivalente digital a tu ser propietario de cosas en el mundo fuera del ciberespacio. Lean más sobre NFTs aquí. 3. Palabra del año: NFT Y en segundo lugar "Metaverso". 4. Cripto-plataforma del año: Ethereum Aunque Bitcoin fue lo que indudablemente puso el tema de las criptomonedas en el mapa, en realidad ha sido Ethereum con su plataforma y su Ether que han estado revolucionando el espacio de las cripto-transacciones, permitiendo no solo pagar con monedas digitales sino proveyendo herramientas para crear toda una nueva generación de aplicaciones desentralizadas (como los NFTs). Y si les interesa el cripto-trading, acá un artículo al respecto. 5. Visor de Realidad Virtual del Año: Oculus Quest 2 Aunque este visor salió el año pasado, continúa al día de hoy siendo la mejor introducción al Metaverso que puedan comprar, y lo mejor de todo es que dependiendo dónde y cuándo compren su precio ronda entre los US$250 y US$300 dólares, que en mi opinión es una mejor compra que una consola tradicional de video-juegos que cuesta mucho más y no ofrece ni cerca del grado de inmersión que este equipo ofrece. Esta es una de las compras tecnológicas que más recomiendo a cualquiera. 6. Innovación Cinematográfica del Año: Empate entre (1) la cámara DJI Ronin 4D con tecnología flotante y LIDAR, y (2) la tecnología Cinema ProRes en el iPhone 13 Pro. La cámara DJI Ronin 4D es una cámara totalmente diferente a todas las que vinieron antes. No solo tiene un diseño en donde el sensor y el lente flotan delante de la cámara (para hacer imágenes super estables) sino que además incluye tecnología LIDAR para enfocar, lo que significa que la cámara crea una representación tridimensional de su entorno por medio de rayos láser para saber la distancia exacta entre el lente y el sujeto a grabar, permitiendo enfocar de manera super precisa no solo de día sino incluso en casi total oscuridad (la tecnología LIDAR es utilizada también por algunos fabricantes de automóviles robóticos para entender su entorno). Y en cuanto a la tecnología Cinema ProRes, de alguna manera Apple logró meter dentro del espacio de un celular (en este caso la versión Pro del iPhone 13) un encodificador del estándar de codificación de cine, ProRes, lo que le permite grabar video en crudo con una calidad que hasta ahora era solo posible en cámaras que costaban decenas de miles de dólares. Y de paso le agregaron un modo de desenfoque computacional a las imágenes para darle un "look" más cinemático a los videos. Si tienen un iPhone 13 Pro noten que esto deben activarlo en Configuración, y que si no saben lo que hacen no recomiendo lo utilicen ya que este tipo de videos genera archivos varias veces más grandes que videos normales. Esto está diseñado específicamente para profesionales que necesitan la más alta calidad posible (que tampoco será evidente hasta que sepan como manipular los parámetros del video generado para cambiar su exposición y otros factores). 7. Cámara Computacional del Año: Google Pixel 6 Hay dos maneras principales de crear imágenes fotográficas: De forma óptica (es decir, lo que sea que entre al sensor por el lente) y de forma computacional (es decir, se toman datos del lente y después se mejoran con computación), y un ejemplo de fotografía computación es la funcionalidad que popularizó Apple que permite desenfocar el fondo de una foto después de esta haber sido tomada. Sin embargo ha sido Google quien ha llevado esto a otro nivel con su nuevo celular Pixel 6, que en mi opinión es el mejor valor por tu dinero en el mundo Android en estos momentos. 8. Tecnología Revolucionaria del Año: Los procesadores M1 Pro/Max de Apple Cada cierta cantidad de años una tecnología surge que estremece los cimientos de su industria ocasionando grandes cambios, y la serie de procesadores M1 Pro/Max acaban de hacer eso. Estos procesadores no solo han creado un abismo en la relación precio/rendimiento entre Macs y las tradicionales PCs con Windows, sino que han creado toda una revolución que ahora están forzando a Microsoft y los demás participantes del mundo Windows a adoptar procesadores con tecnología ARM. Solo para que tengan una idea, una laptop MacBook Pro 2021 con el procesador M1 Max puede manipular en tiempo real hasta 7 fuentes de video 8K en crudo y HDR, lo que significa el manipular 56 veces más flujos de datos en tiempo real que un video 4K tradicional. Lograr eso en una PC tradicional requiere en la actualidad de comprar tarjetas de video especializadas que cuestan por sobre los US$5,000 dólares, y aun así no pueden manejar 7 flujos de 8K HDR simultáneos. Y todo eso lo hace un solo chip dentro de una MacBook Pro ahora. Y esto no es solo mercadeo. Todas las pruebas que ya se han hecho públicas por profesionales creativos han confirmado que una MacBook Pro M1 ya es entre 3 y 15 veces más rápida que una PC super potente costando varias veces más, utilizando el mismo programa en ambas máquinas (como Photoshop, Lightroom, etc). Y como si fuera poco, Apple logra todo eso con un super bajo consumo energético que permite que todo ese poder se pueda utilizar en una laptop corriendo en batería todo el día, sin conectar la corriente eléctrica a una pared, mientras que en el mundo Windows hacer lo mismo por lo general significa PCs de escritorio con power supplies halando al menos 250 vatios continuos como mínimo. Esto está provocando una ola de adopción y migración hacia Macs como nunca antes vista en la historia de Apple, y acelerando la llegada de una nueva generación de procesadores ARM para Windows en el 2022. Aprende más sobre la tecnología de chips propietarios de Apple aquí. 9. Sistema de Computación Personal del Año: Apple MacBookPro M1 Pro/Max Debido a las razones enumeradas en el punto anterior, en estos momentos no hay nada ni siquiera remotamente cercano a lo que puedes obtener en términos de rendimiento por tu dinero al comprar una MacBook Pro 2021 con procesador M1 Pro o M1 Max. 10. Innovación Cotidiana del Año: AirTags de Apple Los AirTags son objetos del tamaño de monedas grandes que dejas en tu automóvil, mochila, mascota, cartera o cualquier cosa que se te pueda perder o te puedan robar, y que te permite localizarlo rápidamente. Los AirTags es bueno notar que no tienen función de GPS con ellos, sino que dependen de que cerca de ellos existan personas con un iPhone, ya que Apple ha creado una red global en donde todos los iPhones del mundo se comunican de forma segura con los AirTags, y reportan su ubicación. Así que por ejemplo si te roban tu automóvil, y dejaste un AirTag adentro, es bastante posible que en algún momento algún desconocido que tenga un iPhone estará cerca de tu vehículo, en cuyo caso el AirTag se comunicará contigo y sabrás donde está tu auto (y claro está, que como todo en la vida, esto tiene sus usos buenos y malos como ya ha sido reportado de bandidos pegando AirTags a autos que desean robar para saber la ubicación de su propietario). 11. Sorpresa visual del año: La cámara Nikon Z9. Nikon salió literalmente de la nada con una cámara mirrorless (sin espejo) que ha no solo dejado atónitos a todos sino que dejado hasta mal parada a la competencia. Esta cámara aparte de poder disparar fotos a 20fps en RAW, 30fps en JPG, también tiene un modo especial para capturar 120 fotos por segundo en menor resolución. Esto la hace en una cámara ultra potente para deportes y acción. La cámara además tiene 45 Megapixeles con un impresionante rango dinámico lo que la hace también excelente para fotografía de bodas, retratos artísticos, y moda. Como si fuera poco graba video crudo con resolución 8K lo que de paso la hace una máquina ultra potente para el cine profesional. Una actualización gratuita próxima le permitirá grabar video12-bit 8K N-Raw y 4K ProRes RAW internamente, con 8K/60fps. Algo inaudito. Como si fuera poco, tiene un ultra-rápido sistema de enfoque automático 3D que se asegura que tus fotos salgan nítidas sin importar cuánto se mueva el sujeto que estás capturando en fotos o video. Y noten que aunque la cámara cuesta US$5,500 dólares, que eso es más barato que las cámaras de gama alta de Canon (la EOS R3) y Sony (la A1). 12. Renacimiento del año: Nikon Gracias a su cámara Z9, la empresa se acaba de levantar como el ave Fenix de sus cenizas. La empresa no ha podido fabricar suficientes para satisfacer la demanda. 13. Herramienta de Desarrollo de Software del Año: Microsoft Visual Studio Code No confundir con su otro producto llamado simplemente "Visual Studio", esta es la versión open-source que se ha tornado indispensable para toda una nueva generación de desarrolladores de software, gracias a su expandabilidad por medio de plug-ins que expanden su funcionalidad a esencialmente cualquier área imaginable de la computación. 14. Plataforma de Desarrollo Multi-Plataforma del Año: Google Flutter Si planean arrancar desde cero un App que deba compilar tanto para Android como iPhone, iPad, y ahora hasta Web, Windows, Linux y Mac, no creo exista mejor opción en el mercado que Flutter de Google. No solo genera Apps multi-plataforma sino que de muy alto rendimiento, y la más reciente versión ahora incluye librerías para video-juegos 2D de alto rendimiento. 15. Plataforma de Streaming del Año: Disney+ Disney+ no tiene ni cerca del contenido de Netflix, sin embargo se ha enfocado en algunos nichos que ha hecho que despegue más rápido que Speedy Gonzalez. Parte de su truco ha sido capitalizar sus franquicias de Marvel, creando series originales que solo se pueden ver por esa vía, como la excelente Loki. 16. Tecnología Científica del Año: El James Webb Space Telescope Si todo sale bien este telescopio se lanzará este próximo 25 de Diciembre 2021, y durará 1 mes para llegar a su destino a 1.5 millones de km de distance a un punto calmado y equilibrado grabitacionalmente, en donde desplegará una gran sombrilla espacial para bloquear la luz solar y poder observar el universo en tranquilidad como ningún otro instrumento en la historia de la humanidad. Su misión principal será la de observar los primeros 100 a 250 millones del años después del Big Bang (es decir, cuando nuestro universo era un bebé) para así entender mejor nuestros orígenes. Sin embargo la ciencia que hará será mucho más extensa que eso, tocando todos los campos de la astronomía y astrofísica a nuestro alcance, desde agujeros negros y posible materia oscura hasta la evolución de galaxias y el estudio de objetos exóticos como los cuásares. El lanzamiento de este instrumento es algo que hemos estado esperando desde el 1989 (a un costo de casi 10 mil millones de dólares) cuando se propuso por primera vez, por lo que esta será la misión con más nervios jamás lanzada al espacio por la humanidad. 17. Avance de Salud del Año: AlphaFold por DeepMind DeepMind es una inteligencia artificial de Google, y uno de los proyectos en que participó se llama AlphaFold, que ha permitido en tiempo record predecir como se doblan de forma tridimensional todo tipo de moléculas, específicamente proteínas de ADN. Esto es un paso monumental que en pocos años acelerará el descubrimiento de medicinas y tratamientos para todo tipo de enfermedades. 18. Viaje Espacial del Año: William Shatner (“Captain Kirk”) en la nave de Blue Origin Jeff Bezos (fundador de Amazon y Blue Origin) ganó muchos puntos de mercadeo este año al anunciar que enviaría al espacio a William Shatner, mejor conocido como el Capitán Kirk en la serie clásica de Star Trek ("Viaje a las Estrellas"), logrando con eso un sueño de muchos geeks de ver a este actor subir al espacio en la realidad. 19. Empresa Espacial del Año: SpaceX ¿Qué más podemos decir de esta empresa? Sencillamente no tiene igual. No solo hizo decenas de pruebas y lanzamientos (de cargo a naves espaciales exploratorias, de viajes a la Estación Espacial Internacional, y subiendo todo tipo de satélites), sino que está bien encaminada a cumplir su misión de llevar la humanidad al planeta Marte, como lo prometió su fundador Elon Musk. 20. Nave Espacial del Año: StarShip de SpaceX ¿Podrían imaginar un edificio rascacielos no solo despegando sino que volviendo a aterrizar de espalda nuevamente? Pues eso es exactamente lo que hace la nave StarShip que en el 2021 SpaceX logró demostrar que podrá cumplir su misión no solo de subir grandes cantidades de cargo al espacio, sino de llevarnos al planeta Marte. 21. Tecnología Espacial del Año: StarLink de SpaceX ¿Internet satelital de alta velocidad y baja latencia en cualquier parte del mundo y a un costo razonable? Envíenme el contrato rápidamente... Elon Musk es un genio certificado. 22. Empresa Automovilística del Año: Tesla Tesla casi por su propia cuenta ha sido la principal responsable a nivel mundial de popularizar los vehículos eléctricos, y no vemos fin a su buena racha. Cuando salga a la venta el Cybertruck será todo un fenómeno de ventas y de cultura popular. Una vez más, Elon Musk a la cabeza. 23. Personaje del Año: Elon Musk No hay sorpresas aquí. Este año ni siquiera hubo competencia remota para un segundo lugar a ponderar. Este hombre se está consagrando como el Leonardo DaVinci de nuestros tiempos, y todavía le falta mucho por vivir. autor: josé elías |

|

|

|

|

|

sábado, febrero 20, 2021

|

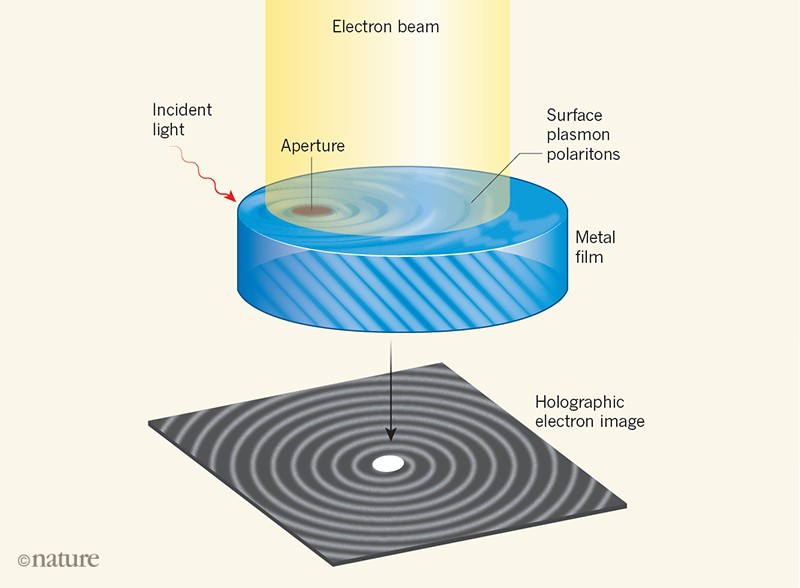

¿Alguna vez han imaginado volverse de tamaño microscópico y observar por ejemplo con sus propios ojos cómo funciona un virus, una bacteria, una molécula de ADN o incluso el interior de los átomos mismos? Pues les tengo malas noticias: Aun si fuese posible teóricamente (no lo es, ya que tus átomos no pueden cambiar de tamaño), y aun si tuviésemos la tecnología para hacerlo, te decepcionarías mucho ya que tus ojos estarían ciegos. ¿Alguna vez han imaginado volverse de tamaño microscópico y observar por ejemplo con sus propios ojos cómo funciona un virus, una bacteria, una molécula de ADN o incluso el interior de los átomos mismos? Pues les tengo malas noticias: Aun si fuese posible teóricamente (no lo es, ya que tus átomos no pueden cambiar de tamaño), y aun si tuviésemos la tecnología para hacerlo, te decepcionarías mucho ya que tus ojos estarían ciegos.Ciego, pero ¿por qué? Pues porque la retina de nuestros ojos (y muy similar a las cámaras digitales) capturan luz por los fotones que llegan en forma de onda a sus fotosensores, y estas ondas del espectro visual (que pueden imaginar como las olas que se crean cuando tiras una piedra en un lago tranquilo, pero flotando en el espacio) tienen un tamaño (o “altura”) mínimo determinado, y ese tamaño mínimo es mucho mayor que la de los átomos, por lo que para detectarlas necesariamente se necesitan foto sensores que sean mayores en tamaño a la “altura” de esas ondas (es decir, un conjunto de moléculas grandes como las que tenemos en nuestra retina ocular o en un sensor de cámara digital). ¿Qué significa eso? Que si te reduces con una máquina mágica al tamaño de una molécula, serías totalmente ciego al mundo, viendo solo ciertas sombras conforme una que otra onda “gigante” pase por tus ojos. Una analogía sería una bacteria microscópica flotando sobre el mar. Por más que le digas que trate de ver la ola sobre la cual está, esta no podrá verla jamás, ya que sus ojos solo alcanzan a ver las moléculas de agua a su alrededor de tan diminuta que es. Pero, ¿y esto más que una curiosidad tiene implicaciones en el mundo real? Pues sí, y muchas. Esta es la razón por la cual los microscopios ópticos (es decir, los que funcionan con lentes de magnificación creados de cristal y que captan luz como un ojo humano) solo pueden magnificar hasta cierto punto. Por más lentes de aumento que le pongas nunca podrán mostrarte una molécula o un átomo ya que las ondas de luz son mayores en tamaño a estos. Pero entonces, ¿y esas fotos que vemos de moléculas en revistas de ciencia, cómo las obtenemos? Pues con otro tipo de “microscopio” que no dependen de luz (y de su inmenso tamaño de onda), sino de cosas más pequeñas que las ondas de luz, como las interacciones de los electrones de los átomos. En este caso, hay microscopio (como los llamados “Scanning Tunneling Electron Microscopes”) que “disparan” electrones y los detectan con equipo especializado (similar a como se dispara luz para iluminar objetos en microscopios ópticos), en esencia reproduciendo una imagen con una “magnitud de onda” mucho más pequeña que la luz, y por tanto pudiendo acercarse a objetos aun más pequeños. Y eso nos lleva a la noticia de hoy. Recientemente científicos han estado desarrollando nuevas técnicas que utiliza otras estrategias aun más sofisticadas que permitirán resoluciones aun más sorprendentes, como lo detalla (en inglés) los dos enlaces que les comparto al final de este artículo, en donde se ha hecho un gran adelanto en este tema con una técnica que podríamos llamar “Imágenes por Holografía Cuántica”). En resumen, estamos entrando en una nueva era en donde será posible lograr una increíble resolución espacial (es decir, del tamaño pequeño de las cosas) y temporal (es decir, que podremos grabar videos de alta velocidad para después ver en cámara lenta a increíbles fenómenos ultra-microscópicos). En esencia, será posiblemente ver eventualmente en gran detalle incluso el funcionamiento de nuestro ADN, o la transformación de estados de materia según cambia su temperatura, cosas que hasta hace poco parecerían de ciencia ficción. Este adelanto tendrá repercusiones en todo tipo de áreas que van desde la creación de una nueva generación de meta-materiales, hasta nuevas formas de crear medicinas avanzadas. A continuación los dos artículos que les prometí para los que deseen más información técnica: enlace 1 y enlace 2 Finalmente noten que ya se han creado técnicas a través de los años que permiten hacer imágenes y hasta videos de estructuras atómicas, muchos de los cuales pueden ver abajo en la sección de “previamente en eliax”, pero es bueno destacar que esas imágenes y videos se han realizado con equipo extremadamente complejo y costoso, y que esta nueva técnica de Holografía Cuántica promete no solo hacer un mejor trabajo (por ejemplo, pudiéndose quizás incluso escanear todo tu cuerpo de arriba a abajo rápidamente, en vez de solo unas que otras células, lo que habría que ver si se podría utilizar como base para la teletransportación en un futuro) sino de paso a una fracción del costo (al largo plazo cualquiera de nosotros podría tener acceso a esta tecnología). - Nota: Si les gustan estos temas, no dejen de visitar y unirse al canal oficial de eliax en Telegram y si quieren debatir estos temas e interactuar conmigo pueden también unirse al grupo oficial de eliax en Telegram. ¡Los espero por allá! autor: josé elías |

|

|

|

|

|

jueves, mayo 2, 2019

|

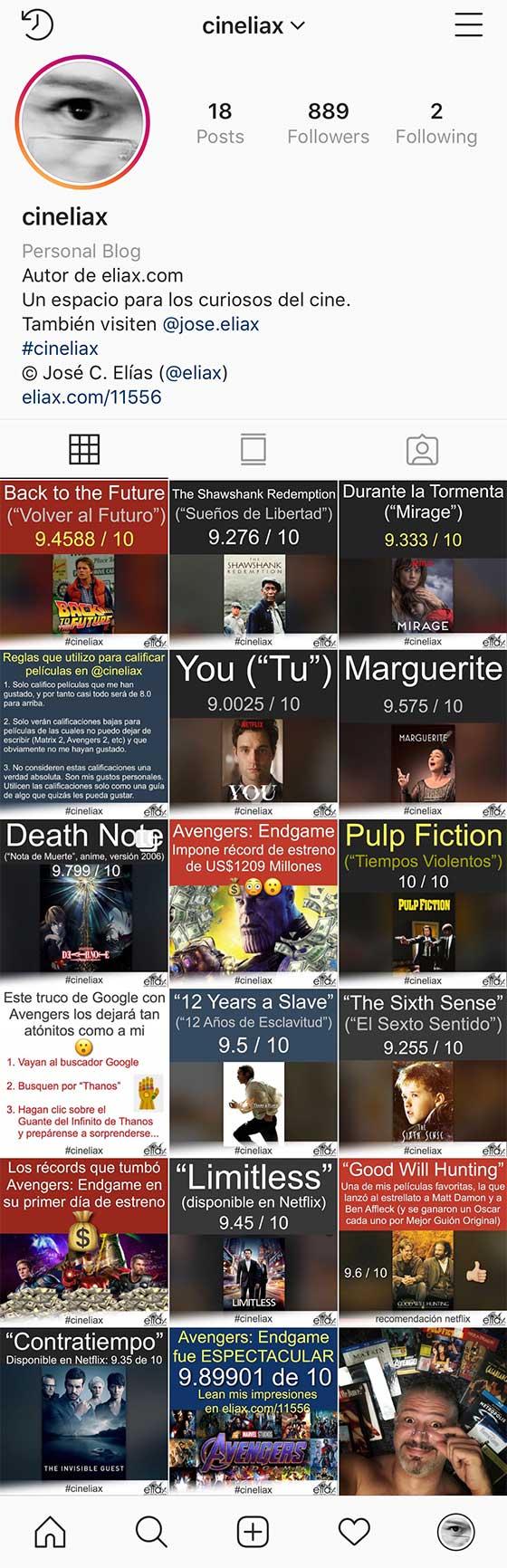

Hola amig@s lectores, Hola amig@s lectores,Si alguna vez se han hecho la pregunta "¿Qué veo esta noche en Netflix?" les tengo buenas noticias, ya que hace una semana lancé de forma sigilosa un nuevo espacio en Instagram al cual he estado alimentado estos 7 días pasados de contenido y hoy lo anuncio formalmente como #cineliax #cineliax es un espacio en donde planeo constantemente alimentar con las películas y series que más me hayan gustado en Netflix (y otras posibles fuentes como Amazon Video, Apple iTunes/TV+ o la futura Disney+), así como películas clásicas (que espero muchas se encuentren también en Netflix), y además noticias relevantes esporádicas de la industria del cine, así como curiosidades de este arte que me encuentro tan fascinante. En los últimos 7 días he tratado de llenar de contenido semilla la cuenta @cineliax con el propósito de darles una idea del tipo de experiencias que podrán esperar de este nuevo experimento que hago con mucho amor y pasión. Noten que aunque el formato de @cineliax aparenta a simple vista ser similar al de @eliax en instagram (un espacio en donde publico curiosidades "eliaxísticas" a diario), que existen diferencias importantes, particularmente en el hecho de que (1) por lo general gran parte de las publicaciones de ese espacio no las compartiré en otros espacios de #eliax (por lo que sugiero sigan la cuenta), y (2) que en cada película o serie que sugiero escribo debajo de la imagen una descripción de la película y qué la hace especial (más mis ya-conocidas y exclusivas calificaciones con varios puntos decimales - hay que tener sentido del humor). También creo prudente repetir (por vigésima quinta vez) el motivo de por qué verán por lo general muy altas calificaciones en las películas: Se debe principalmente a que no me gusta malgastar mi tiempo escribiendo sobre películas que personalmente considero malas, y en esencia lo que quiero decir con eso es que en la vasta mayoría de casos si ven una película en #cineliax es porque la considero digna de ver. La excepción a la regla anterior es cuando hay obras de las cuales sencillamente no puedo dejar de hablar pero que lamentablemente resultaron malas y no quiero que pierdan su tiempo y dinero yendo al cine (como algunas super-producciones que resultaron ser una decepción). Finalmente, recuerden lo que siempre digo: El trabajo de calificar una película es algo que tiene un componente muy personal y subjetivo, por lo que hago incapié en resaltar que estas son opiniones personales mías, y que no deben considerarse una verdad absoluta sobre estas obras. Estoy 100% seguro que algunos no van a estar de acuerdo con algunas de mis impresiones, y eso está bien, así debe ser el mundo (sino sería bastante aburrido), pero es mi deseo que al menos puedan encontrar digno de consumir y compartir una buena parte del contenido que encontrarán en #cineliax. enlace a @cineliax en Instagram (recuerden seguir la cuenta @cineliax así como el hashtag #cineliax, ¡y recomiéndela a sus familiares y amigos!) autor: josé elías |

|

|

|

|

|

domingo, diciembre 9, 2018

|