Software

|

martes, octubre 9, 2012

|

Es raro ver muchas empresas que compiten entre sí unirse por una causa común, pero hoy lo han hecho gracias a WebPlatform. Es raro ver muchas empresas que compiten entre sí unirse por una causa común, pero hoy lo han hecho gracias a WebPlatform.WebPlatform es una iniciativa lanzada por Apple, Google, Microsoft, Nokia, Adobe, W3C, Facebook, HP, Mozilla y Opera Software cuyo objetivo principal es bastante bien definido: Servir como el centro oficial por defecto de todo tipo de documentación necesaria para desarrollar aplicaciones para la Web, desde simples páginas web hasta complejas aplicaciones con HTML5. Ojo, esto no significa que estas empresas se han unido para crear una plataforma en común, sino para definir documentación en común a todos, lo que sin embargo facilitará al menos al largo plazo la tarea de aplicaciones que funcionen en múltiples dispositivos web. Es importante también destacar que el portal de WebPlatform.org es en realidad un Wiki, por lo que cualquiera puede contribuir con sus conocimientos al portal para mejorar la calidad de la información. Si desarrollan software en la web, agreguen el enlace inmediatamente a sus marcadores... ¡Gracias Fernando Montoya por el enlace en el grupo oficial de eliax en Facebook! página oficial de WebPlatform.org empresas que apoyan a WebPlatform fuente autor: josé elías |

|

|

|

|

|

miércoles, octubre 3, 2012

|

Desde tiempos inmemorables los humanos nos hemos inspirado en los inventos de la naturaleza para crear nuestras tecnologías, pero ya estamos llegando a un punto en donde estamos empezando a utilizar nuestra tecnología para influenciar la naturaleza... Desde tiempos inmemorables los humanos nos hemos inspirado en los inventos de la naturaleza para crear nuestras tecnologías, pero ya estamos llegando a un punto en donde estamos empezando a utilizar nuestra tecnología para influenciar la naturaleza...Científicos de Stanford University acaban de dar un primer pero monumental paso en adaptar el concepto de "Internet" al sistema de comunicación inter-celular dentro de nuestros cuerpos y demás organismos del planeta. Sucede que nuestras células, aun con su extremo grado de complejidad, es un sistema muy lejos de ser perfecto. Obviamente es óptimo en términos de que estamos muy bien adaptados para sobrevivir en nuestro medio ambiente, pero al analizar y entender cómo funcionan nuestras células, se hace evidente que no hubo ningún "diseño inteligente" detrás de estas, sino que más bien fue un proceso evolutivo de prueba y error con diversos cambios y experimentos aleatorios de por medio. Uno de los puntos en donde eso se hace evidente es en la primitiva forma en que se comunican nuestras células unas con otras. Estas en esencia utilizan señales químicas (es decir, una serie específica de moléculas), que se pasan entre sí para señalizar una que otra cosa. El problema es, que el mecanismo que utilizan es un proceso en donde una molécula es tanto el mensajero como el mensaje mismo. Un ejemplo análogo al mundo cotidiano sería que para nosotros enviar un mensaje que diga "camión" a alguien lejano, nosotros no enviésemos una carta o un email con la palabra "camión" adentro, sino que literalmente enviésemos un camión real. Eso, como pueden imaginar, no solo es lento, sino que consume más energía de lo necesario, y el ancho de banda (es decir, la velocidad con la cual podemos enviar mensajes) es pésimo. Pues lo que lograron por primera vez el equipo de Stanford es crear un mecanismo de mensajería inter-celular en donde ahora es posible de dividir el mensajero del mensaje. En otras palabras, ahora en vez de enviar un camión, podemos enviar un email con la palabra camión adentro. El truco para lograr esto consistió en utilizar un virus conocido e inofensivo llamado el M13, como el "sobre" dentro del cual se puede insertar un mensaje. En esencia, ahora es posible utilizar ese virus com un contenedor de mensajes no solo genéricos, sino que extremadamente largos, lo que incrementa el ancho de banda de comunicación entre células a niveles antes inimaginables. Hablamos por ejemplo de pasar de un Internet en la vida de 56Kbps (los famosos "modems" de los 1980s) a un Internet de varios Gigabits por segundo. ¿Y para qué sirve esto? Pues se cree que debido a este avance todo lo que concierne a ingeniería genética crecerá exponencialmente, pues ahora en vez de depender de relativamente lentos procesos naturales para esparcir cambios en células, ahora podremos hacer cambios a gran escala y rápidamente. En otras palabras, estudios e investigaciones que antes quizás tomaban meses, ahora podrán tomar horas, y medicinas y tratamientos que antes tomaban meses o semanas, ahora podrán asimilarse en horas o quizás días. Y como dicen sus inventores, es bueno notar que esto es apenas un primer paso, similar a como cuando se empezó a experimentar con el Internet, y apenas podemos empezar a imaginarnos los avances que esto nos traerá en el futuro... Como dato curioso final, a este proceso lo han acuñado Bi-Fi (similar a Wi-Fi o Hi-Fi, en las áreas de redes inalámbricas y sonido de alta fidelidad respectivamente, pero ahora aludiendo a Biología). documento científico oficial fuente original fuente secundaria autor: josé elías |

|

|

|

|

|

martes, octubre 2, 2012

|

Sin duda alguna, después de la noticia de la salida del iPhone 5 al mercado, la noticia más grande del momento es el desastre de relaciones públicas (para Apple) en lo que ha sido la nueva aplicación de mapas de la empresa en la más reciente versión de su sistema operativo iOS 6. Tan grande ha sido la reacción pública que hasta el mismo gerente de Apple, Tim Cook, escribió una carta a los medios disculpándose al respecto. Sin duda alguna, después de la noticia de la salida del iPhone 5 al mercado, la noticia más grande del momento es el desastre de relaciones públicas (para Apple) en lo que ha sido la nueva aplicación de mapas de la empresa en la más reciente versión de su sistema operativo iOS 6. Tan grande ha sido la reacción pública que hasta el mismo gerente de Apple, Tim Cook, escribió una carta a los medios disculpándose al respecto.Y como incluso yo mismo expresé acá en eliax en mis impresiones de iOS 6 en un iPhone 4S y un iPad de 3ra generación, esta aplicación desde el punto de vista de un usuario final, ha sido un paso hacia atrás para la empresa (aunque ojo, el interfaz me gustó muchísimo más que el de Google Maps, y si tuviese los mismos datos geográficos que este, hoy día la discusión hubiese sido a favor de Apple y en contra de Google). Sin embargo, creo que Apple no tenía opción, y cualquiera de nosotros probablemente hubiese tomado la misma decisión que Apple, y hoy les explico por que... La razón por la cual tenemos la versión actual de Apple Maps en iOS 6 se reduce a una sola palabra: Google. Sucede que desde el primer iPhone, Apple ha tenido un acuerdo con Google para que hasta el 2013 fuera el proveedor oficial de mapas para iOS. Pero el problema es, como muchos ya se imaginan, que Google se ha convertido en un dolor de cabeza para Apple dado el éxito de Android, por lo que en esencia Apple tiene a su principal contrincante dentro de sus premisas... Y eso quizás no fuese tanto un problema si fuera otro tipo de aplicación menos importante, pero no cabe duda que en el día a día la aplicación de mapas es una de las más utilizadas, y ambas empresas saben eso. El gran problema es que Google ha tomado ventaja de ello, y como es de esperarse ha estado ofreciendo mejores versiones de Google Maps para Android, en esencia haciendo de la aplicación de Maps en iOS una versión cada vez más inferior a la de su contrincante, llegando a un nivel tal que para casi todos los propósitos de prácticalidad, Google esencialmente había estancado la aplicación para iOS. Y eso, como se pueden imaginar, es un grave problema para Apple, quien vive de ofrecer una experiencia "premium" a los consumidores, lo que le permite cobrarles precios acordes. Por lo que al final del día Apple tenía dos opciones: 1. Seguir con la apliación actual de Google en sus dispositivos. 2. Convencer a Google de que mejorara la aplicación, cosa que Google no iba a hacer a cambio de algo, y ese algo sin duda que sería el tener más autonomía en relación a los datos que se capturan con Google Maps en iOS, cosa que por razones obviamente estratégicas Apple no estaría dispuesto a hacer. Así qué lamentablemente para consumidores, la opción fue una tercera: Acelerar Apple Maps y sacar a Google cuanto antes del escenario, y sufrir el tema de relaciones públicas. En otras palabras, "mejor ahora que después". Pueden estar seguros que este fue un riesgo calculado. Este es uno de esos casos en donde Apple no tenía alternativa. Hizo todo lo posible por impactar negativamente lo menos posible (utilizando datos de Tom Tom para complementar los suyos, ofreciendo un interfaz genial, etc), pero sabiendo bastante bien que este es uno de esos casos desafortunados cuando los "civiles" (nosotros los consumidores) terminamos en medio de la línea de fuego entre enemigos. Ojo, como consumidor (y después de probar la aplicación de Apple Maps varias veces) hubiese preferido que Apple dejara la aplicación original de Google Maps, pero poniéndome en los zapatos de ellos es entendible que Apple hizo lo que tenía que hacer: Sacar el Caballo de Troya lo antes posible de las paredes de su castillo... Y quiero además que ponderen lo siguiente: Apple, como toda empresa de su naturaleza, siempre busca un nuevo mercado a dónde expandirse, y uno de esos mercados podría muy bien ser el de dispositivos para automóviles, en donde tener una aplicación de mapas es imperativo, pues el potencial de generar ingresos por esa vía es bastante atractivo en un automóvil. Imaginen por ejemplo que tienen un interfaz similar al iPad (pero con botones más grandes) en sus autos. Este posiblemente se controlará con Siri (el asistente de voz de Apple), a quien uno le preguntará/dirá cosas como "llévame a la estación de servicio más cercana" o "busca un restaurante de cómida rápida cercano" o "¿en dónde me pueden revisar el aceite del motor" o "¿en dónde puedo encontrar una ferretería cercana?", y noten que para cada una de esas preguntas existe una oportunidad de Apple asociarse con empresas que provean esos productos y/o servicios y obtener una comisión por referencia. Siri incluso podría ordenar la comida para que cuando llegues sencillamente la recojas y todo se pague con tu cartera virtual de Passbook. Así qué como pueden ver, lo de Apple es una carrera contra el tiempo, en donde debe controlar su ecosistema por completo, pues todas las partes de su maquinaria de ventas depende de las demás. Y viendo las cosas de esta manera, lo que más me sorprende no es que Apple haya hecho esta movida de distanciarse de Google Maps en esta etapa del juego, sino el hecho de que no lo hubiese hecho antes... Actualización (12 horas después de publicado el artículo): Hola amig@s, Disculpen no haber respondido a varios de los "acalorados" comentarios que han surgido respecto al tema :) (hoy fue mi mañana de descanso después de mi charla de ayer, apenas estoy entrando a Internet). Creo que algunos otros lectores en sus comentarios (aunque quizás de manera no muy diplomática que digamos) ya han expresado algunas cosas que es bueno aclarar, así que por si no se hizo bastante obvio en el artículo, he aquí mis comentarios: 1. Creo que fui bastante explícito en el artículo indicando que los mapas de Google son mejores que los de Apple. 2. Expresé explícitamente en el artículo que esto no fue bueno para consumidores, e incluso en el artículo en donde hice mi review de los nuevos mapas los califiqué como "un pasa atrás" por parte de Apple. 3. Mi punto con el artículo fue buscar la posible razón psicológica de Apple para hacer tal movida y reemplazar los mapas de Google por sus propios mapas. 4. Lamentablemente, muchos se apresuraron a interpretar el artículo como que estoy "defendiendo" a Apple. A esos recomiendo re-leer el artículo objetivamente de inicio a fin sin perjuicios o ideas pre-formuladas. El hecho de que yo personalmente admire la ingeniería y arte en los productos de Apple no me ciega ante el hecho de que que (1) estos mapas son malos, y (2) que esto no fue bueno para consumidores. Pero a la misma vez, mi objetividad (sí, objetividad) me permite ponerme en los zapatos de Apple y tratar de entender los motivos de tomar una decisión obviamente tan arriesgada. autor: josé elías |

|

|

|

|

|

viernes, septiembre 28, 2012

|

Una de las cosas más tediosas para muchos es mantener sus listas de contactos sincronizados entre su dispositivo móvil y el mundo exterior. Una de las cosas más tediosas para muchos es mantener sus listas de contactos sincronizados entre su dispositivo móvil y el mundo exterior.Hoy los envío a un truco implementado recientemente por Google que les permite sincronizar todos sus contactos de GMail (y cualquier otro servicio de Google) automágicamente con tu dispositivos iOS (sea iPhone, iPad o iPod Touch). Ojo, que necesitas la versión 5.0 de iOS para que esto funcione... Antes de continuar noten que ya existían maneras de hacer esto, pero eran muy complicadas, utilizando servidores de Microsoft Exchange de por medio. Con este truco es solo cuestión de configurar un par de cosas y listo. El truco está en que Google ahora soporta un estándar abierto de intercambio de contactos llamado CardDAV, que los dispositivos iOS soportan por defecto, y en la guía oficial en español a donde los envío hoy aprenderán como hacer la conexión. Después que hagan esto, tus contactos estarán sincronizados tanto en iOS como en las redes de Google, pudiendo tu agregar, borrar o modificar contactos, y que esos cambios se propaguen automáticamente entre tus cuentas. enlace a la guía autor: josé elías |

|

|

|

|

|

jueves, septiembre 27, 2012

|

Hola amig@s, Hola amig@s,El próximo lunes 1ro de Octubre 2012, a las 17:45 horas (5:45pm) estaré impartiendo una charla en el evento "XXII Encuentro GeneXus: Tecnología, Innovación y Negocios en América Latina - Un Free pass al crecimiento, tu Growingpass". El evento será los días 1 al 3 de Octubre en el Hotel Radisson de Montevideo, Uruguay, y es un evento en donde llegan más de 3,500 profesionales de la informática de todo el mundo, en particular los que circulan en torno a la plataforma GeneXus de ArTech (y de la cual ofrecí mis impresiones la primera vez que los visité hace un par de años). Noten que este evento, aun se enfoque en GeneXus, tiene la particularidad de que sus organizadores captan muchos oradores de renombre de la industria, y tan solo por las charlas vale la pena asistir, pues por lo general son charlas de mucha importancia para desarrolladores de software en general. Cada año (y al igual que este) vemos ejecutivos de alto rango de empresas como Amazon, Google y Microsoft ofrecer sus visiones a los asistentes. Este año estreno una charla nueva en el evento cuyo resumen es el siguiente: Los titanes de hoy, y 1 día dentro de 10 años ¿En dónde están parados gigantes como Google, Apple, Samsung, Microsoft, Amazon y otros en estos momentos, y hacia dónde se dirigen? En esta charla veremos el estado actual de estos titanes y una opinión sobre sus estrategias al corto plazo, así como imaginaremos un día típico con los productos de estos proveedores dentro de 10 años. ¿Cuáles serán los adelantos, maravillas, retos y oportunidades que tendremos en esos momentos? Imaginaremos 24 horas antes de la conferencia GeneXus XXXII en el año 2022. ¡Así que espero ver a algunos de ustedes por allá como de costumbre! página oficial del evento (donde pueden subscribirse para asistir) lista de oradores de este año información oficial sobre mi charla Nota: Para invitarme a una conferencia/charla, solo deben seguir estos pasos. autor: josé elías |

|

|

|

|

|

jueves, septiembre 20, 2012

|

Después de varios meses en espera, ayer llegó a nuestros dispositivos la más reciente versión del sistema operativo iOS para el iPhone 3GS, iPhone 4, iPhone 4S, iPad 2, iPad 3 y iPod Touch 4ta Generación (y obviamente, es la versión con la cual llega el iPhone 5 esta semana). Después de varios meses en espera, ayer llegó a nuestros dispositivos la más reciente versión del sistema operativo iOS para el iPhone 3GS, iPhone 4, iPhone 4S, iPad 2, iPad 3 y iPod Touch 4ta Generación (y obviamente, es la versión con la cual llega el iPhone 5 esta semana).Así que después de unas horas dándole uso, estas son mis primeras impresiones... 1. Siri en español Siri viene con tres versiones distintas de español, una optimizada para español de España, otra para México, y otra para los EEUU. Noten que eso no significa que deben estar en esos países para utilizar Siri o para que Siri los entienda, sino que simplemente son optimizaciones (yo personalmente utilicé la versión de EEUU, pero asumo que la mayoría utilizará la versión de México en América Latina). Lo único malo de Siri en español es que la voz sintética no se acerca en calidad a la voz en inglés, y que requiere que el dispositivo esté conectado al Internet para funcionar, pero más allá de esas cosas funciona excelentemente. Otra cosa que es bueno saber es que el lenguaje en el cual programen a Siri es independiente del lenguaje de iOS que utilicen. Así que es perfectamente normal tener iOS en inglés y Siri en español por ejemplo. Noten que para activar a Siri en el idioma de sus preferencias deben ir a Configuración, después General, y después Siri. Ahí verán las opciones correspondientes. Y la manera más fácil de activarlo para que te escuche es dejando presionado por unos segundos el botón principal de tu iPhone, iPad o iPod Touch hasta que aparezca el micrófono de Siri. Así mismo, notarán que ahora en cualquier lugar en donde surja el teclado para escribir, encontrarán un pequeño micrófono a la izquierda de la tecla de espacio. Si presionan ese micrófono, ahora pueden dictarle a Siri para que escriba por ustedes (ojo: asegúrense de tener el teclado en español en la configuración de sus dispositivos). 2. Mapas de Apple Por otro lado, estos mapas se ven espectaculares, incluyendo en 3D (más espectaculares aun), y las direcciones que te da para manejar son las más intuitivas que he visto en un dispositivo a la fecha. Sin embargo, aun así me hace falta Google Maps. Lo ideal sería una versión que tuviera los datos de Google Maps con el nuevo interfaz de Apple (vale la pena soñar). Una buena noticia es que antes de finalizar el año (o incluso quizás en las próximas semanas) se espera una versión super-mejorada de Google Maps en el App Store (la cual estoy casi seguro se disparará a la posición #1 entre las aplicaciones gratuitas más populares el día que salga). Pero ojo, la aplicación no es mala. Como dije, su interfaz es superior al de Google Maps, y si lo que buscan está en el mapa la pasarán super bien. Pero no me cabe la menor duda que muchos se sentirán que han dado un paso atrás en relación al detalle de los mapas. Truco: Al igual que Google Maps en Android, cuando pongan a Apple Maps en 3D, pueden poner dos dedos en pantalla y moverlos juntos hacia arriba o hacia abajo para mover el piso en 3D, o girarlos para darle vuelta a la pantalla. Algunas ciudades como New York City se ven asombrosas en 3D, y el interfaz es super-fluído. 3. FaceTime en 3G/LTE 4. Photo Stream Compartido 5. Integración con Facebook 6. Passbook Lean sobre la importancia de Passbook en este artículo previo en eliax. 7. App Store El App Store cambió radicalmente, y aunque ahora ofrece más información sobre cada aplicación en particular, a mi me gustaba más la versión anterior que mostraba más información que ahora en el mismo espacio. Quizás sea una cuestión de gustos, pero siento que esto junto con mapas no fue un adelanto en iOS... Por otro lado, algo bueno de la nueva versión es que ahora no tienes que escribir tu clave una y otra vez solo para actualizar las aplicaciones, y ahora no te saca de la tienda cada vez que instalas una aplicación (antes te sacaba para mostrare en donde instalaba la aplicación). 8. Opciones para responder llamadas 9. Funcionalidad de "No molestar" 10. Mejoras en Mail Incluso, puedes decirle al iPhone que no reciba llamadas de nadie excepto de tus contactos marcados como "favoritos" u otros grupos. Pensaron esto tan bien que incluso pusieron una opción que si la habilitas el iPhone toma la llamada si la llamada es del mismo número en un intervalo menor a 3 minutos (es decir, si alguien llama más de una vez en menos de 3 menos se podría deducir que es una llamada importante y/o urgente). 11. Pestañas Safari en iCloud 12. Panoramas con la cámara Esto es algo que verdaderamente sorprende como lo implementó Apple (y solo funciona en el iPhone 5 y Phone 4S). Se trata de que ahora dentro de la aplicación de la cámara tienes una opción llamada Panorama, la cual si activas te pide que por favor presiones el botón de tomar la foto y empieces a mover el iPhone lentamente hacia la derecha. Lo asombroso es que el iPhone va generando en tiempo real el panorama mientras mueves el iPhone. Es como si estuvieses pintando una foto de izquierda a derecha y hay que ver esto en persona para apreciar lo que Apple hizo con esto... En resumen, con esta versión de iOS 6 Apple da un par de pequeños pasos hacia atrás (con Apple Maps y la rediseñada App Store), pero varios pasos más hacia adelante en usabilidad, facilidad de uso, conveniencia y utilidad. lista oficial en español de algunas de las cosas nuevas en iOS 6 autor: josé elías |

|

|

|

|

|

martes, septiembre 18, 2012

|

Amazon, como muchos saben, desde hace unos 3 años es la empresa a la que si fuera una carrera de caballos, apostaría para ser el gran reto para Apple y Google, y esta nueva movida de la empresa cementa más mis pensamientos de que Amazon es la más grande amenaza que Apple y Google tienen en el mercado... Amazon, como muchos saben, desde hace unos 3 años es la empresa a la que si fuera una carrera de caballos, apostaría para ser el gran reto para Apple y Google, y esta nueva movida de la empresa cementa más mis pensamientos de que Amazon es la más grande amenaza que Apple y Google tienen en el mercado...La empresa acaba de anunciar unos APIs (interfaces de programación para programadores) que permite que los que programen aplicaciones para las Kindle Fire puedan acceder a una aplicación de mapas diferente a la de Google Maps. Sin embargo, este anuncio revela mucho más de lo que aparenta sobre la superficie... Primero (y lo más obvio), es que este es otro paso para Amazon terminar por completo cualquier dependencia que tenga de Google, salvo el obvio hecho que Google es quien coordina el sistema operativo Android, sobre el cual se basa el sistema Kindle Fire de Amazon (digo "se basa", pues no es en realidad 100% Android, sino que una versión personalizada por Amazon para hacer sus dispositivos más amigables e intuitivos). Y segundo, y lo menos obvio (pero para mi, más interesante) es el hecho de que esto nos hace hacer la pregunta: ¿No sería una aplicación de mapas algo más indicado para un celular que una tableta? En mi opinión, esto es una pista más de que Amazon está a todo vapor dentro de su empresa desarrollando un celular que hará juego con el Kindle Fire (ver #18 aquí). A tal celular lo he estado llamando desde el año pasado "Kindle Ice" (y creo que a otros se les ha ocurrido el mismo nombre, dado lo lógico del caso), y de Amazon no sorprendernos para finales de este año con tal celular, creo casi inevitable que lo veremos el próximo año 2013... página oficial del Amazon Maps API anuncio oficial autor: josé elías |

|

|

|

|

|

lunes, septiembre 17, 2012

|

Hola amig@s, Hola amig@s,Este fin de semana pasado asistí como Mentor y Juez al Startup Weekend 2012 celebrado en Santiago, República Dominicana (este evento se celebra en casi todos los países, continúen leyendo...), y he salido con impresiones bastante favorables sobre mi experiencia, y que quiero compartir con ustedes. Si son de las personas que constantemente tienen ideas, o incluso que creen tener una sola pero gran (y/o simple) idea, y desean hacerla realidad, hay pocos otros eventos en el planeta en donde la puedan llevar a cabo como en este... La idea del Startup Weekend es sencilla: Un grupo de personas de distintas habilidades y disciplinas se reúne, exponen sus ideas, y de entre todas por votación se eligen las que más gustaron. El resto de los participantes se une a estas ideas (de su elección), se forman entonces los grupos finales, e inicia el evento a todo vapor. En el evento por lo general asisten desarrolladores de software, diseñadores gráficos, soñadores (quizás sin conocimientos técnicos pero con ideas), y en menor medida hasta abogados y personas involucradas en la vida real con negocios de diferentes índoles. Cuando menos en este primer evento que asisto, aproximadamente la mitad de las personas que asistieron tenían una idea a exponer, el resto fue a apoyar proveyendo sus habilidades y (principalmente) para aprender. La mayoría eran jóvenes, aun en la universidad (que no es un requerimiento para asistir). En mi opinión se obtienen tres potenciales grandes beneficios al asistir a este tipo de eventos: 1 Aprender. Les puedo asegurar sin temor a equivocarme que lo que aprenderán en apenas 54 horas será en muchos sentidos mayor y de más utilidad que algunos semestres universitarios, y la razón es muy sencilla: Esto es pura práctica, teoría puesta en acción, y se sorprenderán de cuantas cosas que antes ni prestaban atención o minimizaban son importantes a la hora de crear un emprendimiento exitoso en la vida real. 2. Formar contactos ("networking" como se dice mucho en inglés). Esto es primordial, y se sorprenderán de los contactos que harán en el evento. Fueron varios los que se llevaron los contactos de otros para temas de colaboración en otros proyectos. Si crees tener talento en algo, este es un excelente lugar para demostrarlo y hacer que otros quieran trabajar contigo en el futuro. 3. Hacer tu negocio realidad. Al menos 4 de los 6 proyectos que se presentaron han decidido seguir hacia adelante con el proyecto y hacerlo realidad más allá del evento, y después de haber charlado con algunos de los participantes noté que se les encendieron las bombillas de ideas y algunos han decidido probar su suerte lanzando sus propios otros proyectos basados en las técnicas aprendidas durante el fin de semana del Startup Weekend. Y si tienen suerte (y un proyecto viable con mucho potencial), es posible que del mismo evento surja el financiamiento que necesitan para arrancar inmediatamente. Yo personalmente disfruté muchísimo de mi rol en el evento, el cual fue compuesto por tres días intensos, super-energéticos, y agotadores pero gratificantes para todos. Felicidades a los ganadores de los tres primeros lugares por 3 ideas fabulosas, las cuales las tres se planea lanzarlas como emprendimientos fuera del evento (voy a obviar detalles de los proyectos por motivos de confidencialidad): 1. Equipo de Let's Do.Do 2. Equipo de Bomelo 3. Equipo de RED_do Así mismo, eternas gracias a José Miguel Infante quien tuvo la misión (y agallas) de tomar la iniciativa de traer el evento de Startup Weekend a Santiago, República Dominicana (y gracias inmesurables para Andrés Hernández quien se desplazó desde Costa Rica para trabajar como el guía del evento). Algo me dice que esto es el inicio de algo grande para la región... Y finalmente quiero decir que la inscripción al evento cuesta el equivalente a ir a un buen restaurante y disfrutar de una buena comida un solo día, pero la experiencia del Startup Weekend es una que los alimentará toda una vida... Nota aclaratoria a conspiracionistas: No me pagaron un centavo por asistir o promocionar este evento, y no tengo ninguna afiliación con los organizadores. Expreso mi experiencia y consejo de asistir en este evento porque realmente vale la pena hacerlo, en particular para la juventud emprendedora de nuestros países hispano-parlantes (noten que este evento ocurre en la mayoría de países del mundo, por lo que consulten la página principal del Startup Weekend para fechas en sus países, o incluso pueden ustedes mismos organizar uno de estos eventos). Página del Startup Weekend Santiago Rep. Dominicana Páginas oficial y global del Startup Weekend autor: josé elías |

|

|

|

|

|

viernes, septiembre 14, 2012

|

Hola amig@s, Hola amig@s,Hoy inicia el evento Startup Weekend Santiago 2012, en donde si tienes una idea de negocio que se pueda implementar con una base tecnológica, puedes presentarla, trabajarla con un equipo de programadores durante el fin de semana, y posiblemente hasta conseguir inversionistas que hagan tu idea realidad si esta está entre las ideas ganadoras del fin de semana. Yo estaré asistiendo desde hoy hasta el domingo al evento, como Mentor y como Juez (ojo, no me pagan por esto, ni directa ni indirectamente, acepté estar en esto porque me gusta incentivar a los jóvenes en ser emprendedores). Noten que todavía están aceptando nuevos equipos, y no pierden absolutamente con atender al evento (incluso, creo que el solo ser parte del evento podría beneficiarles en sus carreras por medio de los contactos que harán en el evento). Para más información, los refiero al anuncio oficial que hice hace unos días acá en eliax. página oficial del evento (contacten por esa vía por favor si desean más información) Un video realizado localmente sobre el evento (enlace YouTube)... autor: josé elías |

|

|

|

|

|

martes, septiembre 4, 2012

|

Hola amig@s lectores, Hola amig@s lectores,Hoy respondo a una pregunta muy popular en mis charlas sobre la Singularidad Tecnológica, y es el tema de la reproducción sexual y el papel que esta jugaría en un hipotético caso de que lleguemos a un etapa post-Singularidad en donde todos poseamos cuerpos sintéticos super-adaptables al medio ambiente (o incluso no tener la necesidad de cuerpos, sino que ser Seres Virtuales dentro de una máquina compartida con otros seres). La pregunta es, ¿jugará algún papel la reproducción sexual en ese hipotético futuro? La respuesta a esa pregunta no la puedo dar muy directa que digamos, pues hay muchos componentes que juegan en todo esto, y sin explicar esos componentes no van a entender mi respuesta... Lo primero es, que debemos entender que el acto sexual hay que dividirlo en dos partes: La parte reproductiva, y la parte placentera. Los seres humanos nos pasamos gran parte de nuestro tiempo pensando en la parte placentera del sexo, y la razón de pasarnos tanto tiempo pensando en hacer el amor no es (como alegan algunas religiones) porque somos seres morbosos, sino porque es un mecanismo evolutivo de las especies. En esencia, lo más importante en la evolución es que los patrones perduren en el tiempo, y en el caso de animales como los humanos, eso significa el reproducirnos, por lo que quizás el deseo más potente de todo ser humano es el acto sexual, ya que ese deseo (y el placer asociado) es la garantía más fuerte que tiene la evolución de que no perezcamos como especie. Entonces, podemos decir que el acto sexual es en esencia un deseo de placer, pero cuyo objetivo "en el gran orden de las cosas" no es el placer en sí, sino que la supervivencia de la especie. Habiendo dejado claro el tema de acto sexual y su objetivo, podemos progresar ahora a una respuesta objetiva más fácil de entender… Asumamos (y recordemos, en el hipotético caso de que todo el tema de la Singularidad se cumpla) que un ser humano del futuro desee tener hijos. ¿Cómo lo haría? Pues ya que no tendríamos las limitaciones biológicas que poseemos hoy día, podríamos reproducirnos cuando menos de las siguientes formas: 1. Haciendo una copia idéntica a nosotros mismos Esto sería trivial, pues si somos seres sintéticos, podríamos hacer una copia de nuestros patrones mentales sintéticos de la misma manera que hoy día un técnico en computación puede hacer una copia del contenido de una PC a otra. Esta forma de crear vida quizás no la consideremos tanto como crear "hijos", sino que más bien como crear "clones" de nosotros mismos. 2. Creando vida desde cero Esto no es tan trivial, pero si asumimos que en ese hipotético futuro somos seres capaces de evolucionar a un ritmo exponencial, también podemos suponer que ya tendremos entendido con todo lujo de detalle los procesos que conllevan a crear vida, y la podremos crear en cualquier momento. Esta forma de crear vida "desde cero" tiene la particularidad de que los patrones del nuevo ser (y su forma de pensar) podrían ser bastante diferentes a los del creador (sería por ejemplo como que un humano hoy día creara un bebé desde cero sin utilizar su propio material genético). Aunque obviamente, seria posible también crear vida parecida a nosotros mismos (ver el próximo punto). 3. Mezclando genes digitales Esta es la forma más interesante, ya que quizás cuando uno cree vida en el futuro, una de las características que uno posiblemente desee es que la vida creada sea un nuevo escalón en nuestras propias vidas, una evolución de nosotros mismos. Esto sería equivalente al acto sexual de hoy día en donde combinamos los genes de una mujer y un hombre para concebir un bebé cuyo material genético es una combinación de ambos. Sin embargo, en el futuro esta forma de mezclar "genes digitales" tendrá una particularidad que no tenemos hoy día: No se necesitará necesariamente de dos seres que provean genes (aunque ciertamente, será una modalidad válida). En ese futuro, será posible que una sola persona provea todos los genes a su hijo, insertando variaciones aleatorias (o diseñadas) en el genoma para que el bebé sea un poco diferente al padre/madre. De la misma forma, no hay razón para que más de dos personas (incluso, 3, 10 o 100 personas) provean material genético para la nueva criatura. Ese tipo de cosas que hoy muchos quizás vean como "aberraciones", serán temas que tarde o temprano tendremos que manejar, y que tengo el presentimiento serán "de lo más normal" en el futuro. En cuanto a la parte del placer, mi opinión es que posiblemente la separaremos de la parte de procreación (aunque una vez más, también tendremos la opción de que ocurran al mismo tiempo). En un futuro en donde podamos entender con gran exactitud el efecto de ciertos patrones en nuestras mentes, el placer sexual (y todo tipo de placer) será amplificado a niveles hoy día inimaginables, y tales placeres estarán disponibles constantemente en cualquier momento que uno lo desee, lo que una vez más hará que muchos se planteen ¿hacia qué tipo de mundo nos dirigimos? Quiero aclarar que estas opiniones mías no se basan en lo que deseo suceda en el futuro, sino hacia donde veo nos está llevando la tecnología. ¿Será ese el fin de la humanidad? No lo creo, más bien lo veo como la cúspide de la humanidad. Sin embargo, jugando al abogado del Diablo tampoco me puedo cegar ante ciertas preocupaciones… Por ejemplo, podríamos llegar a un futuro en donde el placer sea tan intenso, y obtenible para cualquiera tan fácilmente y de forma instantánea, que me pregunto si preferiremos estar en un constante modo de placer las 24 horas del día y los 365 días del año, y nos olvidaremos de todo lo demás (crear y/o disfrutar de obras de arte y de música, explorar el universo, etc), terminando nosotros como "zombies conectados", mientras máquinas automatizadas atienden a nuestras necesidades energéticas hasta el final de los tiempos… Es un panorama triste (si lo vemos desde nuestro punto de vista hoy), pero creo que no se dará (e incluso, puse el ejemplo preventivamente por si alguien lo preguntaba en los comentarios). En mi opinión, los placeres con el tiempo disminuirán, ya que así como crearemos placeres, también crearemos vacunas para tales placeres. Pero, ¿por qué alguien querría una vacuna que le quite un placer indescriptiblemente bueno? Pues quizás como un mecanismo de defensa que nosotros mismos crearemos para no quedar esclavos de nosotros mismos. Recordemos que a diferencia de una mente de la actualidad adicta a algo como la cocaína, que nuestras mentes del futuro podrán reprogramarse a voluntad, y eso significa que podremos disfrutar del placer cuando queramos, y en el momento que deseemos atender a otras cosas podremos reprogramar nuestras mentes para no sentir ni la más mínima sensación de adicción o deseo hacia un particular tipo de placer. A donde voy con esto es que aunque nos dirigimos hacia tiempos inciertos, que también creo que como ya lo hemos hecho antes (solo noten la forma en que hemos adoptado la TV, el Internet, la Web, las redes sociales, los celulares, etc) vamos a simultáneamente buscar soluciones a todas las incógnitas que nos surjan en el camino, y terminaremos adaptándonos y asimilando los nuevos patrones. Y si yo hoy día a inicios del Siglo 21 ya estoy pensando en formas de evadir tales problemas, estoy seguro que mentes muchísimo más avanzadas que la mía pensarán en ello también, y en formas que pocos hoy día podrían imaginarse. Sí, soy un eterno optimista… :) autor: josé elías |

|

|

|

|

|

martes, agosto 28, 2012

|

Hoy quiero hablarles brevemente del proyecto 2045, fundado por el multi-millonario ruso Dmitry Itskov en febrero del año 2011 pasado, un proyecto a largo plazo en donde en esa nación planean tener seres sintéticos más capaces que seres humanos, para el año 2045... Hoy quiero hablarles brevemente del proyecto 2045, fundado por el multi-millonario ruso Dmitry Itskov en febrero del año 2011 pasado, un proyecto a largo plazo en donde en esa nación planean tener seres sintéticos más capaces que seres humanos, para el año 2045...El proyecto lo llaman Avatar, y lo han dividido en 4 faces bastante ambiciosas: Avatar A: A estar disponible entre el 2015 y 2020, será una copia robótica del cuerpo de un ser humano, que será controlado remotamente por un ser humano biológico, por medio de tecnologías BCI (Interfaz Cerebro-Máquina). Esto es similar a la película Surrogates con Bruce Willis, pero sin el tema de poder sentir sensaciones remotas. Avatar B: A estar listo entre el 2020 y 2025, será un Avatar dentro del cual se trasplantará el cerebro biológico de un humano cuando este llegue al fin de sus días en su cuerpo biológico. En otras palabras, Avatar A serviría como entrenamiento del cerebro para cuando se trasplante el cerebro a un Avatar B. Avatar C: A estar listo entre el 2030 y 2035, será un Avatar con un cerebro sintético, dentro del cual se volcará la personalidad del cerebro de un ser humano biológico cuando este llegue al fin de sus días. En esencia, se traspasará el "yo" desde el cuerpo biológico al sintético completamente (como debatido previamente en eliax). Avatar D: A estar listo entre el 2040 y 2045, en donde la idea es crear un Avatar holográfico que represente a un Avatar sintético. Ahora bien, ¿será todo eso posible? Honestamente no puedo estar 100% seguro que en ese tiempo será posible, pero de que en algún momento será posible (y muy posiblemente en este siglo), hay muchas posibilidades de ello, y dado que la ciencia y la tecnología avanzan exponencialmente (leer sobre La Singularidad Tecnológica), si el Poryecto 2045 se cumple en los tiempos estipulados, no me sorprenderé (y al contrario, me maravillaré). ¿Por qué les hablo de este proyecto hoy? Pues ya que después de tener muchísimo publicidad en tiempos recientes, los creadores de 2045 han decidido crear su propio partido político en Rusia, pero con aspiraciones globales. Lo llaman Evolution 2045. Ojo, que no hablamos de "global" como de un solo gobierno global, sino que global en el sentido de que están alentando a otras naciones a crear partidos políticos similares dentro de cada una de sus fronteras, inspirados por el 2045. Más allá de el factor "curiosidad" de esta noticia, la razón por la cual la publico más que nada es porque esto es una clara señal de los tiempos, unos tiempos que muchos creían veríamos dentro de mil años, y que literalmente estamos viendo desplegar ante nuestros ojos a inicios del siglo 21. Me refiero específicamente al gran rol que la ciencia y la tecnología está teniendo en la sociedad, similar a los roles que una vez tuvieron las religiones/supersticiones, o las revoluciones agrícolas e industriales. Hablamos de que nos aproximamos a un Era en donde la ciencia y la tecnología serán los pilares que dictarán otras facetas de la sociedad, desde economía (como ya lo hacen hoy día) hasta el tema gubernamental (como empezamos a ver con la integración tecnológica entre las grandes naciones). Este partido político Evolution 2045 es apenas un escalón más hacia un futuro en donde derribaremos las fronteras invisibles que hemos trazado alrededor de nuestros países, y nos uniremos naturalmente en una sola Aldea Global (término popularizado en inglés por Marshall McLuhan). Es el inicio de un futuro que en realidad ya había iniciado con la popularización de la imprenta en los años 1400s, y posteriormente con el desarrollo del Internet en la actualidad y las redes sociales, que facilitaron movimientos como la Primavera Árabe del 2010 al 2011. Así que no lo duden, bajo las narices de los incrédulos, escépticos y negativistas, estamos forjando el próximo gran paso en nuestra integración social... ¡Gracias al lector Carlos Bello por alertarme del nuevo partido político! página oficial del proyecto 2045 página del partido político Evolution 2045 Video a continuación sobre el Proyecto 2045 (enlace YouTube)... autor: josé elías |

|

|

|

|

|

lunes, agosto 27, 2012

|

Una de las herramientas menos conocidas de Google es su Crisis Map, que utilizando el poder de su plataforma Google Maps permite trazar de forma interactiva en un mapa todos los potenciales y actuales problemas que podrían llevar a desastres naturales, desde huracanes hasta tsunamis. Una de las herramientas menos conocidas de Google es su Crisis Map, que utilizando el poder de su plataforma Google Maps permite trazar de forma interactiva en un mapa todos los potenciales y actuales problemas que podrían llevar a desastres naturales, desde huracanes hasta tsunamis.Para acceder a la herramienta, hagan clic en este enlace. Y si quieren ver la herramienta con un caso específico, hagan clic aquí para ver la tormenta Isaac. autor: josé elías |

|

|

|

|

|

viernes, agosto 24, 2012

|

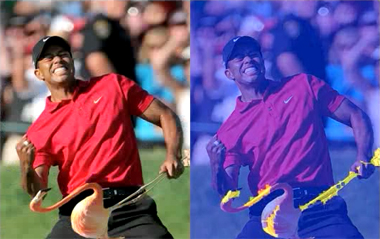

Uno de los problemas más grandes que enfrentan las grandes agencias de noticias es el de recibir fotografías de reporteros que desconocen si han sido o no manipuladas. Uno de los problemas más grandes que enfrentan las grandes agencias de noticias es el de recibir fotografías de reporteros que desconocen si han sido o no manipuladas.Existen cámaras que pueden cifrar las imágenes y garantizar a las agencias que estas no han sido modificadas en ninguna forma, pero eso es solo para unos cuantos fotógrafos. ¿Cómo saber que una fotografía de un ciudadano cualquiera no es en realidad una foto manipulada para fines conspiracionistas o propagandistas? Pues ahora un grupo de científicos de la Universidad de Albany en los EEUU ha creado una técnica que nos puede decir con mucha facilidad si una foto fue alterada o no. Noten que por "alterada" hablamos exclusivamente de si esta contiene elementos que antes no estaban, o que elementos que estaban fueron removidos, y no si los colores o exposición de esta han sido alterados (cosa que es admisible en la mayoría de los casos). El truco de la técnica consiste en notar que distintas imágenes contienen distintos patrones de "ruido digital" cuando uno las analiza de forma ampliada (imaginen, bajo una lupa). Es decir, imágenes captadas en ambientes oscuros por lo general tienen mucho "ruido" y por eso se ven de mala calidad, pero incluso dos imágenes tomadas a la misma hora contienen ruido diferente por diversos factores, como la apertura utilizada, el ISO, el tipo de sensor, el tipo de lente utilizado, etc, por lo que es casi imposible que dos fotos (en particular, tomadas desde puntos de vista y tiempos distintos) sean idénticas. Utilizando esos datos, los científicos crearon un algoritmo que detecta esos patrones de "ruido" en la imagen, y nota las partes de la imagen en donde el ruido es diferente, lo que es una pista de que esa parte de la imagen proviene de una foto diferente. En la imagen que acompaña el artículo pueden ver como una foto falsa del golfista legendario Tiger Woods agarrando un flamingo en vez de un palo de golf, es fácilmente detectada en la imagen de la derecha, resaltándose en amarillo las áreas de ruido que difieren. Lo bueno de esto es que es una técnica tan sencilla, que no me sorprendería si fuera una funcionalidad rutinaria de cualquier software (incluyendo cámaras, programas de edición como Photoshop, o incluso portales sociales). fuente autor: josé elías |

|

|

|

|

|

jueves, agosto 23, 2012

|

Alan Turing, uno de los más grandes genios de todos los tiempos, pionero en computación (hoy todas las computadoras utilizan esencialmente el mecanismo descrito por él), héroe de la Segunda Guerra mundial (fue gracias particularmente a él que los Aliados pudieron detener como lo hicieron a Hitler, al su intelecto descodificar la máquina de cifrado de datos Enigma de los Nazis y de esa manera poseer inteligencia crucial para derrotarlos), y una de las personas que más admiro en mi vida, más allá de sus grandes contribuciones a la ciencia (y lamentablemente no ser correspondido por la sociedad, pues era gay y se suicidó debido al mal trato que tuvo en Inglaterra en donde ser gay era un delito en esos días), dejó otro regalo más para la cultura popular y futuras generaciones: El famoso Turing Test. Alan Turing, uno de los más grandes genios de todos los tiempos, pionero en computación (hoy todas las computadoras utilizan esencialmente el mecanismo descrito por él), héroe de la Segunda Guerra mundial (fue gracias particularmente a él que los Aliados pudieron detener como lo hicieron a Hitler, al su intelecto descodificar la máquina de cifrado de datos Enigma de los Nazis y de esa manera poseer inteligencia crucial para derrotarlos), y una de las personas que más admiro en mi vida, más allá de sus grandes contribuciones a la ciencia (y lamentablemente no ser correspondido por la sociedad, pues era gay y se suicidó debido al mal trato que tuvo en Inglaterra en donde ser gay era un delito en esos días), dejó otro regalo más para la cultura popular y futuras generaciones: El famoso Turing Test.El Turing Test (o "Prueba de Turing" o "Exámen Turing"), es una prueba diseñada para determinar si algo (sea un software de Inteligencia Artificial, o un Ser Sintético, etc) es "inteligente" con un ser humano. En esencia, la prueba es extremadamente simple: Pones detrás de una pared tanto al software de Inteligencia Artificial (IA) como a un humano, y de este lado de la pared ponemos a una persona que los debe cuestionar a ambos. El truco está, en que la persona que hace las preguntas no pueda ver quién le está respondiendo, si la IA o el humano, y por tanto deba deducir cuál es humano y cuál es sintético. La idea entonces es, que si uno no puede distinguir cuál de los dos es el humano biológico, después de innumerables preguntas, que debemos concluir que la IA es también inteligente como una persona. Pues bien, según un artículo reciente, el investigador Robert French del French National Center for Scientific Research afirma que estamos muy cerca de pasar esa prueba. En el artículo explica como en tiempos pasados las máquinas utilizaban algoritmos rígidos, estáticos y pre-programados para resolver problemas a "fuerza bruta" por pura lógica, pero que se hizo obvio que se necesitaba más que fuerza bruta para que una máquina fuera "inteligente". Así que este investigador afirma (en un artículo publicado en la prestigiosa publicación científica Science (en el ejemplar del 12 de Abril 2012) que hoy día dos avances revolucionarios están permitiendo que pronto se pase el Turing Test. El primero de estos es la gran cantidad de información que en años recientes se ha hecho disponible en internet, desde millones de videos en YouTube, hasta cientos de millones de fotos en Flickr, y desde incontables páginas web y blogs, hasta miles de millones de hechos descritos textualmente, lo que en esencia proveen de un ambiente de aprendizaje virtual para las Inteligencias Artificiales, similar al ambiente físico en que un bebé crece mientras aprende del mundo. El segundo de estos avances en una nueva generación de técnicas para recolectar, organizar y procesar toda esa información, en esencia de una forma no lineal y caótica, permitiendo que IAs aprendan y reacciones incluso a imprevistos en su programación. Un buen ejemplo de esto fue Watson, la super-computadora de Inteligencia Artificial de IBM, que el año pasado le ganó a los dos más grandes campeones del mundo en el juego intelectual Jeopardy!. Watson en esencia fue diseñado para "soltarse" y dejar que aprenda solo todo tipo de hechos, y haga sus propias correlaciones sobre cuáles cosas son relevantes y cuáles no. Watson ha aprendido tanto, que hoy día IBM ya lo renta por hora a los más avanzados hospitales del mundo, para ayudarlos a diagnosticar enfermedades y condiciones a un nivel superior que la mayoría de los más reconocidos doctores del mundo. Mi opinión personal de todo esto, como ya los lectores veteranos del blog conocen (y los que leyeron mi libro del 2001, Máquinas en el Paraíso), es que es solo cuestión de tiempo para que no solo una IA pase la prueba de Turing, sino para que eventualmente no supere no solo en intelecto, sino que en creatividad, imaginación, sentimientos, y toda la gama de atributos que asociamos a ser "humano"... autor: josé elías |

|

|

|

|

|

|

Uno de los secretos peor guardados entre profesionales de video y fotografía en el campamento Canon es una modificación a sus cámaras llamada Magic Lantern ("Linterna Mágica"), una herramienta que modifica el sistema operativo de tu cámara DSLR y la convierte literalmente en una super cámara. Uno de los secretos peor guardados entre profesionales de video y fotografía en el campamento Canon es una modificación a sus cámaras llamada Magic Lantern ("Linterna Mágica"), una herramienta que modifica el sistema operativo de tu cámara DSLR y la convierte literalmente en una super cámara.Lo que Magic Lantern hace es substituir el software que viene instalado por defecto en tu cámara, para reemplazarlo por uno muchísimo más potente y que te ofrece muchísimo más control sobre tu cámara, así como permitirle hacer cosas que antes no podía hacer, e incluso que no se pueden hacer en cámaras de cualquier precio. Es importante notar que Magic Lantern está disponible solo para unos modelos específicos de cámaras Canons, y que estos deben estar actualizados a versiones específicas del firmware (sistema operativo de bajo nivel) antes de uno hacer la actualización. Las cámaras y versiones de firmware soportados en la versión actual de Magic Lantern 2.3 son estas: Canon 5D Mark II v2.1.2 Canon 50D v1.0.9 Canon 60D v1.1.1 Canon 500D (Canon T1i, Canon Kiss X3) v1.1.1 Canon 550D (Canon T2i, Canon Kiss X4) v1.0.9 Canon 600D (Canon T3i, Canon Kiss X5) v1.0.2 Si tienen una de esas cámaras, continúen leyendo, pero noten que este tipo de modificaciones aunque han sido probadas por miles de personas, siempre tienen el riesgo de dejar tu cámara en algún modo desconocido, aunque si sigues las instrucciones bien (y es muy importante leer la documentación) no deberían tener problemas. Y noten que el programa es gratuito, pero recomiendo hagan una donación en la página del proyecto. Magic Lantern contiene literalmente decenas de nuevas opciones, por lo que es importante leer la documentación, pero algunos que me encuentro interesantes y bastante útiles son: 1. AGC Off Con esto puedes desactivar el control automático del volumen del audio (Automatic Gain Control), de modo que ahora tu cámara puede grabar sonido a nivel profesional libre de ruido, permitiendo conectar micrófonos directamente a la cámara, sin tener que invertir en costosas soluciones de grabación externa. 2. Intervalómetro  Con esto ya no tienes que comprar un intervalómetro externo, y de paso es muchísimo mejor que muchos de los más avanzados del mercado. Con esto ya no tienes que comprar un intervalómetro externo, y de paso es muchísimo mejor que muchos de los más avanzados del mercado.Un intervalómetro te permite programar la cámara para que esta capte por sí sola una serie de fotos en intervalos específicados, y por un especificado intervalo de tiempo en cada fotografía, entre otras cosas avanzadas. Con esto puedes hacer muchos efectos que se ven en películas y documentales en donde las nubes pasan volando rápidamente, y se ven los automóviles de las ciudades nocturnas pasar volando como rayos láser. Entra las opciones avanzadas están "Focus Ramping" ("Rampa de enfoque"), en donde puedes programar la cámara para que paulatinamente vaya enfocando y/o desenfocando la escena automáticamente sin tu tener que tocar (y mover accidentalmente) la cámara. Otra opción para astrofotógrafos es la capacidad de poner la cámara en modo "Bulb" por períodos de hasta 8 horas (para por ejemplo captar el movimiento de las estrellas en el cielo). 3. Bracketing automático en modo HDR  Una foto HDR (High Dynamic Range) es en esencia una foto tomada con varios valores de exposición. La forma más simple de HDR en esencia toma 3 fotografías, un expuesta normalmente, otra expuesta para las áreas oscuras, y otra para las áreas claras, y las combina. Pero con esta nueva funcionalidad, la cámara toma una fotografía, la analiza en tiempo real, y determina cuántas imágenes más (sobreexpuestas y subexpuestas) necesita para cubrir el 100% del rango dinámico de la imagen, procede a tomar las fotos, y las combina automágicamente. Una foto HDR (High Dynamic Range) es en esencia una foto tomada con varios valores de exposición. La forma más simple de HDR en esencia toma 3 fotografías, un expuesta normalmente, otra expuesta para las áreas oscuras, y otra para las áreas claras, y las combina. Pero con esta nueva funcionalidad, la cámara toma una fotografía, la analiza en tiempo real, y determina cuántas imágenes más (sobreexpuestas y subexpuestas) necesita para cubrir el 100% del rango dinámico de la imagen, procede a tomar las fotos, y las combina automágicamente.4. Rango dinámico ampliado en video  Ahora es posible obtener más detalle tanto en las áreas oscuras como claras de los videos que grabas, en esencia mejorando la calidad de video de tu cámara para que se acerque más al "look" del cine. Ahora es posible obtener más detalle tanto en las áreas oscuras como claras de los videos que grabas, en esencia mejorando la calidad de video de tu cámara para que se acerque más al "look" del cine.5. Control total de los fps Ahora no solo estás restringido a grabar 24, 25, 30 o 60 cuadros por segundo, sino que puedes especificar cualquier número arbitrario entre 0.2 (una imagen cada 5 segundos) hasta 35fps en modo 1080p (en 60D y 600D). Esto es útil (como indican en la documentación) para por ejemplo grabar un video a 22fps y después verlo a 24fps, lo que en una película de acción hace ver los movimientos un poco más rápidos. Esos son apenas 5 de las cosas que puedes hacer con Magic Lantern, pero son muchísimas las otras cosas que puedes hacer, con el zoom, zebras, sonido, video, ajustes de ISO, LiveView, etc. enlace oficial a Magic Lantern autor: josé elías |

|

|

|

|

|

martes, agosto 21, 2012

|

|

Hoy comparto con ustedes un video creado por Intel sobre cómo sería un aula de docencia en el futuro, y tomaron como ejemplo el enseñar a unos niños cómo se construye un puente, y después hacerlo realidad.

El video estoy seguro que les gustará a muchos (a mi me encantó), pero a la misma vez de forma indirecta podemos utilizarlo de ejemplo sobre los problemas aun por resolver hoy día, en particular el tema de adoptar la tecnología en los salones de clases, y el gran problema de profesores que aun no entienden estas nuevas tecnologías y por tanto no pueden tomar ventajas de estas. Por otro lado, la buena noticia es que el 100% de todo lo que vieron en el video ya se puede hoy día (en los enlaces de noticias anteriores en eliax al final del artículo pueden ver muchas de esas tecnologías disponibles desde hace años), solo que todavía son un poco caras. Las tabletas ya existen, las pizarras electrónicas también, así como los simuladores físicos. Y en cuanto a la pizarra electrónica detrás del profesor, ya vienen tecnologías en camino que las harán super baratas y prácticas para el final de la década. ¡Gracias a Karls Vladimir Peña por el enlace al video! Video a continuación (enlace YouTube)... autor: josé elías |

|

|

|

|

en camino a la singularidad...

©2005-2026 josé c. elías

todos los derechos reservados

como compartir los artículos de eliax

Seguir a @eliax